Research status and prospects of perception technology for unmanned mining vehicle driving environment

-

摘要: 矿井辅助运输系统是煤矿企业运输人员和重要物料、装备的必备系统,实现矿井无人驾驶是提高运输效率、保障运输安全的必然要求,也是落实国家煤矿智能化建设部署的必由之路。矿井无人驾驶依赖于准确实时的环境感知,即利用激光雷达、毫米波雷达等车载感知器件和车联网支持下的协同感知,实现车辆局部甚至矿井全局的精确详尽感知。对矿井无人驾驶环境感知技术的研究现状进行了系统梳理,指出巷道特殊环境使得矿井车载感知设备的性能都将出现不同程度的下降,并对各种车载感知设备的优劣进行了总结归纳;详细阐述了矿井无人驾驶环境感知的关键技术,包括基于可见光图像或激光点云的单传感器障碍物识别方法,多传感器融合感知的分类及可见光图像+激光点云、可见光图像+毫米波点云、可见光图像+激光点云+毫米波点云、4D毫米波雷达+其他感知器件等多传感器融合方式,智能网联协同感知的实现方式、数据处理方法及其对无人驾驶的促进作用,井下巷道交通标志检测与识别方法,井下无轨胶轮车和有轨机车的巷道可行驶区域分割方法等;对矿井无人驾驶环境感知技术的发展方向进行了展望,建议提高矿井多传感器融合性能、研究矿井自适应感知算法并突破矿井智能网联协同感知技术。Abstract: The auxiliary transportation system for coal mine is an essential system for transporting personnel, important materials, and equipment in coal mine enterprises. Realizing unmanned driving in coal mine is an inevitable requirement for improving transportation efficiency and ensuring transportation safety, and is also the only way to implement the national coal mine intelligent construction deployment. The mine unmanned driving relies on accurate and real-time environmental perception. By using onboard perception devices such as LiDAR and millimeter wave radar, as well as collaborative perception supported by the Internet of vehicles, the precise and detailed perception of local vehicles and even the entire mine is achieved. A systematic review is conducted on the research status of unmanned driving environment perception technology in mines. It is pointed out that the special environment of coal mine will lead to varying degrees of degradation in the performance of mine onboard perception devices. The advantages and disadvantages of various onboard perception devices are summarized. The key technologies of mine unmanned driving environment perception are elaborated in detail. The technologies include single-sensor obstacle recognition methods based on visible light images or laser point clouds, the classification of multi-sensor fusion perception, and multi-sensor fusion methods such as visible light images+laser point clouds, visible light images+millimeter wave point clouds, visible light images+laser point clouds+millimeter wave point clouds, 4D millimeter wave radar+other perception devices. The technologies include the implementation, data processing methods of intelligent networked collaborative perception, and their promoting effects on unmanned driving. The technologies also include methods for detecting and recognizing traffic signs in underground roadways, and methods for segmenting the driving area of underground trackless rubber wheeled vehicles and tracked locomotives in roadways. The development direction of unmanned driving environment perception technology in mines is pointed out. It is recommended to improve the fusion performance of multiple sensors in mines, study adaptive perception algorithms in mines, and break through the intelligent networked collaborative perception technology in mines.

-

0. 引言

煤炭在我国能源结构中占据主导地位,对国民经济的发展起着至关重要的作用。煤矿智能化建设代表着我国煤炭工业先进生产力的发展方向,是煤炭工业高质量发展的核心技术支撑和必由之路[1]。2020年2月,国家发展改革委、国家能源局、应急管理部等八部委联合发布了《关于加快煤矿智能化发展的指导意见》,指出要加快推进煤炭行业供给侧结构改革和高质量发展,吹响了我国煤矿智能化建设的冲锋号,对于我国煤炭工业的发展具有里程碑意义[2]。《煤矿智能化建设指南(2021年版)》(以下简称指南)中提出建立智能地质保障系统、智能掘进系统、智能采煤系统、智能运输辅助系统等12个井工煤矿智能化系统。

矿井辅助运输承担着人员、材料、设备等运输任务,加快矿井辅助运输智能化技术研究、实现矿井无人驾驶,可显著提升矿井运输效率,减少井下从业人员,保障矿井运输安全。因此,指南要求建设具有智能规划、任务分配功能的辅助车辆智能调度管理系统,逐步实现物料运输、人员运输等辅助运输车辆的智能管控与智能调度;鼓励具备条件的煤矿企业探索应用无人驾驶、地面远程遥控驾驶和智能化自动驾驶,基于环境感知、定位导航、路径规划、运动控制等关键技术,实现车辆自动启停、自主避让、自动跟车等功能。

目前,乘用车领域的无人驾驶技术已较为成熟并逐步走向商用,露天矿山行业的无人驾驶技术也已处于试用阶段,井工煤矿的无人驾驶关键技术由于应用环境特殊,其发展相对滞后。在矿井无人驾驶关键技术中,环境感知是实现定位导航、路径规划和运动控制的基础,高质量的环境感知信息是无人驾驶技术成功应用的关键前提。为此,本文拟对矿井无人驾驶环境感知领域的感知装备、感知技术、融合方法等进行全面梳理归纳,为本领域人员进行算法设计、系统开发和应用部署提供借鉴。

1. 矿井无人驾驶环境感知的主要挑战

煤矿辅助运输设备主要包括有轨机车和无轨胶轮车(以下简称矿车)两类。有轨机车需铺设专用轨道,主要有蓄电池机车和架线机车。无轨胶轮车无需轨道,主要以电力或柴油为动力,有的采用架空线、拖拽电缆供电(也称梭车)[3]。无轨胶轮车主要运行在辅助运输主巷、工作面运输巷及联络巷中,辅助运输主巷往来车辆多,一般采用双车道,工作面运输巷和联络巷一般设置为单车道[4]。

相对于正在行驶的车辆而言,车辆行进巷道前方的人员、其他车辆、巷道底板或巷道内的悬挂标牌等均是影响行驶的障碍物,需准确识别其距离、方位和高度或轮廓,进而判断可行驶区域,以便准确采取制动、转向等决策措施。然而,与地面或露天矿山的无人驾驶相比,井下行驶巷道空间狭小,光照不均,温度高,湿度大,部分巷道底板不平,且有瓦斯和煤尘等爆炸性物质,限制了车辆感知器件的性能。但是矿车行驶路线相对固定、行驶速度较低、巷道不是开放环境等,为针对性矿井无人驾驶感知算法设计奠定了基础。

矿井车辆需通过车载感知器件获得车辆自身与环境数据。根据传感器功能,可将这些感知器件分成内部传感器和外部传感器[5]。内部传感器(如惯导设备)用于采集矿车自身数据,如车速、加速度及车轮转角;外部传感器(如车载摄像机)用于采集巷道环境数据,又可分为单车感知器件与联网感知器件。单车感知器件仅通过车辆自身的感知操作即可实现对外部环境的认知,如激光雷达、传统毫米波雷达、4D毫米波雷达、超声波雷达、可见光摄像机、红外摄像机、深度相机及双目视觉相机;联网感知器件则需要与车辆联网协同才能工作,主要指通信定位模块,如5G通信终端、超宽带(Ultra Wide Band,UWB)定位终端等。

由于内部传感器是普通车辆和无人驾驶车辆均有的传感器件,所以本文不予赘述;联网感知器件将放在智能联网协同感知中予以讨论。若无特殊说明,本文中矿井无人驾驶车载感知器件指的是单车感知器件。相比乘用车或露天矿山无人驾驶车辆,矿井车辆的车载感知器件受巷道复杂环境限制,几乎都会出现不同程度的性能下降,如:激光雷达测距精度高,目标分辨力强,但受粉尘和水雾影响大;传统毫米波雷达受光照、粉尘等因素影响小,但由于通道数有限,导致数据较为稀疏,不过新兴的4D毫米波雷达具有更多通道,且弥补了传统毫米波雷达不能测高的缺陷;乘用车领域广为使用的摄像头(可见光摄像机)在矿井环境中受影响非常大,具体表现为粉尘遮挡镜头、潮湿空气在镜头上凝结成水、光照不均影响成像过程、底板不平导致图像模糊。为便于阅读,总结了常用的矿井车载感知器件作用及优劣[6-9],见表1。

表 1 常用的矿井车载感知器件作用及其优劣Table 1. Functions of common mine vehicle perception devices and their advantages and disadvantages感知器件名称 作用 优点 缺点 激光雷达 生成实时点云地图,障碍物识别与测距 测距精度高,分辨率高 受粉尘影响大,价格高,体积大 毫米波雷达 障碍物测距 不受光照影响,受粉尘影响小,测距测速精度高,体积小,成本低 分辨率低,检测距离短,难以区分物体形状 4D毫米波

雷达障碍物识别与测距 不受光照影响,受粉尘影响小,测距测速精度高,角分辨率高,可测高成像,探测距离远,价格适中 点云稀疏 超声波雷达 测量矿车与巷道壁的距离,短距离防碰撞 近距离测量优势大,成本低 方向性差,回波信号弱,检测距离短 可见光

摄像机环境图像信息采集,障碍物识别与测距 分辨率高,有颜色信息,体积小,成本低 难以测距,受光照、粉尘影响大,可靠性低 红外摄像机 障碍物识别 受光照、粉尘影响小 分辨率低,探测距离近 深度相机 获取前方物体深度,障碍物识别与测距 有配套算法进行解析,使用方便 获取信息少,信息易偏移,受光照、粉尘影响大 双目视觉相机 获取边缘信息,进行场景重构,障碍物识别与测距 可测距,分辨率高,有颜色信息,体积小,成本低 受光照、粉尘影响大,可靠性低 2. 矿井无人驾驶环境感知关键技术

矿井无人驾驶环境感知的主要任务是识别车辆行驶路径上的各种障碍物和交通标志,进而确定车辆可行驶区域,帮助车辆制定科学的决策规划策略。当前文献主要集中在障碍物识别上,2.1节和2.2节将分别对单传感器和多传感器融合障碍物识别进行探讨;基于矿井车联网的智能网联协同感知则在2.3节陈述;考虑到交通标志是车辆必须遵循的强制外部条件,对交通标志的检测与识别也十分必要,这将在2.4节论述;2.5节将研究基于感知结果的巷道可行驶区域分割问题。矿井无人驾驶环境感知关键技术如图1所示。

2.1 单传感器障碍物识别

障碍物识别是矿井无人驾驶的关键保障,可基于单传感器或多传感器融合实现,本节介绍单传感器障碍物识别。在矿井中,可将激光雷达作为主感知设备,而将可见光摄像机、毫米波雷达、超声波雷达等传感器作为辅助感知设备[10]。目前,可见光摄像机和激光雷达研究得较为充分。

2.1.1 基于可见光图像的障碍物识别

可见光摄像机是矿车获取巷道环境信息的主要来源之一,采用传统视觉目标检测或基于深度学习的目标检测方法。传统视觉目标检测方法手工提取方向梯度直方图(Histogram of Oriented Gradient, HOG)等特征,在矿井无人驾驶领域应用极少。基于深度学习的目标检测方法采用神经网络进行分类或回归,按检测原理可分为单阶段和两阶段方法[11]。

单阶段方法采用单个检测网络进行端对端训练,YOLO系列算法[12]、SSD[13]及RetinaNet[14]即是经典的单阶段方法。该类方法可直接得到目标的类别概率和位置坐标,计算速度快,但对小目标的检测效果较差,平均检测精度低于两阶段方法。两阶段方法采用先定位后识别的方案,即先从场景中提取可能包含目标的区域候选框,然后在候选框中进行目标识别,RCNN[15]、SPPNet[16]、Fast R−CNN[17]及Faster R−CNN[18]即属此类。尽管两阶段方法的平均检测精度高于单阶段方法,但检测速度较慢,实时性较差,因此单阶段方法更适用于矿井无人驾驶的障碍物识别。

需要注意的是,单阶段方法仅能测得障碍物的类别及概率,无法获知障碍物与矿车的距离,需要单独进行距离测量。为此,可采用双目或单目测距法,前者利用2台可见光摄像机模拟人类双眼,通过图像差异计算深度信息[19];后者常用离线标定法,对可见光摄像机进行标定,获取其内外参数,再通过坐标系转换和几何变换求得目标的实际距离[20]。单目测距法精度一般低于双目测距法,但当应用场景为有轨机车时,利用机车轨道是2根确定距离的平行线的先验知识,可大幅度提高单目视觉对轨道上障碍物的测距精度。

文献[21]提出一种基于DeblurGANv2和改进YOLOv4的井下障碍物实时检测算法,用于解决井下光线昏暗、图像模糊、障碍物遮挡、小目标不易识别及背景杂乱等问题。通过拉普拉斯算子计算图像的模糊程度,从而判断是否需要去模糊,若需要则使用DeblurGANv2对其进行去模糊操作。为提高障碍物检测速度,将YOLOv4中主干网络CSPDarknet53替换为轻量级特征提取网络MobileNetv2。为提高算法在井下光线昏暗、障碍物遮挡及小目标不易识别情况下的检测精度,在YOLOv4的Neck中嵌入SANet注意力模块。通过K−means++算法对前几帧进行聚类,并引入focal损失函数替代cross-entropy损失函数,进一步提高算法检测精度。

文献[22]针对井下巷道行人检测与距离测量进行了研究,提出一种Dense−YOLO行人检测算法。利用K−means聚类策略计算锚点框尺寸,将DenseNet引入YOLO模型进行图像特征提取,并运用非极大值抑制算法找到同一目标的最佳候选框。为提升小目标检测精度,在提取图像特征时使用特征金字塔结构加强对浅层特征的利用,形成一种融合多层次特征图的网络结构,可快速准确地完成巷道行人检测任务。检测出行人后,利用单目测距法测量距离:首先对摄像机进行标定,获得内外参数,并进行畸变校正;然后搭建单目测距模型,通过坐标系转换推算人车距离关系;最后结合井下巷道行人检测算法得到的坐标参数进行距离计算。

文献[23]提出基于并行特征传递的矿井行人检测深度学习网络PftNet,试图将单阶段方法速度快和两阶段方法准确率高的优势结合在一起,具体包括行人辨识模块和行人定位模块。行人辨识模块使用锚点框初步检测矿井行人,粗略调整锚点框位置与大小,过滤负锚点;行人定位模块进一步提升回归精度,输出预测结果。文献[24]提出一种矿井电机车多目标实时检测方法 YOLOv4−Tiny−4S,在满足矿车无人驾驶实时性的前提下,提升目标平均检测精度。

2.1.2 基于激光点云的障碍物识别

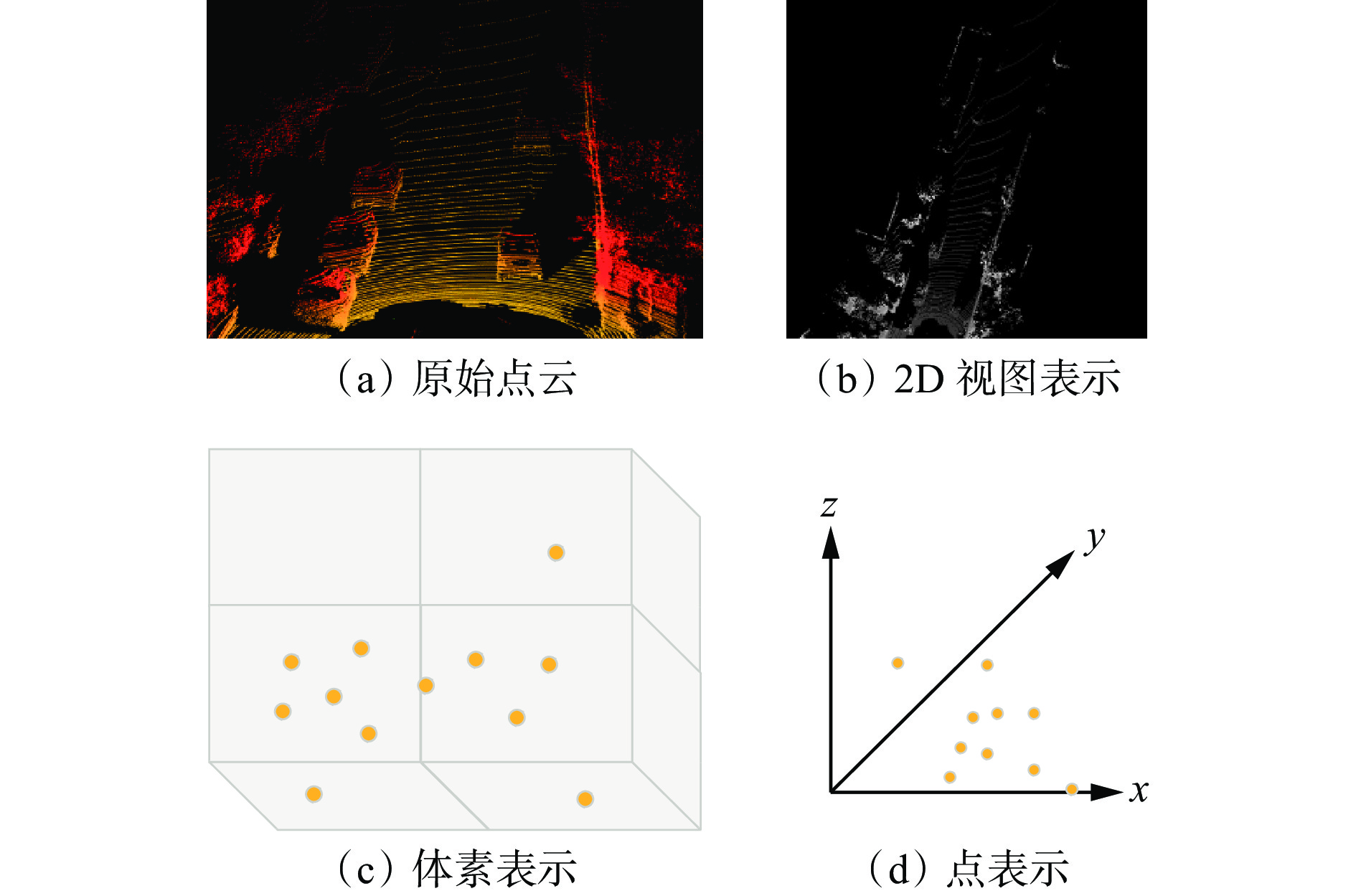

激光雷达检测范围广、分辨率高、测距精度高,已成为井下主要的目标检测传感器。激光雷达所获取的点云数据是3D坐标系中点的集合,一般由位置坐标及反射强度定义。相比于图像,点云数据能够获得更加精确的深度信息,有效缓解图像中常见的遮挡问题。点云具有无序性、旋转不变性、置换不变性等特征,为了能够有效提取其特征,一般将其以2D视图、体素、空间点或点和体素相结合的形式输入到网络中进行处理[25],如图2所示。

基于2D视图的方法将3D点云数据投影到2D平面上,如前视图(Font View,FV)、鸟瞰图(Bird Eye View,BEV)和距离视图(Range View,RV),再使用二维卷积网络处理映射后的点云。该类方法能够有效降低3D点云数据的高计算成本与时间成本,但这种降维操作会丢失原始信息(如目标内部各点之间的结构信息),导致对小目标的检测效果较差。如多视图三维(Multi-View 3D,MV3D)网络[26],其输入为RGB图像和原始激光点云处理生成的2D BEV与FV,在进行小目标检测时,小目标在点云BEV中经下采样后占据像素较少,易产生漏检。

基于体素的方法将点云表示成体素网格的形式,将点云的特征量化为体素的特征,以便使用神经网络进行训练。VoxelNet[27]的出现使得体素特征的获取从手工编码转换为利用机器学习获取,在检测性能上取得重大突破。该类方法实现了点云数据的高效处理,但是离散化过程中的信息丢失降低了细粒度定位精度。

基于空间点的方法始于2017年R. Q. Charles等[28]提出的PointNet。之前,由于点云的旋转不变性及点的排列不变性,学者们无法像处理图像文字一样来处理点云数据。PointNet使用最大池化作为对称函数来解决点云的排列不变性,并利用一个小型的T−Net网络预测仿射变换矩阵,避免了点云几何变换带来的影响。PointNet系列方法的提出促进了更多基于空间点的3D目标检测算法的出现,如PointRCNN[29],STD[30]。该类方法能够达到较高的检测精度,但在规模较大的无人驾驶场景中,由于点的数量十分庞大,难以达到实时检测效果。

一般而言,基于体素的方法计算效率较高,但会丢失局部信息,导致定位精度降低。基于空间点的方法计算成本较高,但容易通过点抽象获得较大的感受野来提升定位精度。空间点和体素相结合的方法力图综合这2种方法的优势,使用体素特征提取网络生成初始检测框,进而得到目标及其位置信息,是一种两阶段方法。不同特征提取网络的差别仅在于融合点的方式和阶段不同[25],如Fast Point R−CNN[31],P2V−RCNN[32]等仅在特征层面融合,PV−RCNN++[33]等则利用空间点和体素的空间信息进行聚合。然而,受限于两阶段网络本身的特性,这些方法都比较耗时,不能满足无人驾驶中实时性的要求。

2.2 多传感器融合障碍物识别

单传感器障碍物识别仅需要1个传感器即可,实现简单,但在某一采样时刻仅能获取环境的1个片面数据,数据量较少,感知性能不能满足巷道复杂运输工况的要求。多传感器融合障碍物识别通过多视角、多类型传感器的融合获得更多种类和数量的数据,能够更加全面地描述环境[34],提升感知维度与感知准确度,提高系统鲁棒性[35]。

2.2.1 多传感器融合算法分类及融合结构

多传感器融合算法可分为随机类算法和人工智能算法两类。经典的随机类算法有贝叶斯估计法、DS证据理论、卡尔曼滤波法、加权平均法等;人工智能算法包括遗传算法、模糊逻辑理论、神经网络等。

贝叶斯估计法基于先验概率,将新的数据信息和先验信息进行融合得到新的概率,从而完成多传感器融合感知任务。DS证据理论将多传感器获得的信息按一定规则进行组合,实现对检测目标的分类和定位,克服了贝叶斯估计法需要先验概率的缺点,提出了置信区间和不确定区间概念。卡尔曼滤波法利用状态方程进行状态预测,通过观测方程获取新的观测值,将预测值和观测值进行融合得到当前时刻的最优估计值。卡尔曼滤波具有递推特性,能够估计目标的当前状态,也可以预测目标的未来状态。加权平均法将各传感器采集的数据按一定加权规则进行加权平均,得出的结果即为融合的最终结果。

遗传算法是一种随机全局搜索优化算法,通过多次随机选择、交叉和变异操作,最终求得问题的优质解。模糊逻辑理论建立在多值逻辑基础上,实现对人的不确定性概念判断和推理思维方式的模仿。相较于其他算法,模糊逻辑理论较大程度地提高了融合精度,但主观性较强,受人为因素影响大。神经网络是一类模拟人类大脑工作机制的算法,可从数据集中学习到关键特征,具有很强的自学能力,能够模拟非常复杂的非线性映射。该类算法在多传感器融合检测中具有很大优势,逐渐成为主流的多传感器融合感知算法。

按照数据融合的层级不同,可将多传感器融合算法分为数据级融合、特征级融合和决策级融合。数据级融合也称目标级融合,是底层的融合方式。在数据级融合中,先将不同传感器采集的原始数据进行对齐、关联等操作,再进行特征提取得到检测结果,如图3(a)所示。数据级融合能最大程度地避免信息丢失,但是计算量大,检测速度慢,对算力要求高,不是井下矿车环境感知首选。在特征级融合中,先对原始数据进行特征提取,再将提取的特征进行融合得到检测结果,如图3(b)所示。特征级融合有效减少了数据带宽需求,检测速度快,实时性好,但会丢失部分细节,检测精度往往没有数据级融合高。在决策级融合中,对各个感知器件获取到的数据独立进行特征提取和决策,然后对决策结果进行融合,如图3(c)所示。决策级融合的优势在于,某个传感器的故障不会影响其他传感器或整个系统工作,提升了感知系统的鲁棒性。此外,由于数据流不会经历复杂的融合过程,所以处理速度较快。

2.2.2 矿井环境感知主流融合检测算法

融合检测算法力图将不同感知设备的优势互补,用以克服其他感知设备的缺陷,主要方式有可见光图像+激光点云、可见光图像+毫米波点云、可见光图像+激光点云+毫米波点云、4D毫米波雷达+其他器件方式。

1) 可见光图像+激光点云。这是无人驾驶中最热门的多传感器融合模式。可见光摄像机提供高分辨率图像,但井下巷道环境恶劣,光照不足会导致可见光图像信息丢失;激光雷达提供稠密点云,但狭小的巷道空间和高浓度粉尘使得噪声增多。将二者融合,有望较大幅度地解决彼此面临的问题。

文献[36]提出一种融合可见光图像与激光点云的无轨胶轮车3D目标检测算法。对数据进行预处理:通过全局直方图均衡化提升图像亮度,基于双边滤波去噪和主成分分析降维处理提升点云数据质量。设计了一种融合可见光图像与激光点云的检测模型(图4),引入区域候选网络(Region Proposal Network,RPN)生成2D可见光图像候选区域,将2D可见光图像与点云数据进行特征级融合,生成3D候选区域,进而进行后期区域级融合,输出3D锚框,实现井下目标检测。

文献[37]利用激光雷达与可见光摄像机联合感知前方路况,并与超声波传感器联合感知矿车周围环境。为确保环境信息一致性,将图像与点云数据进行时空匹配(图5),其中时间匹配通过在数据采集输出端使用缓存寄存模块实现,空间匹配通过坐标转换实现。完成数据融合后便可形成目标感兴趣区域,进而完成对障碍物的判断。文献[38]利用灰度最大值拉伸算法对图像进行增强,并通过AI算法将视频图像与激光雷达数据进行融合,将图像内容智能识别为参照物、障碍物和无关物3类。

2) 可见光图像+毫米波点云。可见光摄像机与毫米波雷达已发展多年,二者硬件技术储备足,生产成本低,但相较于可见光图像与激光点云融合起步较晚,且二者融合研究的公开数据集较少。毫米波雷达的深度信息检测能力虽不如激光雷达,但穿透烟雾和粉尘的能力强,适合应用于含有大量煤灰与粉尘的矿井中。

文献[39]采用毫米波雷达与可见光摄像机联合感知前方路况,并在车身四周布置多个超声波传感器用于短距离防碰撞。与激光雷达相比,毫米波雷达生成的点云较稀疏,捕获的信息较少,因此应尽量保留其原始信息。为此,作者设计了“目标级+决策级”两级融合策略(图6),对获得的原始数据进行预处理后,先进行第1级融合(目标级融合),再对融合结果进行第2级融合(决策级融合),输出环境信息。

3) 可见光图像+激光点云+毫米波点云。可见光图像、激光点云和毫米波点云三者融合的鲁棒性好,检测精度高,但融合算法设计难度大,对车载算力要求高,成本较大。文献[40]认为多传感器结果级融合更适用于井下车辆路况识别,因此提出了如图7所示的融合方案。该方案中上述3种传感器分别采用各自感知算法输出探测数据,并根据位置及分类信息进行融合,最终得到感知数据。

为解决井下多目标检测和场景生成问题,文献[41]采用深度网络进行多目标检测跟踪及场景分割,实现了激光雷达、毫米波雷达、可见光摄像机的数据融合,形成感兴趣区域,经图像识别后,形成道路信息和障碍物信息。文献[42]提出的融合算法包括数据级融合和结果级融合。先确定激光雷达和可见光图像像素级的精确定位关系,再利用深度学习算法实现目标检测与场景分割,并将目标检测结果与毫米波雷达进行结果级融合。此外,还将利用图像识别出的交通标志信息与矿井地图信息进行匹配,得到行驶场景的感知表达。

4) 4D毫米波雷达+其他感知器件。井下激光雷达测距精度高,探测距离远,但在环境湿度高和粉尘浓度大的环境中效果不佳;毫米波雷达点云虽然数据较为稀疏,但受湿度和粉尘影响较小。将激光雷达和毫米波雷达融合有望提高矿车环境感知精度与鲁棒性。同时,4D毫米波雷达不但能精确测距、测速和测角,而且可以测高,并能描绘出物体轮廓(成像),进一步增强了毫米波雷达的3D目标检测能力。目前,4D毫米波雷达最远探测距离已达约1 000 m,且水平角分辨率较高(1°)[43]。随着技术进步,毫米波雷达的角分辨率有望进一步提高,从而达到一些低端激光雷达的效果。此外,4D毫米波雷达在煤矿复杂巷道中的环境适应能力强,可弥补可见光摄像机在照度低、烟雾浓度大的巷道环境中的不足,因此,4D毫米波雷达与可见光摄像机融合相比于激光雷达与可见光摄像机融合更具性价比。

目前,激光雷达为矿井无人驾驶环境感知主要设备,对4D毫米波雷达在井下应用的研究较少,可将其引入矿车无人驾驶系统感知设计中,进行4D毫米波雷达环境感知算法、4D毫米波雷达融合激光雷达环境感知算法、4D毫米波雷达融合可见光摄像机环境感知算法,以及4D毫米波雷达、激光雷达、可见光摄像机三者融合环境感知算法的研究。

2.3 智能网联协同感知

井下作业环境较为复杂,若仅使用车辆自身传感器件进行环境感知,在矿井交汇路口、上下坡及硐室处将存在感知盲区。基于蜂窝车联网(Cellular Vehicle-to-Everything,C−V2X)、5G等通信技术的车联网可大大拓展车辆的感知范围,促进车辆的协同感知和伙伴驾驶[44]。

井下智能网联协同感知可采用车车协同感知和车巷协同感知方式。车车协同感知通过车−车(Vehicle-to-Vehicle,V2V)通信方式,使用卡尔曼滤波器、多模态方法、低层次图像数据处理方法等,将UWB、激光雷达、毫米波雷达、可见光摄像机等传感器感知到的数据进行融合处理,从而增强感知能力,扩大感知区域。车巷协同感知通过车−基础设施(Vehicle-to-Infrastructure,V2I)通信方式,将巷道中的摄像机、激光雷达、毫米波雷达、UWB等传感器所感知到的数据与车端感知到的数据进行融合,使车辆获得全方位的环境信息,融合方法主要有卡尔曼滤波器、因子图、非极大值抑制等[45]。

智能网联协同将在以下方面促进矿井无人驾驶的技术进步和应用落地:

1) 大幅增强车辆全局感知能力。车载传感器感知距离有限,且易受井下复杂巷道环境影响而降低检测性能。智能网联协同感知将矿车的感知能力拓展到了有巷边设施和有网络覆盖的所有巷道,大幅增强了车辆的全局感知能力。

2) 实现巷道路况的全场景感知。智能网联协同感知可实现“超视距感知”,通过部署在巷道中的智能摄像头、激光雷达等感知设备全方位采集动态交通数据,实时获取交通参与者信息,有效弥补单车感知缺陷,实现矿井巷道的全场景感知。

3) 构建数字化网络化交通规则。传统单车无人驾驶车辆大多采用视觉处理算法识别巷道中的红绿灯、交通信号牌等交通标志,不但识别率无法达到交通所需的100%要求,而且无法提前掌握视距外的交通信号。目前部分矿井已完成交通信号灯的数字化改造,若能进一步完成所有交通标志的数字化网联化,将实现矿车对矿井交通状况的全局掌控,消除因交通标志识别错误带来的安全隐患。

文献[41]提出以车联网为核心的煤矿井下无轨胶轮车无人驾驶系统架构,依托车身传感器、矿用智能路侧单元(Road Side Unit,RSU)等识别路况信息,并通过车联网共享感知结果。文献[44]提出井下巷道应部署C−V2X RSU、5G基站及其他感知设备,为车辆、人员、平台提供通信链路,从而弥补单车感知的不足,实现车巷协同。文献[46]通过域控制器对车辆进行控制,实现车辆自动避障行驶与路径合理优化。文献[47]采用V2X/5G通信技术为矿车无人驾驶系统提供超视距感知和道路预警功能,有效提升无人驾驶安全性和运输效率。

2.4 井下巷道交通标志检测与识别

矿井交通标志用于提供指示、禁止和警告信息,对于提高运输效率、保障运输安全具有重要意义。因此,矿井交通标志是矿井车辆必须遵守的交通规则,识别交通标志、根据交通标志进行决策规划是无人驾驶车辆必须具备的能力。矿车能够越早识别前方交通标志,则留给决策控制模块的响应时间越长,辅助运输的安全性及效率越高。

目前,研究矿井交通标志识别的文献不多。从目标检测角度而言,可将交通标志视为需要识别的一类目标,因此可利用2.1节和2.2节的方法进行检测和识别。若采用可见光图像方式进行识别,交通标志在距离比较远的时候表现为小目标,特征不明显,识别较为困难。再加上井下光照条件差,粉尘浓度大,图像质量不高,进一步加大了交通标志识别难度。现有文献主要通过改进网络结构提高井下小目标检测精度,如文献[21-22]。

鉴于井下巷道交通标志数据集较少,针对性检测与识别模型也不多,建议对以下关键技术进行研究:① 制作数据量足够的矿井交通标志数据集,或对稀疏数据集进行数据增强,扩展数据量。② 研究低照度图像实时增强与特征匹配技术,提高检测准确率。③ 研究轻量化检测模型,提高检测速率。

此外,可利用物联网技术对井下交通标志进行网络化改造,使交通标志具有数据收发能力。如此,矿井车辆便可与井下交通标志实现时间同步,不但可以准确知晓可视范围内的交通标志内容,而且可以及时了解整条行驶路径上的交通标志内容,实现全局路径掌控和整体最优规划。

2.5 井下巷道可行驶区域分割

可行驶区域分割旨在识别并分割出当前行驶场景下的可行驶区域,以防止矿车偏离车道或违规行驶,分割精度和鲁棒性直接决定了矿车能否正常行驶。鉴于无轨胶轮车与有轨机车的行驶路径存在较大区别,本节对二者的可行驶区域分割算法分别进行阐述。

2.5.1 无轨胶轮车可行驶区域分割

目前井下无轨胶轮车可行驶区域分割算法研究较少,主要为巷道道路分割与车道线检测2个方面。井下无轨胶轮车行驶巷道分为单巷道与双巷道,单巷道通过道路分割便可获取矿车可行驶区域,双巷道需将道路分割与车道线检测融合才可得到矿车可行驶区域。

1) 巷道道路分割。道路分割主要有传统基于视觉的方法和基于深度学习的方法。基于视觉的方法根据场景中的几何性质将路面与直立目标加以区分,以实现道路分割。文献[37]提出了基于视觉算法的巷道道路分割方法,首先对井下巷道图像进行灰度化处理,然后采用Sobel算子进行图像边缘增强并进行二值化,最后采用霍夫(Hough)变换提取巷道边界信息,并去除高度高于路面的误差线条,最终实现巷道边界检测。基于视觉的方法大多只适用于巷道道路前景和背景特征区别明显的场景,并不适用于井下边缘模糊且非结构化的巷道道路。

近年来,随着神经网络特征提取与表征能力的增强,基于深度学习的道路分割方法逐步成为主流方式,其精度高、鲁棒性强,可实现像素级的语义分割,更适用于井下巷道环境。基于可见光图像的语义分割网络大多采用编码器−解码器结构,编码器提取有效特征,解码器对特征进行复原,再通过全连接层综合所有特征及优化函数实现对道路的分割。文献[48]采用双边分割优化网络(DAM−BiseNetV2)进行语义分割,有效提升了露天矿山道路检测精度和速度,实现了复杂背景下露天矿山非结构化道路的有效识别。激光雷达点云数据稀疏,单独应用于语义分割场景时精度较低,若将其与可见光图像进行融合,则可提升分割精度,增强环境适应能力。文献[49]提出多种激光点云与可见光图像融合的道路分割方案,较好地实现了道路分割。

2) 车道线检测。在煤矿场景中,许多井下巷道目前没有车道线,但许多试验无人驾驶的煤矿巷道逐渐为巷道划上边界线,而双向车道的不同车道之间则有明显的车道线。车道线检测目前主要有传统机器视觉方法和深度学习方法。传统机器视觉方法一般通过预处理、人工特征提取及曲线建模等流程进行检测。当面对遮挡、车道线缺失、光照不均等情况时,该方法检测精度不足,无法正确稳定地检测出车道线[50-51]。

基于深度学习的车道线检测方法主要通过卷积神经网络来更有效地提取特征并进行识别,该方法鲁棒性更强,准确度更高。目前井下车道线检测算法研究极少,但井下轨道检测算法较为成熟。由于井下车道线与有轨机车轨道均具有连续长条状特征,且所处环境相似,借鉴井下轨道检测算法进行井下车道线检测研究具有可行性。

2.5.2 有轨机车可行驶区域分割

有轨机车在井下行驶需铺设轨道,可行驶区域为轨道区域。本节对基于传统图像处理的轨道检测算法和基于深度学习的轨道检测算法进行论述。

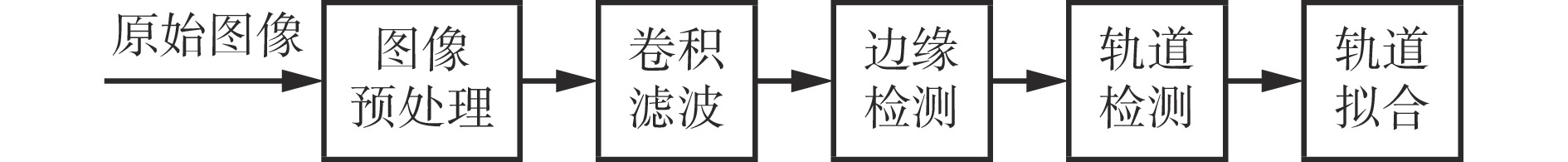

1) 基于传统图像处理的轨道检测算法。该算法一般流程如图8所示[52],其中图像预处理包括图像灰度变换、逆透视变换、感兴趣区域提取等操作,卷积滤波使用均值、中值等滤波器对图像进行去噪处理,边缘检测通过Canny、Sobel等算子获取目标边缘信息,最终利用Hough变换、随机抽样一致算法(Random Sample Consensus,RANSAC)、最小二乘法等获取轨道线信息。

基于传统图像处理的轨道检测可基于图像特征或轨道模型进行。基于图像特征的轨道检测利用轨道边缘、纹理、几何形状、颜色、灰度值等特征信息,将轨道与周边环境区分开,从而提取出轨道及其位置。该方法可适应不同形状轨道的检测任务,无需建立轨道模型,但过于依赖图像底层特征,易受环境干扰,若巷道轨道被积水、矿物等物体掩盖,检测效果会受到较大影响。基于轨道模型的轨道检测方法将轨道检测转换为轨道模型参数求解问题,根据局部范围内的轨道形态,采用分段直线、抛物线、双曲线或样条曲线对轨道线进行拟合[53],其关键在于选取合适的轨道模型。由于井下轨道形状多样,难以通过某一固定轨道模型完成所有类型轨道检测,所以该类方法局限性大,鲁棒性和灵活性差。

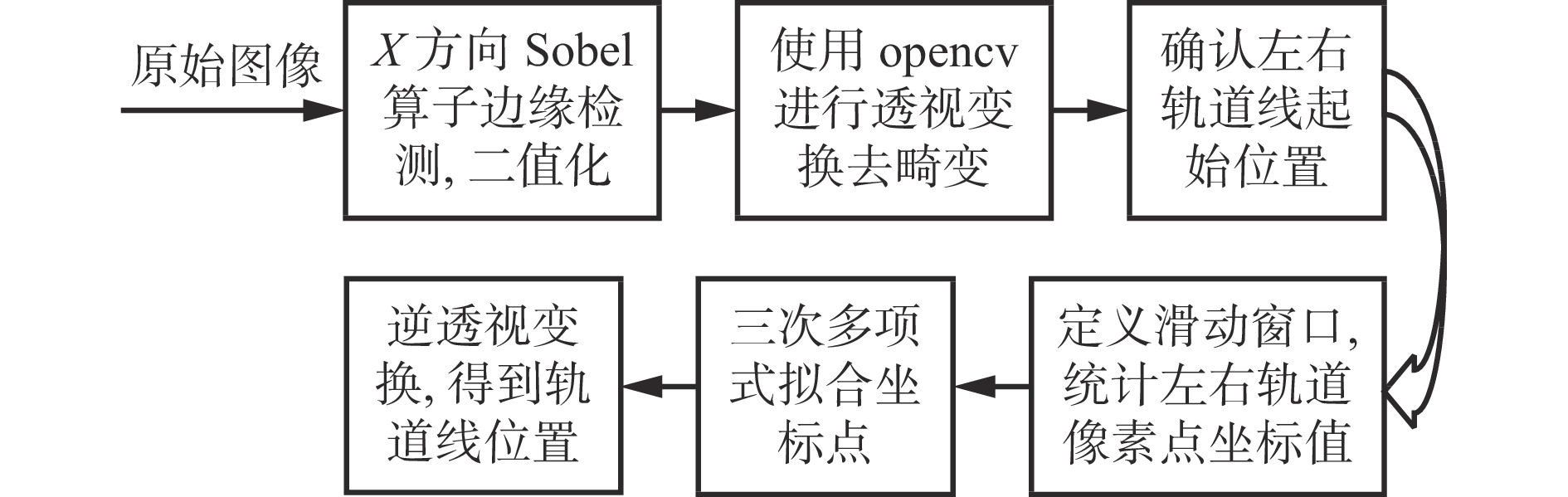

基于传统图像处理的轨道检测算法运行速度快,应用较为广泛。文献[54]采用该方法对电机车轨道区域进行划分,流程为彩色图像灰度变换、图像高斯滤波去噪、感兴趣区域获取、Sobel算子边缘检测、Hough变换获得轨道线。文献[55]采用传统计算机视觉技术实现轨道线检测(图9)。文献[56]为了克服Hough变换只能用于直线特征检测的缺陷,使用透视变换、滑动窗口和三次多项式拟合坐标点,检测流程为彩色图像灰度变换、图像高斯滤波去噪、Sobel算子边缘检测、感兴趣区域获取、透视变换、轨道线检测、逆透视变化获取轨道区域。

2) 基于深度学习的轨道检测算法。该算法构建神经网络模型,使用数据集对模型进行训练,从海量数据中自动提取轨道特征。其不需要手工设计和组合复杂特征,仅通过训练数据即能自动获取目标的高级语义信息,能够适应恶劣环境下的轨道场景,检测准确率和效率较高[57]。

文献[52]提出适用于井下轨道检测的空间卷积神经网络,实现了像素级别的轨道实例分割,相较于传统方法,在检测精度和检测效率上均有大幅提高。文献[58]提出一种基于改进BiSeNet的实时语义分割网络,在原网络的上下文路径中添加子网络融合模块,在充分利用低级特征的同时获取精细化特征图,基本实现了井下轨道的实时语义分割。文献[59]提出一种井下电机车多目标检测模型,在Mask R−CNN 基础上引入压缩−激励模块与混合空洞卷积,以提升目标检测速度、小目标检测精度及掩码分割精度[60],可在目标检测的同时进行像素级分割,实现轨道区域及其他目标掩码的提取。

3. 矿井无人驾驶环境感知技术发展方向

环境感知是矿井无人驾驶的重要基础,高质量的环境感知信息则是矿井无人驾驶成功应用的关键前提。矿井无人驾驶环境感知技术起步较晚,关键技术体系远未完善。就目前而言,以下技术亟待研究突破:

1) 提高矿井多传感器融合性能。在算法层面,目前大多传感数据融合方法并未考虑数据之间的时间、空间的关联属性,使得融合系统鲁棒性较差,应利用人工智能技术研发高鲁棒性的融合模型;在硬件层面,应大力研发性能稳定、鲁棒性强的矿用感知设备,如摄像头如何更好地克服环境因素的干扰、激光雷达如何提升粉尘场景下的探测性能等;在数据集层面,目前缺少进行矿井无人驾驶研究的针对性数据集,需大力开展数据采集和数据标定工作,为井下无人驾驶感知技术研究提供基础支撑。

2) 研究矿井自适应感知算法。不同巷道区域的环境条件差别很大,比如大巷与上下山有很大不同。为此,可研究自适应感知算法,根据识别出的巷道特征自动选择主感知设备,如对于粉尘浓度不高、湿度不大的巷道区域,采用激光雷达为主感知设备,否则采用长距4D毫米波雷达为主感知设备,将其与惯性传感单元、5G和UWB的感知数据融合,提升感知系统的准确性和鲁棒性。

3) 突破矿井智能网联协同感知技术。需研究巷道多传感器数据融合的覆盖范围问题,保证感知结果的准确性、及时性;研究路侧多传感设备的融合策略,保证对同一感知目标在相同时间、不同空间中的观测一致性;研究巷边感知和车载感知数据间的交互、互认和共享问题,保证数据在整个车联网范围的开放共享性;研究基于边缘计算的感知融合技术,利用车联网的边缘计算能力保证感知计算与规划决策的实时性。

4. 结语

高质量、高可靠、高实时的感知数据是保证矿井车辆实现无人驾驶的基本前提。当前,乘用车领域的无人驾驶感知技术研究得较为充分并逐步走向商用,露天矿山领域的无人驾驶感知技术研究也相对较多并在部分矿山得到初步应用,井工煤矿的无人驾驶感知技术则处于起步阶段,尚有大量技术亟需系统化攻关突破。在智能煤矿建设如火如荼推进、矿井无人驾驶研究与应用悄然兴起的背景下,对当前的矿井无人驾驶研究现状进行系统梳理,有助于让点状研究系统化,在矿井无人驾驶的目标与现状间找到差距,从而给相关研究人员以参考。为此,总结了矿井无人驾驶环境感知技术的最新进展,归纳了所面临的主要挑战,梳理了矿井无人驾驶环境感知关键技术,包括单传感器障碍物识别、基于多传感器融合的障碍物识别、智能网联协同感知、井下巷道交通标志的检测与识别及井下巷道可行驶区域分割,展望了矿井无人驾驶环境感知技术的可能发展方向。在今后的研究中,建议提高矿井多传感器融合性能、研究矿井自适应感知算法并突破矿井智能网联协同感知技术,为矿井无人驾驶车辆的智能自主运行提供理论和技术支撑。

-

表 1 常用的矿井车载感知器件作用及其优劣

Table 1 Functions of common mine vehicle perception devices and their advantages and disadvantages

感知器件名称 作用 优点 缺点 激光雷达 生成实时点云地图,障碍物识别与测距 测距精度高,分辨率高 受粉尘影响大,价格高,体积大 毫米波雷达 障碍物测距 不受光照影响,受粉尘影响小,测距测速精度高,体积小,成本低 分辨率低,检测距离短,难以区分物体形状 4D毫米波

雷达障碍物识别与测距 不受光照影响,受粉尘影响小,测距测速精度高,角分辨率高,可测高成像,探测距离远,价格适中 点云稀疏 超声波雷达 测量矿车与巷道壁的距离,短距离防碰撞 近距离测量优势大,成本低 方向性差,回波信号弱,检测距离短 可见光

摄像机环境图像信息采集,障碍物识别与测距 分辨率高,有颜色信息,体积小,成本低 难以测距,受光照、粉尘影响大,可靠性低 红外摄像机 障碍物识别 受光照、粉尘影响小 分辨率低,探测距离近 深度相机 获取前方物体深度,障碍物识别与测距 有配套算法进行解析,使用方便 获取信息少,信息易偏移,受光照、粉尘影响大 双目视觉相机 获取边缘信息,进行场景重构,障碍物识别与测距 可测距,分辨率高,有颜色信息,体积小,成本低 受光照、粉尘影响大,可靠性低 -

[1] 王国法. 加快煤矿智能化建设 推进煤炭行业高质量发展[J]. 中国煤炭,2021,47(1):2-10. WANG Guofa. Speeding up intelligent construction of coal mine and promoting high-quality development of coal industry[J]. China Coal,2021,47(1):2-10.

[2] 王国法. 煤矿智能化最新技术进展与问题探讨[J]. 煤炭科学技术,2022,50(1):1-27. DOI: 10.3969/j.issn.0253-2336.2022.1.mtkxjs202201001 WANG Guofa. New technological progress of coal mine intelligence and its problems[J]. Coal Science and Technology,2022,50(1):1-27. DOI: 10.3969/j.issn.0253-2336.2022.1.mtkxjs202201001

[3] 孙继平,江嬴. 矿井车辆无人驾驶关键技术研究[J]. 工矿自动化,2022,48(5):1-5,31. SUN Jiping,JIANG Ying. Research on key technologies of mine unmanned vehicle[J]. Journal of Mine Automation,2022,48(5):1-5,31.

[4] 刘琴. 无人驾驶无轨胶轮车路径规划与路径跟踪技术研究[D]. 徐州: 中国矿业大学, 2021. LIU Qin. Research on path planning and path tracking technology of driverless trackless rubber-tyred vehicle[D]. Xuzhou: China University of Mining and Technology, 2021.

[5] ZHU Hao,YUEN K-V,MIHAYLOVA L,et al. Overview of environment perception for intelligent vehicles[J]. IEEE Transactions on Intelligent Transportation Systems,2017,18(10):2584-2601. DOI: 10.1109/TITS.2017.2658662

[6] 杨春雨,张鑫. 煤矿机器人环境感知与路径规划关键技术[J]. 煤炭学报,2022,47(7):2844-2872. YANG Chunyu,ZHANG Xin. Key technologies of coal mine robots for environment perception and path planning[J]. Journal of China Coal Society,2022,47(7):2844-2872.

[7] 任柯燕,谷美颖,袁正谦,等. 自动驾驶3D目标检测研究综述[J]. 控制与决策,2023,38(4):865-889. DOI: 10.13195/j.kzyjc.2022.0618 REN Keyan,GU Meiying,YUAN Zhengqian,et al. 3D object detection algorithms in autonomous driving:a review[J]. Control and Decision,2023,38(4):865-889. DOI: 10.13195/j.kzyjc.2022.0618

[8] 李庆玲,张慧祥,赵旭阳,等. 露天矿无人驾驶自卸卡车发展综述[J]. 煤炭工程,2021,53(2):29-34. LI Qingling,ZHANG Huixiang,ZHAO Xuyang,et al. Overview of unmanned mining trucks in open-pit mine[J]. Coal Engineering,2021,53(2):29-34.

[9] CHENG Yuwei, SU Jingran, CHEN Hongyu, et al. A new automotive radar 4D point clouds detector by using deep learning[C]. IEEE International Conference on Acoustics, Speech and Signal Processing, Toronto, 2021: 8398-8402.

[10] THRUN S. Toward robotic cars[J]. Communications of the ACM,2010,53(4):99-106. DOI: 10.1145/1721654.1721679

[11] 李爱娟,巩春鹏,黄欣,等. 自动驾驶汽车目标检测方法综述[J]. 山东交通学院学报,2022,30(3):20-29. LI Aijuan,GONG Chunpeng,HUANG Xin,et al. Overview of target detection methods for autonomous vehicles[J]. Journal of Shandong Jiaotong University,2022,30(3):20-29.

[12] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]. IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, 2016: 779-788.

[13] LIU Wei, ANGUELOV D, ERHAN D, et al. SSD: single shot multibox detector[C]. European Conference on Computer Vision, Amsterdam, 2016: 21-37.

[14] LIN T-Y,GOYAL P,GIRSHICK R,et al. Focal loss for dense object detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2020,42(2):318-327. DOI: 10.1109/TPAMI.2018.2858826

[15] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]. IEEE Conference on Computer Vision and Pattern Recognition, Columbus, 2014: 580-587.

[16] HE Kaiming,ZHANG Xiangyu,REN Shaoqing,et al. Spatial pyramid pooling in deep convolutional networks for visual recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2015,37(9):1904-1916. DOI: 10.1109/TPAMI.2015.2389824

[17] GIRSHICK R. Fast R-CNN[C]. IEEE International Conference on Computer Vision, Santiago, 2015: 1440-1448.

[18] REN Shaoqing,HE Kaiming,GIRSHICK R,et al. Faster R-CNN:towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(6):1137-1149. DOI: 10.1109/TPAMI.2016.2577031

[19] 安果维,王耀南,周显恩,等. 基于显著性检测的双目测距系统[J]. 智能系统学报,2018,13(6):913-920. AN Guowei,WANG Yaonan,ZHOU Xian'en,et al. Binocular distance measurement system based on saliency detection[J]. CAAI Transactions on Intelligent Systems,2018,13(6):913-920.

[20] LIU Fayao,SHEN Chunhua,LIN Guosheng,et al. Learning depth from single monocular images using deep convolutional neural fields[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2015,38(10):2024-2039.

[21] WANG Wenshan,WANG Shuang,ZHAO Yanqiu,et al. Real-time obstacle detection method in the driving process of driverless rail locomotives based on DeblurGANv2 and improved YOLOv4[J]. Applied Sciences-Basel,2023,13(6):3861-3879. DOI: 10.3390/app13063861

[22] 袁稼轩. 基于深度学习的井下巷道行人检测与距离估计[D]. 合肥: 合肥工业大学, 2019. YUAN Jiaxuan. Pedestrian detection and distance estimation of underground roadway based on deep learning[D]. Hefei: Hefei University of Technology, 2019.

[23] WEI Xing,ZHANG Haitao,LIU Shaofan,et al. Pedestrian detection in underground mines via parallel feature transfer network[J]. Pattern Recognition,2020,103:107195-107207. DOI: 10.1016/j.patcog.2020.107195

[24] 郭永存, 杨豚, 王爽. 基于改进YOLOv4−Tiny的矿井电机车多目标实时检测研究[J/OL]. 工程科学与技术: 1-11[2023-05-04]. https://doi.org/10.15961/j.jsuese.202200019. GUO Yongcun, YANG Tun, WANG Shuang. Research on multi-object real-time detection of mine electric locomotive based on improved YOLOv4-Tiny[J/OL]. Advanced Engineering Sciences: 1-11 [2023-05-04]. https://doi.org/10.15961/j.jsuese.202200019.

[25] 霍威乐, 荆涛, 任爽. 面向自动驾驶的三维目标检测综述[J/OL]. 计算机科学: 1-20[2023-05-04]. http://kns.cnki.net/kcms/detail/50.1075.TP.20230407.1928.030.html. HUO Weile, JING Tao, REN Shuang. Review of 3D object detection for autonomous driving[J/OL]. Computer Science: 1-20[2023-05-04]. http://kns.cnki.net/kcms/detail/50.1075.TP.20230407.1928.030.html.

[26] CHEN Xiaozhi, MA Huimin, WAN Ji, et al. Multi-view 3D object detection network for autonomous driving[C]. IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, 2017: 6526-6534.

[27] ZHOU Yin, TUZEL O. VoxelNet: end-to-end learning for point cloud based 3D object detection[C]. Computer Vision and Pattern Recognition, Salt Lake City, 2018: 4490-4499.

[28] CHARLES R Q, SU Hao, KAICHUN M, et al. PointNet: deep learning on point sets for 3D classification and segmentation[C]. IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, 2017: 77-85.

[29] SHI Shaoshuai, WANG Xiaogang, LI Hongsheng. PointRCNN: 3D object proposal generation and detection from point cloud[C]. Computer Vision and Pattern Recognition, Long Beach, 2019: 770-779.

[30] YANG Zetong, SUN Yanan, LIU Shu, et al. STD: sparse-to-dense 3D object detector for point cloud[C]. IEEE/CVF International Conference on Computer Vision, Seoul, 2019: 1951-1960.

[31] CHEN Yilun, LIU Shu, SHEN Xiaoyong, et al. Fast point R-CNN[C]. IEEE/CVF International Conference on Computer Vision, Seoul, 2019: 9774-9783.

[32] LI Jiale,SUN Yu,LUO Shujie,et al. P2V-RCNN:point to voxel feature learning for 3D object detection from point clouds[J]. IEEE Access,2021,9:98249-98260. DOI: 10.1109/ACCESS.2021.3094562

[33] SHI Shaoshuai,JIANG Li,DENG Jiajun,et al. PV-RCNN plus plus:point-voxel feature set abstraction with local vector representation for 3D object detection[J]. International Journal of Computer Vision,2023,131(2):531-551. DOI: 10.1007/s11263-022-01710-9

[34] 祖国强,何俏君,张志德,等. 无人驾驶环境感知中多源数据融合应用综述[J]. 汽车文摘,2022(8):8-13. ZU Guoqiang,HE Qiaojun,ZHANG Zhide,et al. Application overview on multi-source data fusion in unmanned environment perception[J]. Automotive Digest,2022(8):8-13.

[35] WANG Zhangjing,WU Yu,NIU Qingqing. Multi-sensor fusion in automated driving:a survey[J]. IEEE Access,2020,8:2847-2868. DOI: 10.1109/ACCESS.2019.2962554

[36] 秦沛霖,张传伟,周李兵,等. 煤矿井下无人驾驶无轨胶轮车目标3D检测研究[J]. 工矿自动化,2022,48(2):35-41. QIN Peilin,ZHANG Chuanwei,ZHOU Libing,et al. Research on 3D target detection of unmanned trackless rubber-tyred vehicle in coal mine[J]. Industry and Mine Automation,2022,48(2):35-41.

[37] 骆彬. 井下蓄电池无轨胶轮车无人驾驶系统设计研究[D]. 徐州: 中国矿业大学, 2019. LUO Bin. Design of driverless system of underground battery trackless rubber tire vehicle[D]. Xuzhou: China University of Mining and Technology, 2019 .

[38] 陈相蒙,王恩标,王刚. 煤矿电机车无人驾驶技术研究[J]. 煤炭科学技术,2020,48(增刊2):159-164. CHEN Xiangmeng,WANG Enbiao,WANG Gang. Research on electric locomotive self-driving technology in coal mine[J]. Coal Science and Technology,2020,48(S2):159-164.

[39] 谢厚抗. 无人驾驶无轨胶轮车多传感信息融合与智能感知技术研究[D]. 徐州: 中国矿业大学, 2021. XIE Houkang. Research on multi-sensor information fusion and intelligent sensing technology for driverless trackless rubber-tyred vehicles[D]. Xuzhou: China University of Mining and Technology, 2021.

[40] 周李兵. 煤矿井下无轨胶轮车无人驾驶系统研究[J]. 工矿自动化,2022,48(6):36-48. ZHOU Libing. Research on unmanned driving system of underground trackless rubber-tyred vehicle in coal mine[J]. Journal of Mine Automation,2022,48(6):36-48.

[41] 侯刚,王国法,薛忠新,等. 煤矿辅助运输自动驾驶关键技术与装备[J]. 采矿与岩层控制工程学报,2022,4(3):5-17. HOU Gang,WANG Guofa,XUE Zhongxin,et al. Key technologies and equipment for automatic driving of coal mine auxiliary transportation[J]. Journal of Mining and Strata Control Engineering,2022,4(3):5-17.

[42] 贺海涛,廖志伟,郭卫. 煤矿井下无轨胶轮车无人驾驶技术研究与探索[J]. 煤炭科学技术,2022,50(增刊1):212-217. HE Haitao,LIAO Zhiwei,GUO Wei. Research and exploration on driverless technology of trackless rubbertyred vehicle in coal mine[J]. Coal Science and Technology,2022,50(S1):212-217.

[43] Dr. Wang. 4D成像毫米波雷达系统的发展与趋势[J]. 汽车与配件,2022(21):50-53. Dr. Wang. Development and trends of 4D imaging millimeter wave radar systems[J]. Automobile & Parts,2022(21):50-53.

[44] 李晨鑫,张立亚. 煤矿井下网联式自动驾驶技术研究[J]. 工矿自动化,2022,48(6):49-55. LI Chenxin,ZHANG Liya. Research on the network connected automatic driving technology in underground coal mine[J]. Journal of Mine Automation,2022,48(6):49-55.

[45] 邢亚男. 车路协同感知融合研究[D]. 长春: 吉林大学, 2022. XING Yanan. Research on vehicle-road collaborative perception fusion[D]. Changchun: Jilin University, 2022.

[46] 陈晓晶. 井工煤矿运输系统智能化技术现状及发展趋势[J]. 工矿自动化,2022,48(6):6-14,35. CHEN Xiaojing. Current status and development trend of intelligent technology of underground coal mine transportation system[J]. Journal of Mine Automation,2022,48(6):6-14,35.

[47] 贺海涛,张立辉,王旭峰,等. 面向矿用辅助运输车辆的智能无人运输系统研究[J]. 工矿自动化,2022,48(增刊1):72-75. HE Haitao,ZHANG Lihui,WANG Xufeng,et al. Research on intelligent unmanned transportation system for mine-used auxiliary transportation vehicles[J]. Journal of Mine Automation,2022,48(S1):72-75.

[48] 阮顺领,焦鑫,景莹,等. 一种露天矿区非结构化道路分割检测方法[J]. 测绘科学,2022,47(6):204-212. RUAN Shunling,JIAO Xin,JING Ying,et al. Road detection in mining area based on bilateral segmentation optimization network[J]. Science of Surveying and Mapping,2022,47(6):204-212.

[49] 张莹,黄影平,郭志阳,等. 基于点云与图像交叉融合的道路分割方法[J]. 光电工程,2021,48(12):32-43. ZHANG Ying,HUANG Yingping,GUO Zhiyang,et al. Point cloud-image data fusion for road segmentation[J]. Opto-Electronic Engineering,2021,48(12):32-43.

[50] 张云佐, 郑宇鑫, 武存宇, 等. 基于双特征提取网络的复杂环境车道线精准检测[J/OL]. 吉林大学学报(工学版): 1-9[2023-05-04]. https://doi.org/10.13229/j.cnki.jdxbgxb20221129. ZHANG Yunzuo, ZHENG Yuxin, WU Cunyu, et al. Accurate lane detection of complex environment based on double feature extraction network[J/OL]. Journal of Jilin University(Engineering and Technology Edition): 1-9 [2023-05-04]. https://doi.org/10.13229/j.cnki.jdxbgxb20221129.

[51] 方遒, 李伟林, 梁卓凡, 等. 基于多尺度复合卷积和图像分割融合的车道线检测算法[J/OL]. 北京理工大学学报: 1-11[2023-05-04]. https://doi.org/10.15918/j.tbit1001-0645.2022.238. FANG Qiu, LI Weilin, LIANG Zhuofan, et al. Lane line detection algorithm based on multi-scale composite convolution and image segmentation fusion[J/OL]. Transactions of Beijing Institute of Technology: 1-11[2023-05-04]. https://doi.org/10.15918/j.tbit1001-0645.2022.238.

[52] 乔晓敏. 基于深度学习的端到端井下轨道检测方法研究[D]. 合肥: 合肥工业大学, 2019. QIAO Xiaomin. The study on end-to-end downhole track detectionbased on deep learning[D]. Hefei: Hefei University of Technology, 2019.

[53] 卫星,杨国强,李佳,等. 结合多尺度条件生成对抗网络的井下轨道检测[J]. 中国图象图形学报,2020,25(2):282-293. WEI Xing,YANG Guoqiang,LI Jia,et al. Multiscale information-based conditional generative adversarial nets for downhole track detection[J]. Journal of Image and Graphics,2020,25(2):282-293.

[54] 于骞翔,张元生. 井下电机车轨道障碍物图像处理方法的智能识别技术[J]. 金属矿山,2021(8):150-157. YU Qianxiang,ZHANG Yuansheng. Track obstacle intelligent recognition technology of mine electric locomotive based on image processing[J]. Metal Mine,2021(8):150-157.

[55] 王京华,王李管,毕林. 基于计算机视觉技术的矿井电机车无人驾驶障碍物检测技术[J]. 黄金科学技术,2021,29(1):136-146. WANG Jinghua,WANG Liguan,BI Lin. Obstacle detection technology of mine electric locomotive driverless based on computer vision technology[J]. Gold Science and Technology,2021,29(1):136-146.

[56] WANG Wenshan,WANG Shuang,GUO Yongcun,et al. Detection method of obstacles in the dangerous area of electric locomotive driving based on MSE-YOLOv4-Tiny[J]. Measurement Science and Technology,2022,33(11):115403-115415. DOI: 10.1088/1361-6501/ac82db

[57] 韩江洪,卫星,陆阳,等. 煤矿井下机车无人驾驶系统关键技术[J]. 煤炭学报,2020,45(6):2104-2115. HAN Jianghong,WEI Xing,LU Yang,et al. Driverless technology of underground locomotive in coal mine[J]. Journal of China Coal Society,2020,45(6):2104-2115.

[58] 周华平,郑锐. 基于改进BiSeNet的煤矿井下轨道检测算法[J]. 湖北民族大学学报(自然科学版),2021,39(4):398-403. ZHOU Huaping,ZHENG Rui. Underground rail detection algorithm based on improved BiSeNet[J]. Journal of Hubei Minzu University(Natural Science Edition),2021,39(4):398-403.

[59] 郭永存,童佳乐,王爽. 井下无人驾驶电机车行驶场景中多目标检测研究[J]. 工矿自动化,2022,48(6):56-63. GUO Yongcun,TONG Jiale,WANG Shuang. Research on multi-object detection in driving scene of underground unmanned electric locomotive[J]. Journal of Mine Automation,2022,48(6):56-63.

[60] 胡青松,梁天河,李世银,等. 基于粒子群与模拟退火算法的改进矿井克里金定位方法[J]. 金属矿山,2023(5):221-227. HU Qingsong,LIANG Tianhe,LI Shiyin,et al. An improved Kriging location method based on particle swarm optimization and simulated annealing algorithms[J]. Metal Mine,2023(5):221-227.

-

期刊类型引用(17)

1. 李洋,崔飞,李春狄,马晓晨,提潇北. 环境信息实时感知的装配式建筑机器人施工路径自动优化. 电子设计工程. 2024(14): 82-85+90 .  百度学术

百度学术

2. 王国庆,赵鑫,杨春雨,马磊,代伟. 煤矿地下空间定位技术研究进展. 工程科学学报. 2024(10): 1713-1727 .  百度学术

百度学术

3. 陈太文. 井下无轨设备的安全与可靠性研究. 今日制造与升级. 2024(06): 163-165 .  百度学术

百度学术

4. 王维强,孟世华,严运兵. 基于激光点云的矿用无人运输车路径规划研究. 矿山机械. 2024(10): 10-15 .  百度学术

百度学术

5. 胡青松,李敬雯,张元生,李世银,孙彦景. 面向矿井无人驾驶的IMU与激光雷达融合SLAM技术. 工矿自动化. 2024(10): 21-28 .  本站查看

本站查看

6. 杨佳佳,张传伟,周李兵,秦沛霖,赵瑞祺. 矿用激光雷达与相机的无目标自动标定方法研究. 工矿自动化. 2024(10): 53-61+89 .  本站查看

本站查看

7. 张传伟,芦思颜,秦沛霖,周睿,赵瑞祺,杨佳佳,张天乐,赵聪. 融合简化可视图和A~*算法的矿用车辆全局路径规划算法. 工矿自动化. 2024(10): 12-20 .  本站查看

本站查看

8. 胡青松,李鹤,罗渝嘉,王柳笛,寇志豪,李世银. 多径与非视距影响下的精确目标定位关键技术. 金属矿山. 2024(11): 173-184 .  百度学术

百度学术

9. 韩燕南,高文,贺耀宜. 基于精确定位技术的煤矿井下小型车避让预警方法. 煤矿安全. 2024(12): 243-249 .  百度学术

百度学术

10. 魏文玉. 一种井下防爆圆木抓举车机械臂设计. 工矿自动化. 2024(S2): 288-292+297 .  本站查看

本站查看

11. 郭向东. 矿用无轨胶轮车智能管理系统的设计及应用研究. 矿业装备. 2023(11): 186-188 .  百度学术

百度学术

12. 杨志方. 基于雷达与视觉融合的双模态煤矿井下环境感知技术. 工矿自动化. 2023(11): 67-75 .  本站查看

本站查看

13. 马天,李凡卉,杨嘉怡,张杰慧,丁旭涵. 基于改进STDC的井下轨道区域实时分割方法. 工矿自动化. 2023(11): 107-114 .  本站查看

本站查看

14. 赵伟,王爽,赵东洋. 基于SD-YOLOv5s-4L的煤矿井下无人驾驶电机车多目标检测. 工矿自动化. 2023(11): 121-128 .  本站查看

本站查看

15. 李定波. 井下智能辅助运输行车安全管理系统设计. 工矿自动化. 2023(S2): 122-124 .  本站查看

本站查看

16. 包翔宇,单成伟,吴岩明. 基于毫米波雷达技术的煤矿胶轮车管控系统. 煤矿机电. 2023(05): 12-17 .  百度学术

百度学术

17. 陈湘源,潘涛,周彬. 井工煤矿无轨胶轮车全局调度模型. 工矿自动化. 2023(12): 63-69 .  本站查看

本站查看

其他类型引用(4)

下载:

下载: