UeDiff-GAN-based target detection and twin synchronization mapping for fully mechanized mining faces

-

摘要:

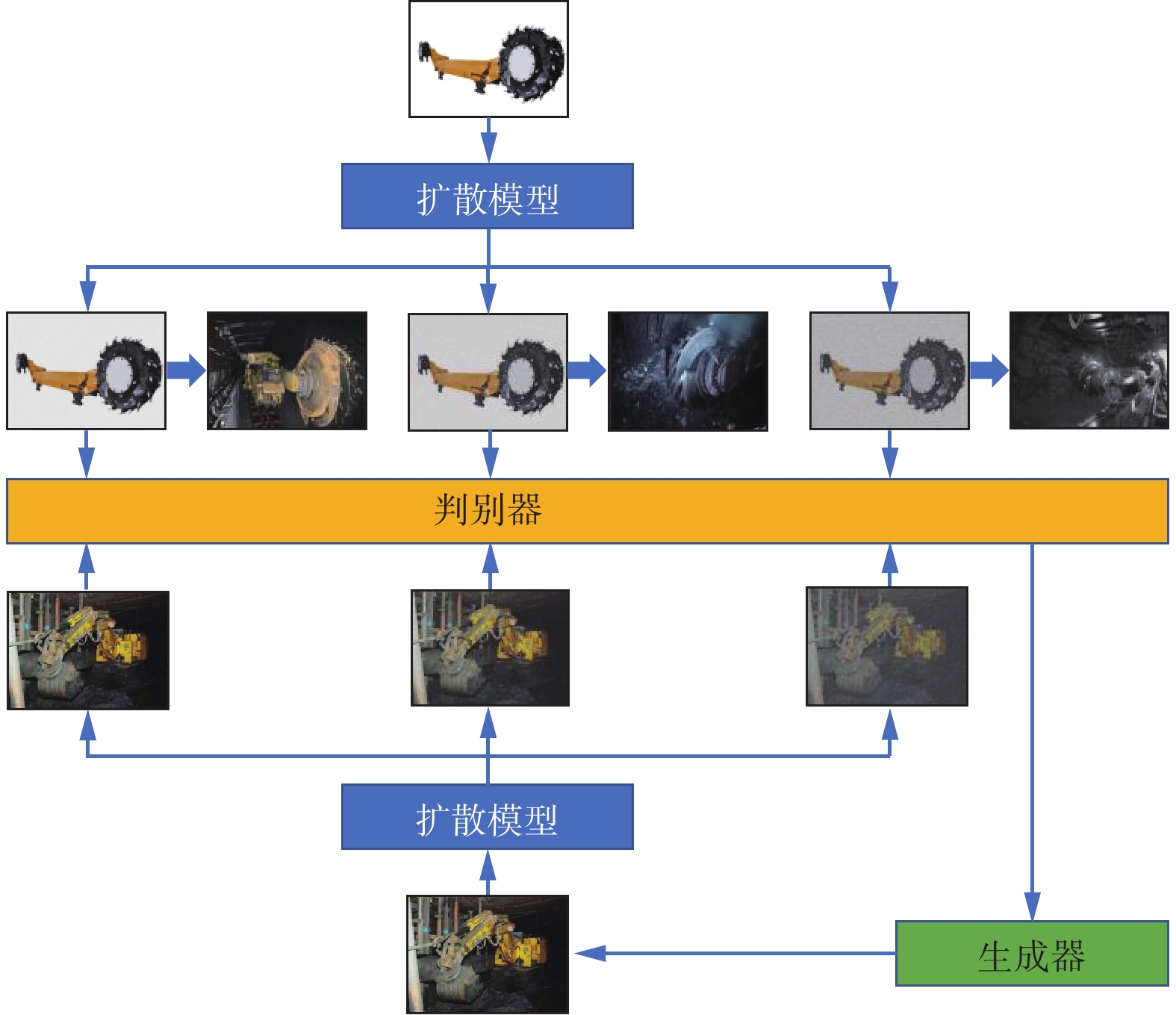

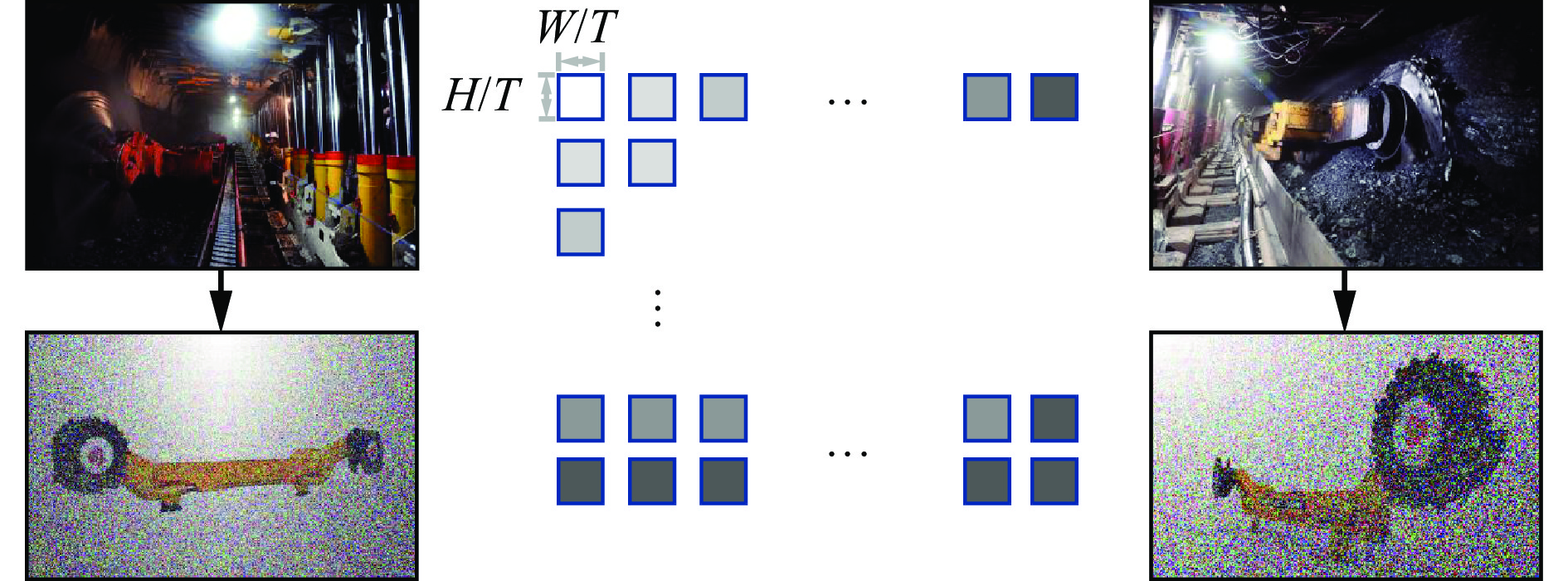

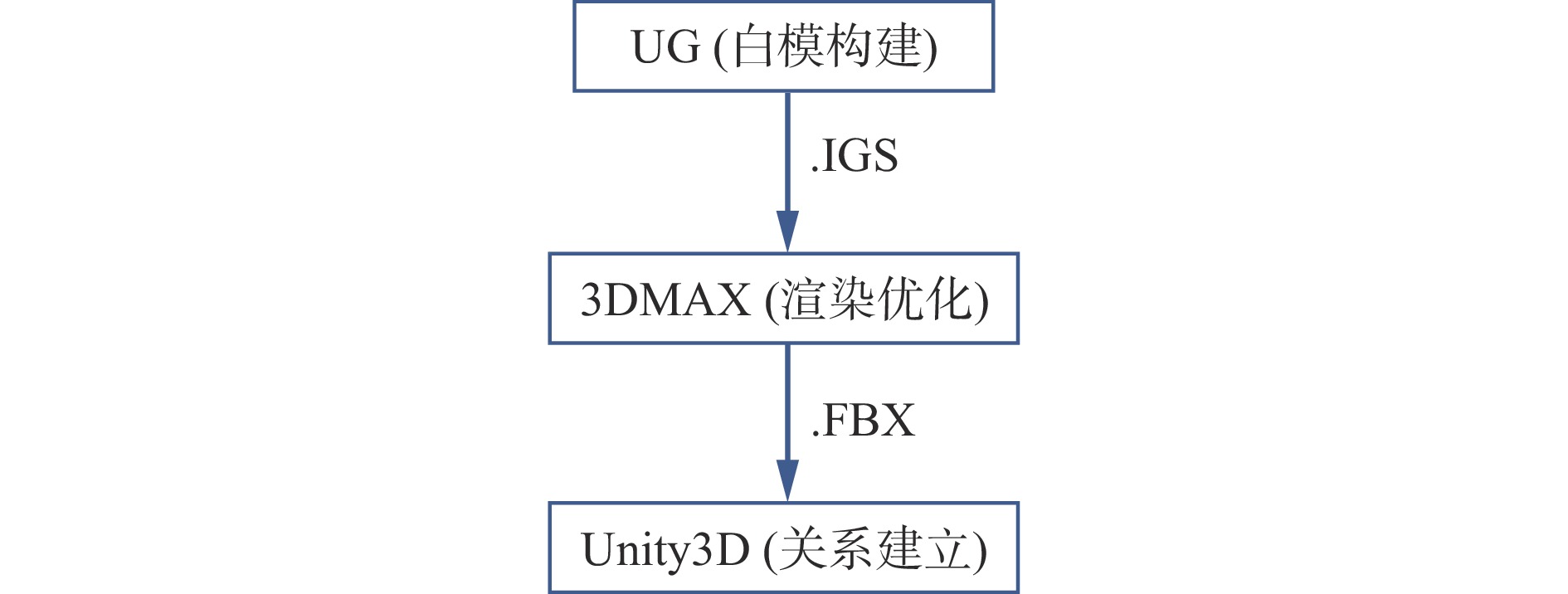

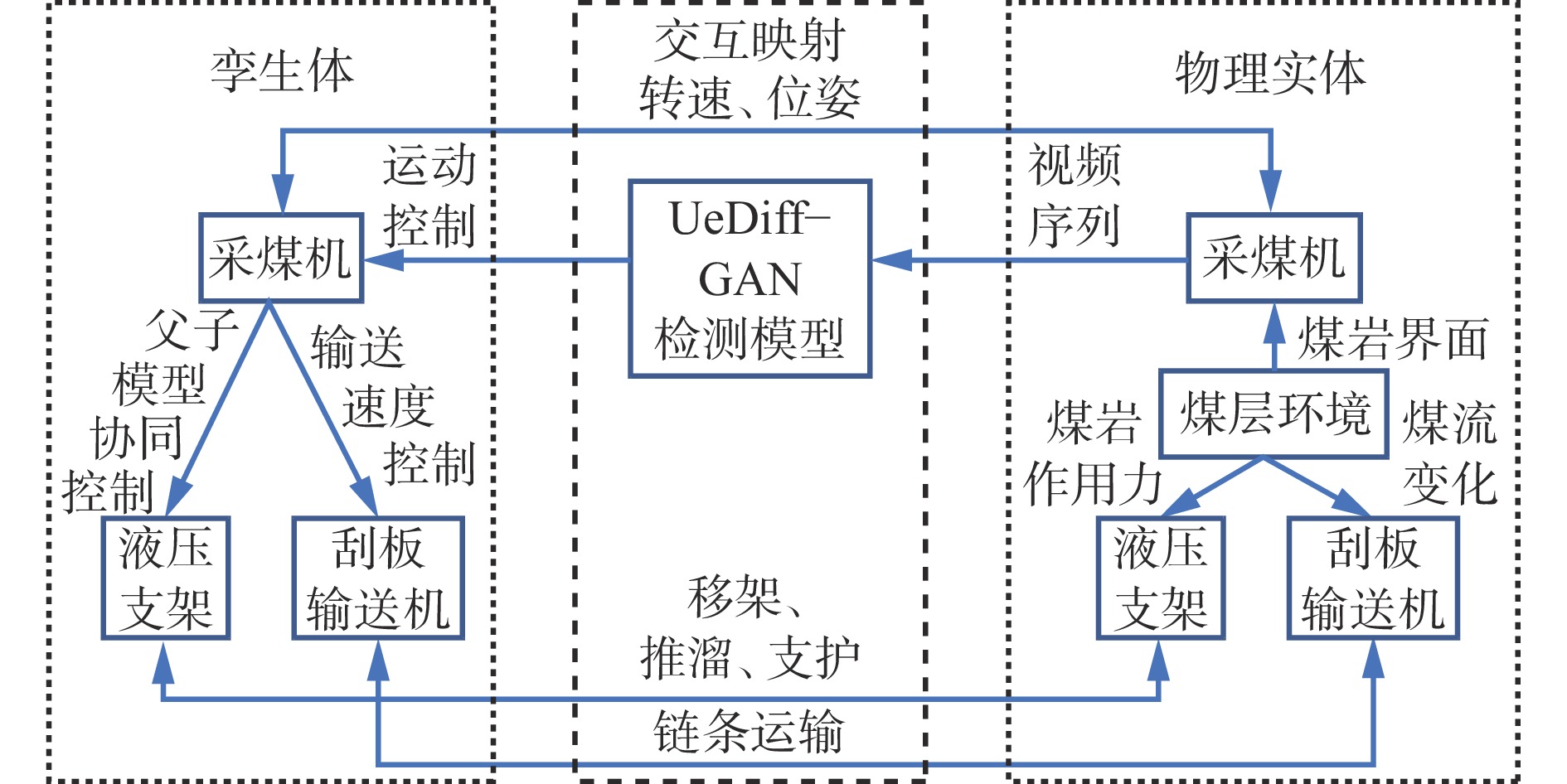

矿井综采工作面数字孪生模型的构建过程需要手动构建实体的数字孪生3D模型,然后对实体进行目标检测,并根据实时检测结果控制3D模型,以确保孪生体与实体之间的同步映射关系。因此,对井下目标的实时、准确检测是实现虚实同步映射控制的关键。目前主流的目标检测方法需要在传统模型中引入或改进模块,使得模型网络结构复杂、训练周期较长,降低了目标检测的实时性;同时,对于一些含高强度噪声的图像难以精确检测。针对上述问题,提出了一种基于UeDiff−GAN的综采工作面目标检测与孪生体同步映射方法。通过扩散模型对高质量样本进行加噪扩散,得到不同程度的加噪样本,然后使用生成对抗网络(GAN)模型进行训练;设计了平滑扩散算法,以控制扩散步长,加入不均衡扩散模块,以得到与预识别样本匹配的检测算法模型。使用Unity3D构建综采工作面3D模型并进行渲染,实现井下物理实体的对象孪生,据此构建综采工作面实体与其孪生模型的映射关系,根据井下不同位置的检测结果控制对应机器运动状态及姿态,实现孪生模型协同控制,从而实现过程孪生。在自制数据集上的实验结果表明:UeDiff−GAN模型对井下移动目标的平均检测精度较SSD,R−CNN,YOLOv7和Diff−GAN模型分别提升了19.4%,14.3%,9.1%,24.3%;检测速度较SSD,R−CNN分别提升了13.86,42.73 帧/s;孪生模型与实体的实时性延迟至多为0.873 s。

Abstract:The construction of a digital twin model for fully mechanized mining faces requires manually creating a digital twin 3D model of a physical entity, performing target detection on the entity, and adjusting the 3D model based on real-time detection results to ensure synchronization mapping between the twin and the physical entity. Therefore, real-time and accurate detection of underground targets is crucial for achieving virtual-physical synchronization mapping control. Current mainstream target detection methods require incorporating or modifying modules within traditional models, resulting in complex network structures and prolonged training cycles, which reduce the real-time performance of target detection. Moreover, these methods struggle with precisely detecting targets in images with high-intensity noise. To address these issues, this study proposed a UeDiff-GAN-based target detection and twin synchronization mapping method for fully mechanized mining faces. The diffusion model was used to add noise into high-quality samples to generate samples of varying levels, which were then used to train a generative adversarial network (GAN) model. A smooth diffusion algorithm was designed to regulate the diffusion step sizes, while an imbalanced diffusion module was incorporated to obtain a detection algorithm model that matches pre-identified samples. A 3D model of the fully mechanized mining face was constructed and rendered using Unity3D, achieving a digital twin of underground physical entities. Based on this model, a mapping relationship between the physical entity and its twin model was established. The corresponding machine's motion state and posture are controlled according to the detection results at different underground locations. This approach enabled twin model coordinated control, thereby achieving process-level twinning. Experimental results on a self-developed dataset demonstrated that the UeDiff-GAN model improved the average detection accuracy of underground moving targets by 19.4%, 14.3%, 9.1%, and 24.3% compared to SSD, R-CNN, YOLOv7, and Diff-GAN models, respectively. The detection speed improved by 13.86, 42.73 frames per second (fps) compared to SSD and R-CNN models, respectively. The real-time delay between the twin model and the physical entity was at a maximum of 0.873 seconds.

-

0. 引言

火灾一直是煤矿的重点防治灾害,一般分为内因火灾和外因火灾[1-2]。内因火灾由矿井煤层自燃引起,主要影响煤矿正常开采。外因火灾主要由人员违规违章行为引起,如违章作业、设备检修不规范、违规堆放易燃物资等,一般火灾初期的火源较小,但常发生在生产区域,如果未及时发现,火情将会迅速扩大,造成煤矿人员伤亡和财产损失[3-5]。对煤矿外因火灾隐患进行检测,实现对初期火灾的可靠判识,对于提升煤矿火灾检测水平有重要意义,也是未来智能矿山建设的重要方向。

现有的矿井外因火灾检测方法主要包括基于传感器的检测方法、基于可见光图像和红外图像的检测方法、基于深度学习的检测方法等。基于传感器的检测方法[6-8]通过传感器采集环境中的温度、烟雾浓度、气体浓度等信息,利用阈值来判断火灾的发生情况,该方法准确率较高,但对微小火源感知不明显,且判识相对滞后。基于可见光图像和红外图像的检测方法[9]主要依赖于图像识别技术,利用颜色空间进行火焰图像分割,进而提取出尖角数、圆形度、质心位移等特征,再通过支持向量机进行分类,该方法易受井下移动发光物体(如探照灯)的影响[10]。基于红外图像、可见光图像及传感器多信息融合的矿井外因火灾感知方法[10-11]与单一方法相比提升了火灾感知准确率,但该类方法采用“分布采集−集中处理−远程控制”的方式,传感器信息、控制信息的传输依赖网络可靠性,网络波动可能会导致响应延迟、报警滞后等问题。随着深度学习在图像分类[12]、目标检测[13]等方面取得进展,卷积神经网络[14]、改进Mask R−CNN[15]、改进Faster−CNN [16]等被应用于火焰特征检测,该类方法对特征的识别精度更高,但网络模型参数量、计算量较大,检测速度慢,应用于煤矿时,通常需要配置高性能处理器,在地面集中处理视频信息,对视频图像传输网络的可靠性有较高要求。

YOLO[17]是一种单阶段目标检测网络模型,其检测速度快,适合部署在边缘侧硬件上,但对火灾初期小目标火源的识别能力不足。针对该问题,本文提出一种基于边缘智能的煤矿外因火灾感知方法。对YOLOv5s模型进行改进,在保证处理速度和轻量化的前提下,提高对火灾初期小目标火源的识别精度;对改进YOLOv5s模型提取的图像特征和传感器提取的物理特征进行融合分析,并将改进网络模型部署在智能边缘处理器上,用于煤矿外因火灾识别。这种煤矿灾害感知的新模式提高了火源检测的实时性和准确性,且不依赖长距离传输网络,提升了检测的可靠性,可用于矿山重点区域风险监控,为未来矿山的火源智能化巡检提供了算法支撑。

1. 基于边缘智能的煤矿外因火灾检测模型

基于边缘智能的煤矿外因火灾检测模型主要由视频检测模块、多源信息融合模块及智能边缘处理模块组成,如图1所示。在智能边缘处理器上部署轻量化的改进YOLOv5s模型和多源信息融合模块,分别提取火源的图像特征和环境信息的多维度时空特征,通过特征融合判断是否发生火灾。

智能边缘处理器是基于嵌入式微控制单元(Microcontroller Unit,MCU)和国产神经网络处理单元(Neural Processor Unit,NPU)开发的一款矿用边缘处理器。其核心是思元220边缘计算模组,具备专门用于深度学习的系统级芯片(System on Chip,SOC),采用ARM+NPU架构,芯片内部集成了CPU、NPU、视频处理单元及图像编解码单元;CPU为四核ARM Cortex−A55,主频为1.5 GHz,单片功耗为12 W,核心算力为每秒12×1012次操作。智能边缘处理器支持深度学习网络AlexNet,GoogleNet,VGG,ResNet,YOLO,SSD等。

采用矿用本安型网络摄像机KBA18(C)进行视频数据采集。摄像机在监测区域按一定距离部署,并通过网络接口与智能边缘处理器相连,为火灾检测提供视频图像数据。

采用矿用一氧化碳传感器GTH1000、矿用烟雾传感器GQLQ5及矿用温度传感器GWD150进行环境数据采集。传感器部署在矿用本安型网络摄像机周围,通过Modbus总线与智能边缘处理器相连,为火灾检测提供传感器数据。

2. 改进YOLOv5s模型

2.1 YOLOv5s模型基本架构

YOLOv5s模型的基本框架可以分为输入端(Input)、主干网络(Backbone)、颈部(Neck)和输出端(Prediction)4个部分,如图2所示。输入端采用Mosaic数据增强方式,通过随机缩放、裁剪、排布对图像进行拼接。主干部分主要由跨阶段局部网络(Cross Stage Partial Network,CSPNet)模块组成,特征提取采用CSPDarknet53[18]网络结构,可降低计算损耗和内存成本。颈部使用特征金字塔网络(Feature Pyramid Network,FPN)和路径聚合网络(Path Aggregation Network, PANet)[19]来加强特征融合能力。输出部分主要由损失函数构成,采用CIOU_Loss作为损失函数,最后输出预测结果。

2.2 小目标检测层

为更适应火灾初期小目标火源的特征检测,提高小目标火源实时检测精度,综合考虑火焰检测精度和速度要求,在经典YOLOv5s模型基础上添加一个152×152的特征尺度,并改进为4尺度检测网络(图3),将目标的感受野变为4×4,使模型能够充分学习浅层特征,改善小目标检测性能。

2.3 自适应注意模块

YOLOv5s模型中,颈部使用FPN和PANet来加强其特征融合能力,然而在采样过程中,高层特征图会因为特征通道数的减少而造成上下文信息损失,影响检测精度。针对该问题,在原有FPN基础上添加自适应注意模块,通过空间注意力机制为每个特征图生成空间权重图,通过权重图融合上下文特征,生成包含多尺度上下文信息的新特征图,以减少上下文信息损失。

首先,将卷积得到的特征图

$ {M}_{5} $ (大小为$ S $ )通过自适应平均池化层,获得不同尺度(${a }_{1}\times S,{a}_{2}\times S, {a}_{3}\times S$ )的多个语境特征,池化系数$a$ 1—$a$ 3可根据数据集中目标大小自适应变化。其次,将每个特征分别上采样后通过Concat层合并,得到特征图$ {C}_{5} $ 。$ {C}_{5} $ 依次经过1×1卷积层、ReLU激活层、3×3卷积层及Sigmoid激活层,得到空间权重图$ {W}_{5} $ 。最后,将特征图$ {C}_{5} $ 和权重图$ {W}_{5} $ 进行Hadamard乘积运算,分离后与特征图$ {M}_{5} $ 相加,得到包含多尺度上下文信息的新特征图$ {A}_{5} $ ,$ {A}_{5} $ 具有丰富的多尺度背景信息,在一定程度上缓解了由于通道数量减少而造成的信息损失,提高了模型的检测精度。自适应注意模块结构如图4所示。3. 多源信息融合

为解决井下光线条件差、粉尘多及摄像机拍摄角度引起的图像检测误差和漏检问题,进一步提高火灾检测精度,本文采用多传感器辅助检测,并提出一种动态加权算法,对图像和传感信息进行加权融合判识,具体流程如图5所示。

计算图像和传感信息动态加权值:

$$ F=\left[{\alpha }_{1}\;{\alpha }_{2}\;{\alpha }_{3}\;{\alpha }_{4}\right][{\beta }_{1}\;\;{{\beta }_{2}\;\;{\beta }_{3}\;\;{\beta }_{4}]}^{\mathrm{T}} $$ (1) 式中:

$ {\alpha }_{1}—{\alpha }_{4} $ 分别为摄像机、温度传感器、烟雾传感器、CO传感器的检测结果,取值为1或0;$ {\beta }_{1}—{\beta }_{4} $ 为对应$ {\alpha }_{1}—{\alpha }_{4}\mathrm{的} $ 权重参数,4个权重参数的和为1。$ {\alpha }_{1}=0 $ 表示摄像机未检测到火焰,$ {\alpha }_{1}=1 $ 表示摄像机检测到火焰;$ {\alpha }_{2}=0 $ 表示井下温度在正常范围内,$ {\alpha }_{2}=1 $ 表示井下温度已经超过正常情况;$ {\alpha }_{3}=0 $ 表示井下没有烟雾或者烟雾浓度忽略不计,$ {\alpha }_{3}=1 $ 表示井下烟雾浓度异常;$ {\alpha }_{4}=0 $ 表示井下CO浓度在正常范围内,$ {\alpha }_{4}=1 $ 表示井下CO浓度异常。根据文献[20]设定权重参数,并以此为基础进行多组实验,得出最优权重参数和阈值,实验结果见表1。

表 1 各权重对比分析结果Table 1. Comparative analysis results of each weight$ {\beta }_{1} $ $ {\beta }_{2} $ $ {\beta }_{3} $ $ {\beta }_{4} $ 阈值 准确率 0.70 0.1 0.1 0.1 0.81 0.83 0.75 0.12 0.07 0.06 0.85 0.88 0.81 0.08 0.06 0.05 0.88 0.90 0.90 0.05 0.03 0.02 0.92 0.98 0 0.65 0.25 0.1 0.7 0.75 0 0.73 0.22 0.07 0.8 0.80 0 0.78 0.14 0.08 0.83 0.87 0 0.79 0.11 0.10 0.89 0.90 当所有检测信息的动态加权值超过设定阈值时,表示检测到火灾发生。根据表1数据可得出,当视频检测到真实火焰时,设定

$\; {\beta }_{1}—{\beta }_{4} $ 及阈值分别为0.90,0.05,0.03,0.02,0.92,检测准确率最高。当视频未检测到真实火焰时或者误检时,设定$\; {\beta }_{2}—{\beta }_{4} $ 及阈值分别为0.79,0.11,0.10,0.89,检测准确率最高。4. 实验分析

4.1 数据集制作

为了提升本文方法在煤矿井下的检测性能,制作了火源特征数据集。该数据集由公共数据集(VOC2007)、项目组拍摄的12 000张图像、100张井下各种灯光图像构成,包含了火焰燃烧整个过程(从初期到后期,直至熄灭)的图像,涵盖不同光线条件和粉尘浓度情况。基于混合数据集训练网络模型,可提升模型的泛化能力。

图像拍摄地点为中国矿业大学火灾实验室和某煤矿提供的实验巷道(图6)。针对煤矿井下作业环境及相机拍摄角度的影响,采用多角度拍摄方式,拍摄参数见表2。

表 2 图像拍摄参数Table 2. Image capture parameters相机编号 拍摄角度 安装高度/cm 图像/张 光线 粉尘 1号 正水平 0 1 000 正常 少 2号 正水平 0 2 000 较暗 多 3号 正45° 210 1 000 正常 多 4号 正45° 210 2 000 较暗 少 5号 后水平 0 1 000 正常 少 6号 后水平 0 2 000 较暗 多 7号 后45° 210 1 000 正常 多 8号 后45° 210 2 000 较暗 多 1号和2号相机的安装高度为0,表示相机正对火焰拍摄。3号和4号相机拍摄角度为正45°,表示相机在火焰正前方45°拍摄。部分现场拍摄样本如图7所示。

4.2 参数设置与评价指标

设置所有模型训练批次为16,学习率为 0.001,交并比阈值为0.5,训练轮数为100,在NVIDIA TITAN Xp GPU上训练模型。以召回率、交并比为0.5时的平均精度均值(mAP@0.5)及每帧推理时间作为模型评估指标。召回率计算公式为

$$ R=\frac{{n}_{\mathrm{T}\mathrm{P}}}{{n}_{\mathrm{F}\mathrm{N}}+{n}_{\mathrm{T}\mathrm{P}}} $$ (2) 式中:R为召回率;

$ {n}_{\mathrm{T}\mathrm{P}} $ 为模型检测结果为正值的正样本数;$ {n}_{\mathrm{F}\mathrm{N}} $ 为检测结果为负值的正样本数。mAP@0.5计算公式为

$$ Q={\int }_{0}^{1}R P{\rm{d}}r $$ (3) $$ P=\frac{{n}_{\mathrm{T}\mathrm{P}}}{{n}_{\mathrm{F}\mathrm{P}}+{n}_{\mathrm{T}\mathrm{P}}} $$ (4) 式中:Q为mAP@0.5的值;P为精确率;r为积分变量;

$ {n}_{\mathrm{F}\mathrm{P}} $ 为虚假的正样本数。4.3 实验结果分析

由于本文提出的方法由图像特征检测与传感器检测共同构成,为了与经典视频检测方法进行比较,先在YOLOv5s模型中加入小目标检测和自适应注意模块,得到YOLOv5s−a,再加入传感器信息融合判识,得到YOLOv5s−as。在各训练参数一致的前提下,与YOLOv5s,SSD−300[21],SSD−521[22]等经典图像识别模型比较召回率、mAP@0.5、每帧推理时间等,结果见表3。由表3可知,YOLOv5s−as模型由于通过图像特征和传感器感知特征共同判识,识别精度最高,但由于增加了传感器信息推理,每帧推理时间比YOLOv5s−a模型略有增加,但仍优于其他模型,原因在于改进模型对图像进行特征提取时视野更集中,处理速度更快。

表 3 各模型移植前检测结果对比Table 3. Comparison of detection results of each algorithm before transplantation模型 召回率 mAP@0.5 每帧推理时间/ms SSD 300(VGG16) 0.764 0.732 26 SSD 521(VGG16) 0.779 0.751 62 YOLOv5s 0.825 0.811 24 YOLOv5s−a 0.915 0.907 18 YOLOv5s−as 0.967 0.941 20 将上述模型移植到智能边缘处理器上,并进行轻量化处理,在煤矿安全实验室模拟井下巷道场景,进行50次着火实验,以测试各模型在真实场景下的每帧推理时间及精度,实验结果见表4。

表 4 各模型移植后检测结果对比Table 4. Comparison of detection results of each algorithm after transplantation模型 每帧推理时间/ms mAP@0.5 SSD 300(VGG16) 19 0.710 SSD 521(VGG16) 53 0.742 YOLOv5s 18 0.803 YOLOv5s−a 11 0.870 YOLOv5s−as 12 0.933 由表4可知,经过轻量化处理后,YOLOv5s−as模型的处理速度仍大于SSD 300(VGG16),SSD 521(VGG16)及YOLOv5s模型。但由于需对传感器信息和视频检测信息进行融合推理,每帧推理时间略长于YOLOv5s−a模型,但mAP@0.5提高了7.24%,与移植前的YOLOv5s模型相比,mAP@0.5提高了15.04%。

为了验证YOLOv5s−as模型的泛化能力,分别进行大目标火源、小目标火源和混淆实验,结果如图8所示。对于大目标火源,所有模型均能正常识别;对于小目标火源,SSD 300,SSD 512及YOLOv5s模型无法识别,这3种模型对小目标火源的适应性较差。YOLOv5s−a,YOLOv5s−as模型能够检测出小目标火源,适应性较好。

在混淆实验中,控制火焰亮度和形状趋近灯光,进行对比实验,发现除YOLOv5s−as模型外所有模型都将其识别为灯光。这是由于YOLOv5s−as模型加入了传感器信息融合判别,得到了正确结果,并发出警报。

4.4 边缘计算性能测试

为了比较边缘处理与传统的集中式处理2种方案的性能,将YOLOv5s−as模型从完成判识到报警输出的时间定义为响应周期,并进行对比测试。

集中式处理:将传感器数据通过RS485总线转以太网模块,并接入KJJ148井下环网交换机;摄像机通过网口接入KJJ148井下环网交换机,交换机通过光纤接入服务器;在服务器上部署YOLOv5s−as模型,对采集的视频和传感器信息进行分析和识别。主机硬件:CPU为英特尔E5−2609,64 GB RAM 和1 TB固态磁盘,GPU为Nvidia TITAN Xp,网络测试带宽为300 Mbit/s,处理结果下行至现场的网络报警器。

边缘处理:传感数据、视频数据、报警器均通过网络接口接入边缘智能处理器,处理器每秒钟可进行12×1012次操作,网络传输带宽为300 Mbit/s。

对比结果见表5。可看出使用集中式处理方法时,需要经过5个步骤,响应周期为388 ms;使用边缘处理方式时,仅包括3个步骤,响应周期为238 ms,比集中式处理方法缩短了38.66%。

表 5 边缘计算性能测试结果Table 5. Edge computing performance test results步骤 边缘处理 集中式处理 步骤1 捕获图像用时39 ms 捕获图像用时39 ms 步骤2 边缘计算用时157 ms 上传图像用时154 ms 步骤3 响应警报用时42 ms 算法计算用时49 ms 步骤4 — 反馈检测结果用时104 ms 步骤5 — 响应警报用时42 ms 响应周期/ms 238 388 5. 结论

(1) 针对火灾初期的小目标火源,对YOLOv5s模型主干网络特征尺度进行改进,充分学习浅层特征,提高对小目标检测的能力;对YOLOv5s模型的颈部进行改进,在原有的FPN基础上添加自适应注意模块,提高模型检测精度。

(2) 提出基于多源信息融合对井下火灾进行判识,使用动态加权算法将视频检测信息与多传感器检测信息相融合,构建了YOLOv5s−as模型。利用YOLOv5s−as模型的轻量化特点,实现边缘智能设备部署。

(3) 实验结果表明:与未加入传感器信息融合推理的YOLOv5s−a模型相比,YOLOv5s−as模型推理时间略长,但mAP@0.5提高了7.24%;与移植前的YOLOv5s模型相比,移植到智能边缘处理器上并进行轻量化处理的YOLOv5s−as模型mAP@0.5提高了15.04%;对于小目标火源,SSD 300、SSD 512及YOLOv5s模型无法识别,YOLOv5s−a,YOLOv5s−as模型能够检测出小目标火源,适应性较好;使用边缘处理方式时,YOLOv5s−as模型的响应周期为238 ms,比集中式处理方法缩短了38.66%。

(4) 基于边缘智能的煤矿外因火灾感知方法准确率较高,响应周期短,满足煤矿井下对火灾检测的实时性要求,适用于井下重点区域的外因火灾检测,也可用于未来智能矿山的智能巡检。

-

表 1 各模型对比结果

Table 1 Comparison of different models

模型 检测精度% 平均检测

精度%检测速度/

(帧·s−1)采煤机 人 车辆 SSD 72.3 87.1 71.9 77.1 45.60 R−CNN 77.4 88.2 75.8 80.5 16.73 YOLOv7 82.6 90.9 81.0 84.8 70.56 Diff−GAN 67.4 74.9 65.1 69.1 59.71 UeDiff−GAN 91.7 92.4 91.0 91.7 59.46 表 2 消融实验结果

Table 2 Results of ablation experiment

模型 检测精度% 平均检测

精度%检测速度/

(帧·s−1)采煤机 人 车辆 Diff−GAN 67.4 74.9 65.1 69.1 59.71 模型1 88.7 89.3 88.1 88.7 59.50 模型2 74.3 83.0 73.1 76.8 59.66 UeDiff−GAN 91.7 92.4 91.0 91.7 59.46 -

[1] 邢震. 面向智能矿山的数字孪生技术研究进展[J]. 工矿自动化,2024,50(3):22-34,41. XING Zhen. Research progress on digital twin technology for intelligent mines[J]. Journal of Mine Automation,2024,50(3):22-34,41.

[2] 张旭辉. 打造数字孪生行业生态,突破采掘装备远程控制[J]. 西安科技大学学报,2023,43(1):2. ZHANG Xuhui. Creating digital twin industry ecology,advancing remote control of mining equipment[J]. Journal of Xi'an University of Science and Technology,2023,43(1):2.

[3] 鲍久圣,张可琨,王茂森,等. 矿山数字孪生MiDT:模型架构、关键技术及研究展望[J]. 绿色矿山,2023(1):166-177. BAO Jiusheng,ZHANG Kekun,WANG Maosen,et al. Mine digital twin:model architecture,key technologies and research prospects[J]. Journal of Green Mine,2023(1):166-177.

[4] 张帆,葛世荣,李闯. 智慧矿山数字孪生技术研究综述[J]. 煤炭科学技术,2020,48(7):168-176. ZHANG Fan,GE Shirong,LI Chuang. Research summary on digital twin technology for smart mines[J]. Coal Science and Technology,2020,48(7):168-176.

[5] 张帆,葛世荣. 矿山数字孪生构建方法与演化机理[J]. 煤炭学报,2023,48(1):510-522. ZHANG Fan,GE Shirong. Construction method and evolution mechanism of mine digital twins[J]. Journal of China Coal Society,2023,48(1):510-522.

[6] 熊思博,王琦,刘光洁. 三维重建技术的发展与现状研究综述[J]. 电脑知识与技术,2022,18(36):114-117. XIONG Sibo,WANG Qi,LIU Guangjie. A review on the development and current status of 3D reconstruction technology[J]. Computer Knowledge and Technology,2022,18(36):114-117.

[7] 齐海明,李俊林,罗广利. 基于三维激光扫描技术的地下矿山三维模型重建方法研究[J]. 经纬天地,2023(1):79-81. DOI: 10.3969/j.issn.1673-7563.2023.01.023 QI Haiming,LI Junlin,LUO Guangli. Research on 3D model reconstruction method of underground mine based on 3D laser scanning technology[J]. Survey World,2023(1):79-81. DOI: 10.3969/j.issn.1673-7563.2023.01.023

[8] 苗丙,葛世荣,郭一楠,等. 煤矿数字孪生智采工作面系统构建[J]. 矿业科学学报,2022,7(2):143-153. MIAO Bing,GE Shirong,GUO Yinan,et al. Construction of digital twin system for intelligent mining in coal mines[J]. Journal of Mining Science and Technology,2022,7(2):143-153.

[9] 郭虎升. 目标检测综述:从传统方法到深度学习[J]. 新兴科学和技术趋势,2024(2):128-145. DOI: 10.12405/j.issn.2097-1486.2024.02.002 GUO Husheng. Object detection:from traditional methods to deep learning[J]. Emerging Science and Technology,2024(2):128-145. DOI: 10.12405/j.issn.2097-1486.2024.02.002

[10] 高涵,赵培培,于正,等. 基于特征增强与Transformer的煤矿输送带异物检测[J]. 煤炭科学技术,2024,52(7):199-208. GAO Han,ZHAO Peipei,YU Zheng,et al. Coal mine conveyor belt foreign object detection based on feature enhancement and Transformer[J]. Coal Science and Technology,2024,52(7):199-208.

[11] 王宇,于春华,陈晓青,等. 基于多模态特征融合的井下人员不安全行为识别[J]. 工矿自动化,2023,49(11):138-144. WANG Yu,YU Chunhua,CHEN Xiaoqing,et al. Recognition of unsafe behaviors of underground personnel based on multi modal feature fusion[J]. Journal of Mine Automation,2023,49(11):138-144.

[12] 陈伟,江志成,田子建,等. 基于YOLOv8的煤矿井下人员不安全动作检测算法 [J/OL]. 煤炭科学技术:1-19[2024-08-18]. http://kns.cnki.net/kcms/detail/11.2402.td.20240322.1343.003.html. CHEN Wei,JIANG Zhicheng,TIAN Zijian,et al. YOLOv8-based algorithm for detecting unsafe movements of underground personnel in coal mines[J/OL]. Coal Science and Technology:1-19[2024-08-18]. http://kns.cnki.net/kcms/detail/11.2402.td.20240322.1343.003.html.

[13] 杨伟康,吕文生,杨鹏,等. 基于倒置残差的井下无人车目标检测研究[J]. 矿业研究与开发,2024,44(4):222-227. YANG Weikang,LYU Wensheng,YANG Peng,et al. Research on target detection of underground unmanned vehicle based on inverted residual[J]. Mining Research and Development,2024,44(4):222-227.

[14] 周浩,叶夏磊,包志舟,等. 数字孪生机器人虚实双向控制方法研究[J]. 机电工程技术,2024,53(12):135-140. ZHOU Hao,YE Xialei,BAO Zhizhou,et al. Research on virtual real bidirectional control method for digital twin robots[J]. Mechanical & Electrical Engineering Technology,2024,53(12):135-140.

[15] 牛进鑫,孙文磊,刘国良,等. 基于数字孪生驱动的机器人运动仿真与状态虚实同步映射研究[J]. 现代制造工程,2024(5):48-55. NIU Jinxin,SUN Wenlei,LIU Guoliang,et al. Research on robot motion simulation and virtual-real synchronized mapping driven by digital twins[J]. Modern Manufacturing Engineering,2024(5):48-55.

[16] SA Guodong,SUN Jiacheng,HOU Mingjie,et al. A digital twin synchronous evolution method of CNC machine tools associated with dynamic and static errors[J]. The International Journal of Advanced Manufacturing Technology,2024,134(5):2753-2763.

[17] WANG Zhendong,ZHENG Huangjie,HE Pengcheng,et al. Diffusion-GAN:training GANs with diffusion[EB/OL]. [2024-08-16]. https://arxiv.org/abs/2206.02262.

[18] HO J,JAIN A,ABBEEL P. Denoising diffusion probabilistic models[J]. Advances in Neural Information Processing Systems,2020,33:6840-6851.

[19] GOODFELLOW I J,POUGET-ABADIE J,MIRZA M,et al. Generative adversarial nets[C]. 28th Annual Conference on Neural Information Processing Systems,Montreal,2014:2672-2680.

[20] 王鑫,吴士良. 智能综采工作面系统设计及关键技术研究[J]. 中国煤炭,2024,50(9):73-79. WANG Xin,WU Shiliang. Research on system design and key technology of intelligent fully mechanized mining face[J]. China Coal,2024,50(9):73-79.

[21] 张捷. UG软件在汽车车身CAD建模中的使用[J]. 内燃机与配件,2021(19):206-207. DOI: 10.3969/j.issn.1674-957X.2021.19.097 ZHANG Jie. Application of UG software in auto body CAD modeling[J]. Internal Combustion Engine & Parts,2021(19):206-207. DOI: 10.3969/j.issn.1674-957X.2021.19.097

[22] 王进峰,问丛川,花广如,等. 基于Unity3D的数控机床数字孪生系统设计与实现[J]. 中国工程机械学报,2023,21(5):443-448. WANG Jinfeng,WEN Congchuan,HUA Guangru,et al. Design and implementation of digital twin system for CNC machine tools based on Unity3D[J]. Chinese Journal of Construction Machinery,2023,21(5):443-448.

[23] 陈述,鲁世立,王建平,等. 融合Unity3D的缆索起重机安全运行数字孪生模型构建方法[J]. 中国安全生产科学技术,2024,20(1):154-159. CHEN Shu,LU Shili,WANG Jianping,et al. Construction method of digital twin model for safe operation of cable crane by integrating Unity3D[J]. Journal of Safety Science and Technology,2024,20(1):154-159.

-

期刊类型引用(4)

1. 邓军,李鑫,王凯,王伟峰,闫军,汤宗情,康付如,任帅京. 矿井火灾智能监测预警技术近20年研究进展及展望. 煤炭科学技术. 2024(01): 154-177 .  百度学术

百度学术

2. 刘慧敏,张彬. 永定庄煤业3-5#煤层系统性防灭火设计分析. 山西化工. 2024(04): 195-196+223 .  百度学术

百度学术

3. 杨莹,吴爱祥,王先成,王国立. 基于RAdam算法优化ResNet50模型膏体图像识别方法研究. 中国矿业. 2023(07): 79-86 .  百度学术

百度学术

4. 杜雨馨,张贺,王树臣,张建化. 综掘系统视觉处理技术研究现状及发展趋势. 工矿自动化. 2023(11): 22-38+75 .  本站查看

本站查看

其他类型引用(6)

下载:

下载: