Research status and development trends of SLAM technology in autonomous mining field

-

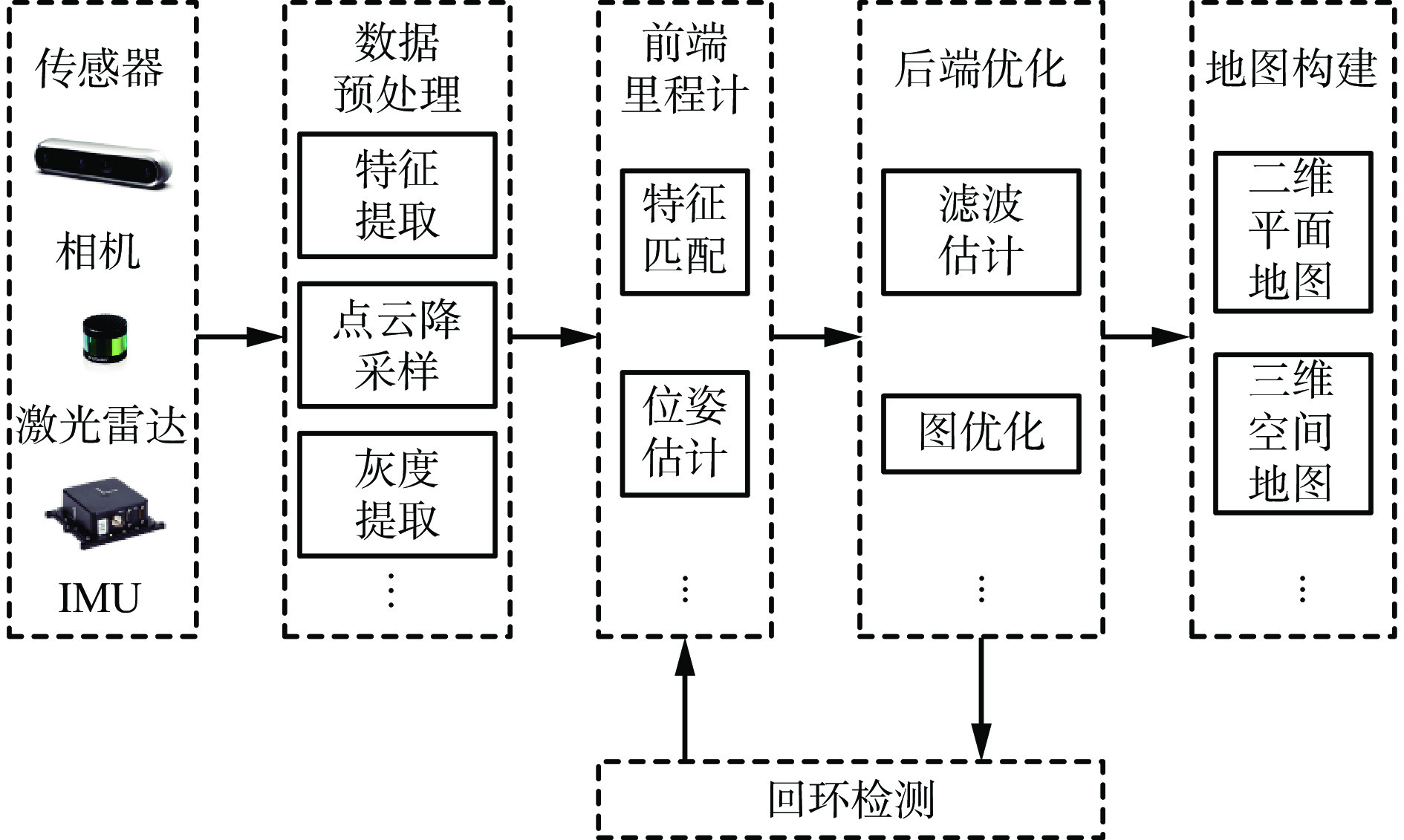

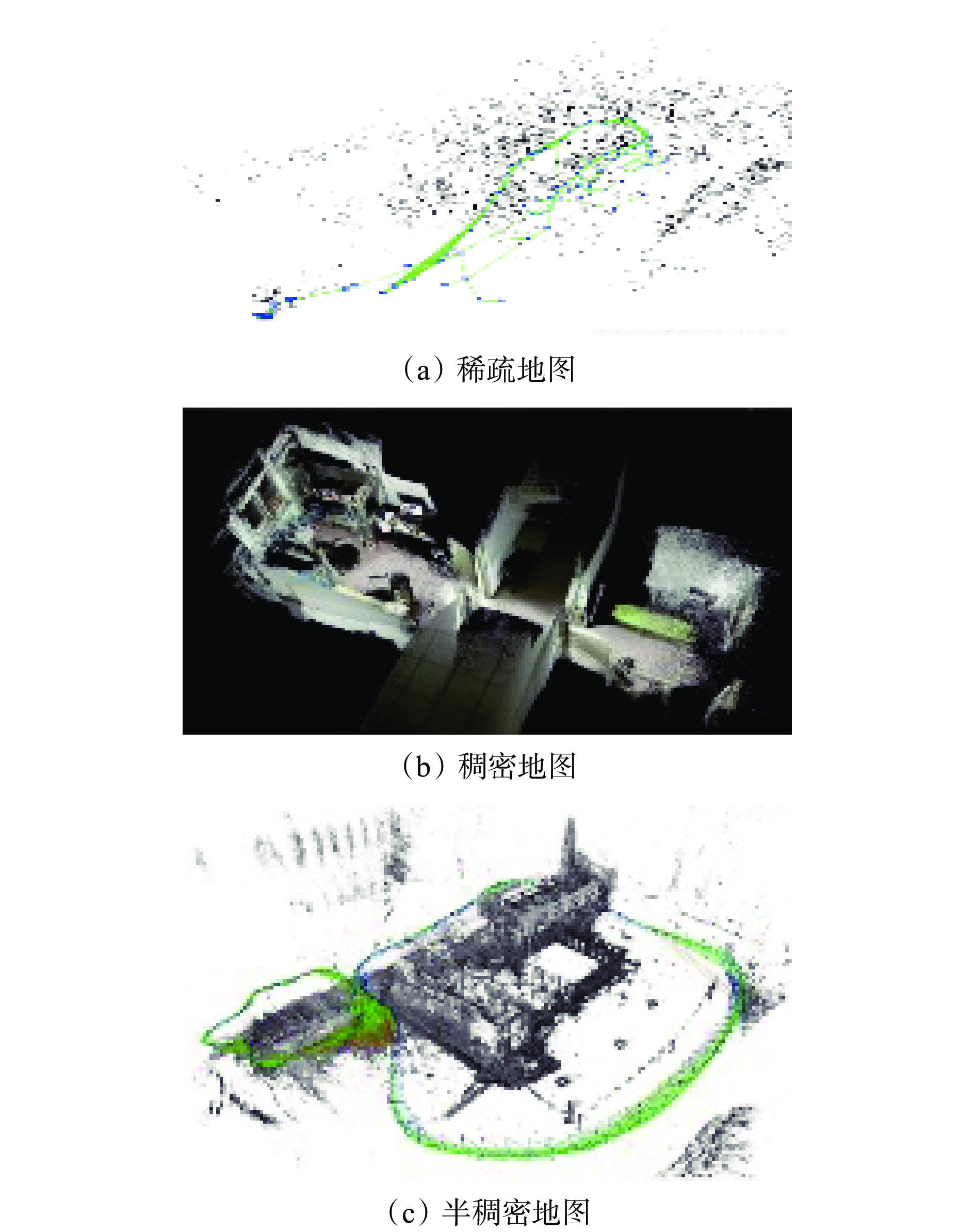

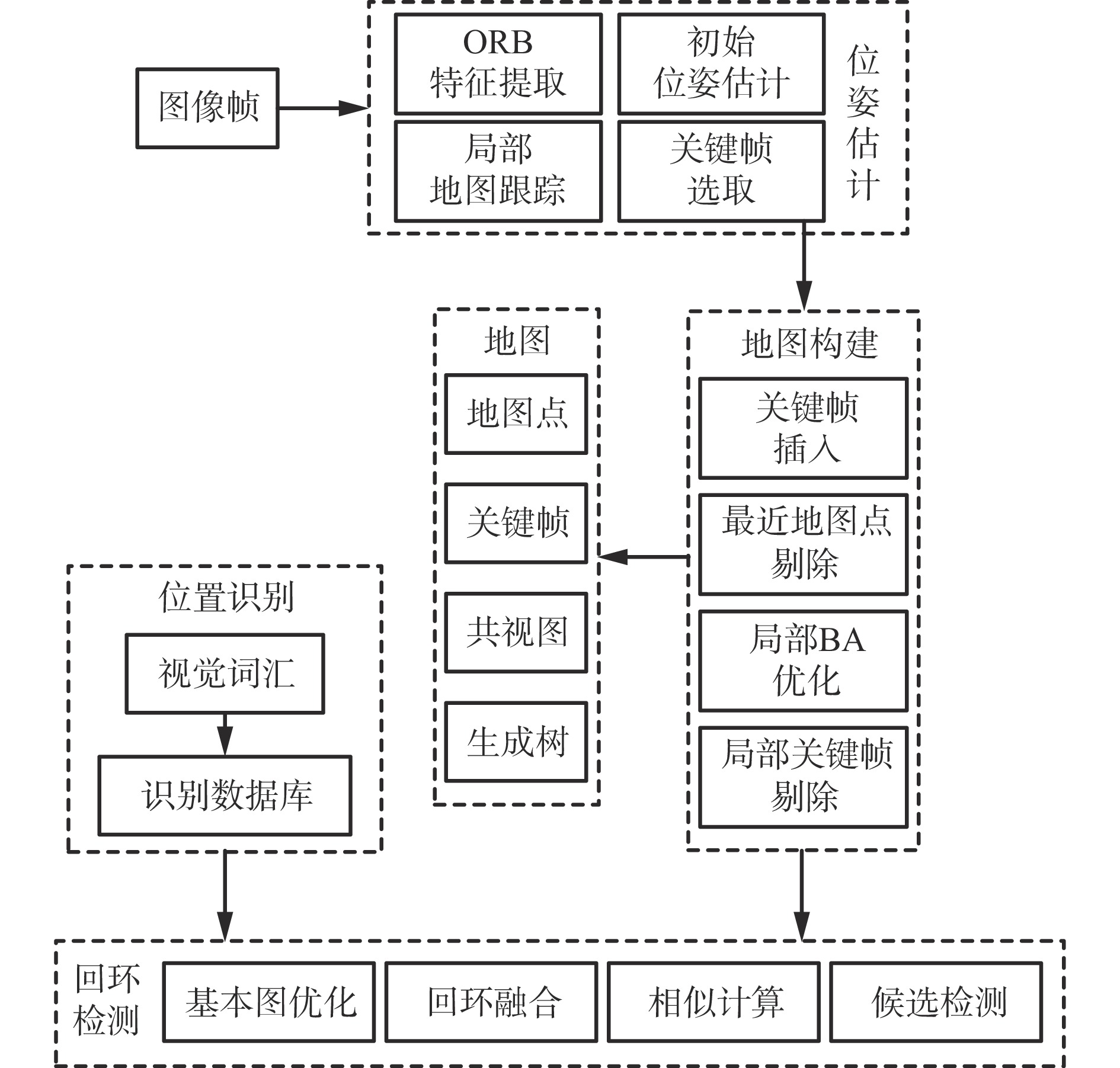

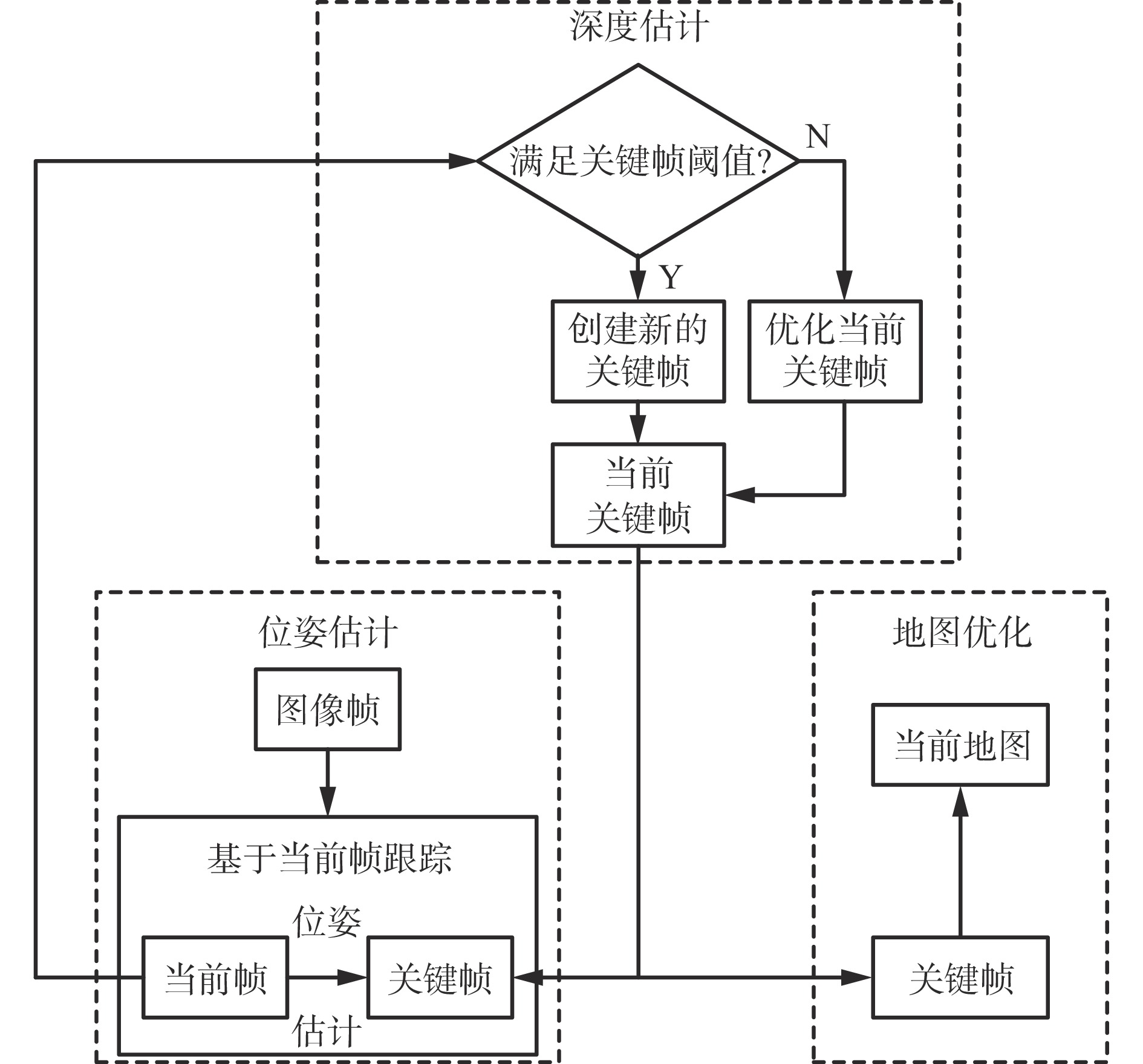

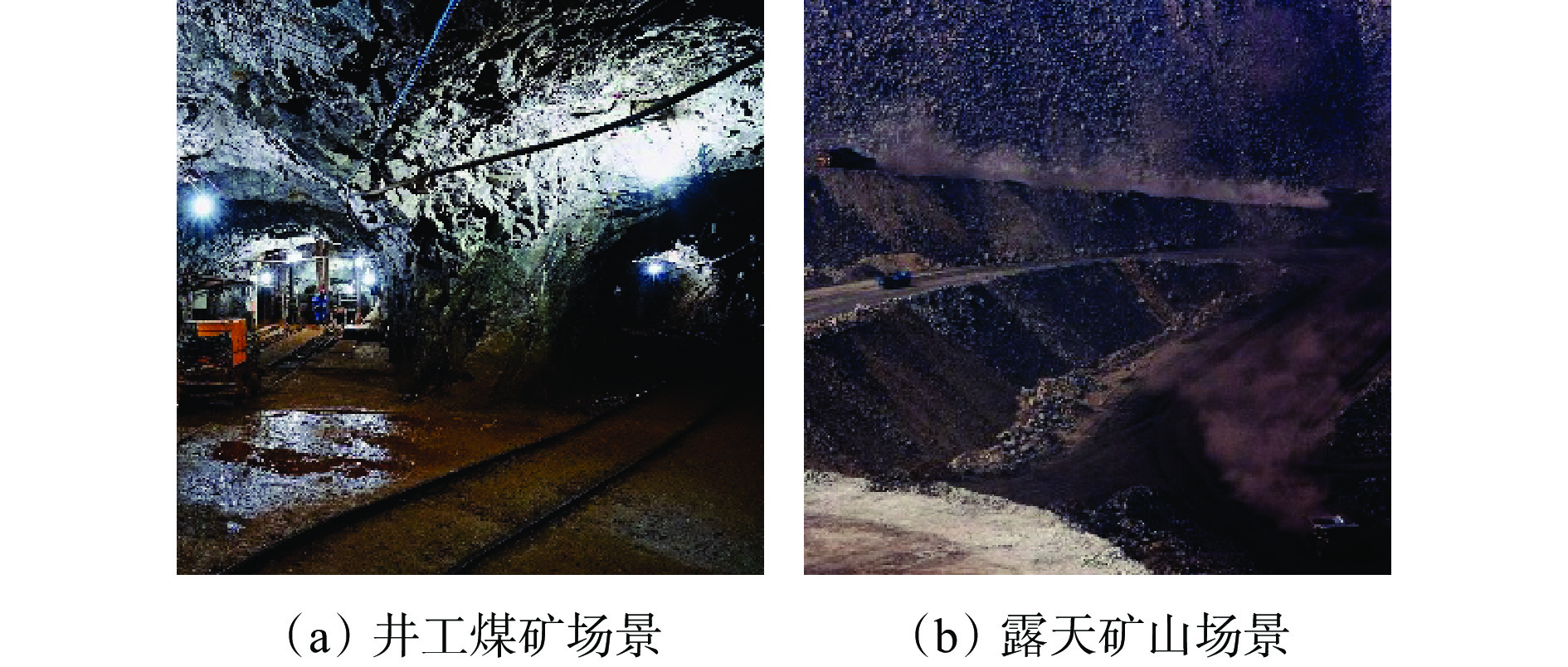

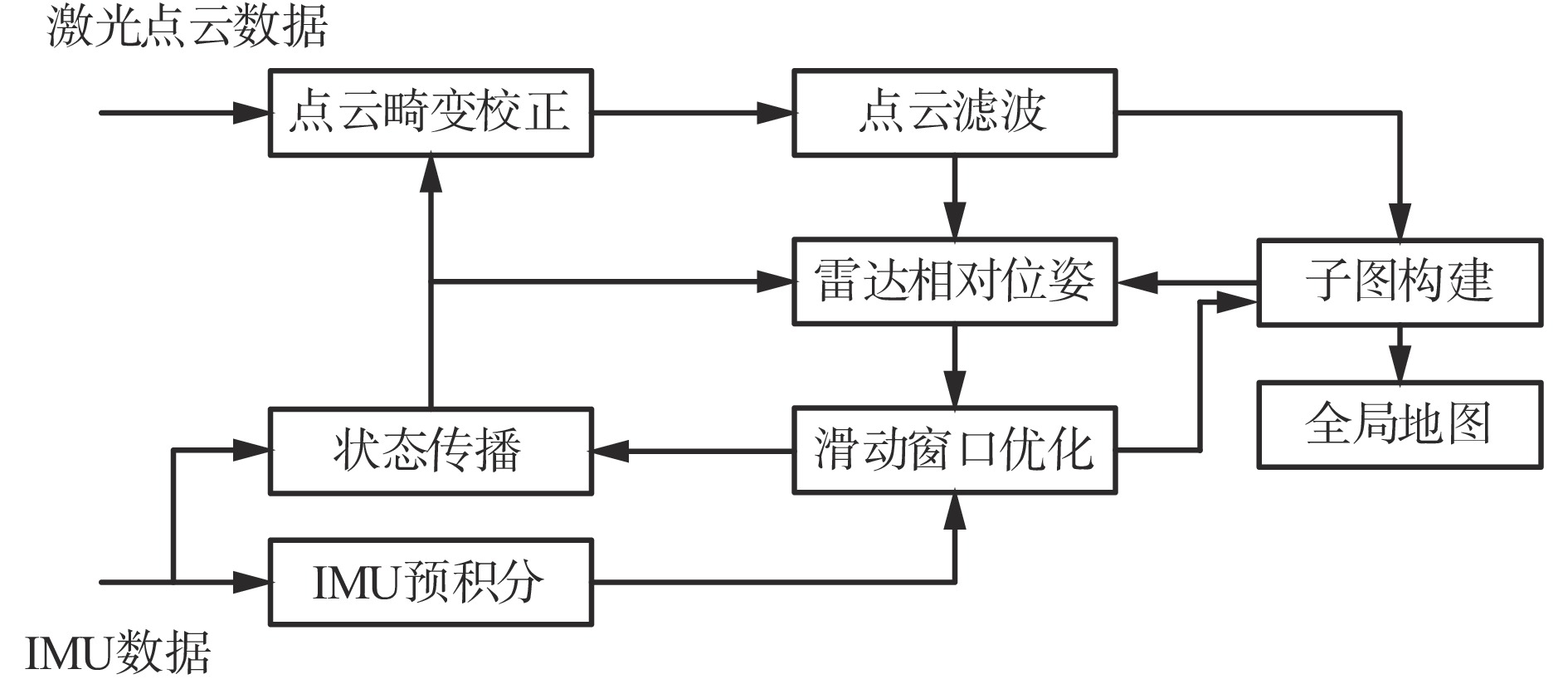

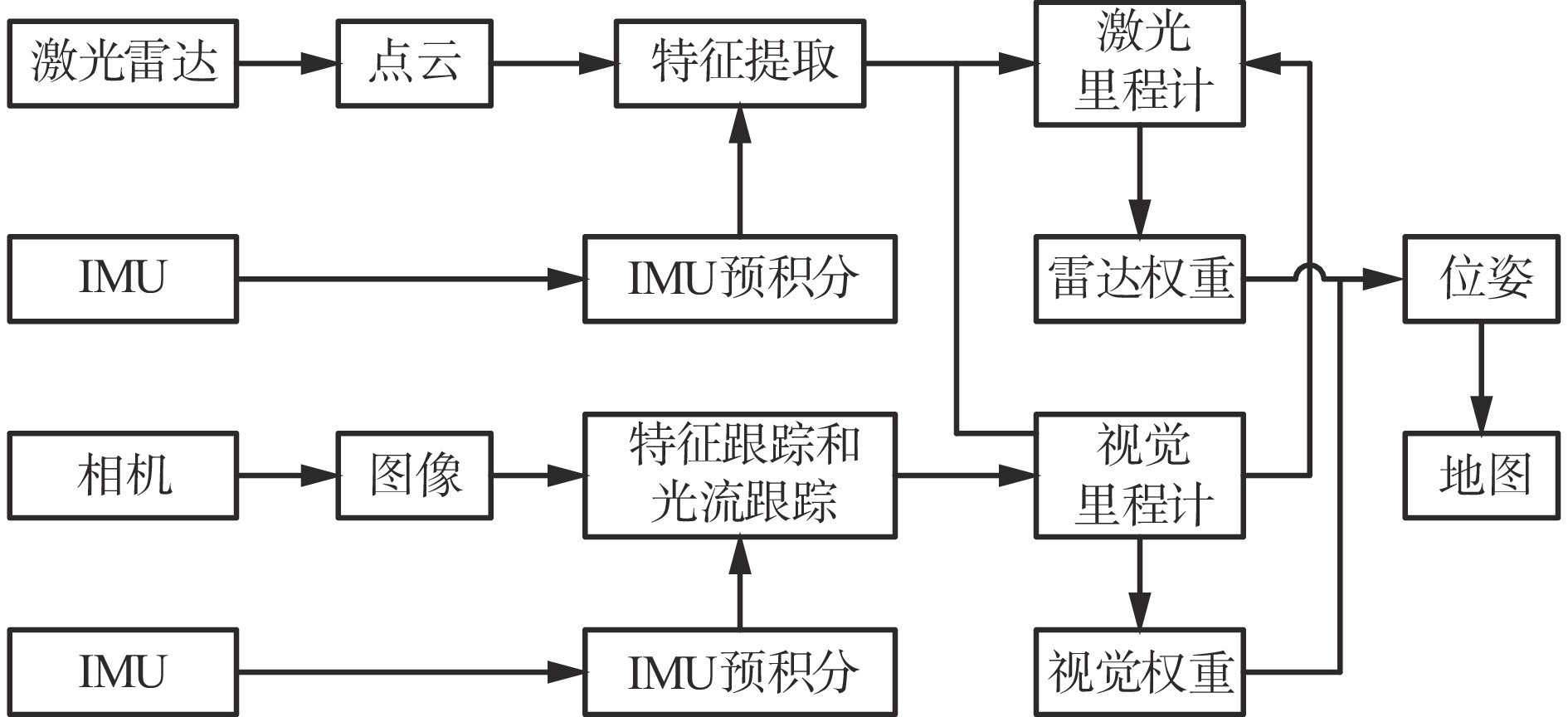

摘要: 无人驾驶是矿山智能化关键技术之一,其中即时定位与地图构建(SLAM)技术是实现无人驾驶的关键环节。为推动SLAM技术在矿山无人驾驶领域的发展,对SLAM技术原理、成熟地面SLAM方案、现阶段矿山SLAM研究现状、未来矿山SLAM发展趋势进行了探讨。根据SLAM技术所使用的传感器,从视觉、激光及多传感器融合3个方面分析了各自的技术原理及相应框架,指出视觉和激光SLAM技术通过单一相机或激光雷达实现,存在易受环境干扰、无法适应复杂环境等缺点,多传感器融合SLAM是目前最佳的解决方法。探究了目前矿山SLAM技术的研究现状,分析了视觉、激光、多传感器融合3种SLAM技术在井工煤矿、露天矿山的适用性与研究价值,指出多传感器融合SLAM是井工煤矿领域的最佳方案,SLAM技术在露天矿山领域研究价值不高。基于现阶段井下SLAM技术存在的难点(随时间及活动范围积累误差、各类场景引起的不良影响、各类传感器无法满足高精度SLAM算法的硬件要求),提出矿山无人驾驶领域SLAM技术未来应向多传感器融合、固态化、智能化方向发展。Abstract: Autonomous driving is identified as one of the key technologies for mining intelligence, with simultaneous localization and mapping (SLAM) technology serving as a key link to realize autonomous driving. To advance the development of SLAM technology in autonomous mining, this paper discusses the principles of SLAM technology, mature ground SLAM solutions, the current research status of mining SLAM, and future development trends. Based on the sensors employed in SLAM technology, the study analyzes the technical principles and corresponding frameworks from three aspects: vision, laser, and multi-sensor fusion. It is noted that visual and laser SLAM technologies, which utilize single cameras or LiDAR, are susceptible to environmental interference and cannot adapt to complex environments. Multi-sensor fusion SLAM emerges as the most effective solution. The research examines the status of mining SLAM technology, analyzing the applicability and research value of visual, laser, and multi-sensor fusion SLAM technologies in underground coal mines and open-pit mines. It concludes that multi-sensor fusion SLAM represents the optimal research approach for underground coal mines, while the research value of SLAM technology in open-pit mines is limited. Based on the challenges identified in underground SLAM technology, such as accumulated errors over time and activity range, adverse effects from various scenes, and the inadequacy of various sensors to meet the hardware requirements for high-precision SLAM algorithms, it is proposed that future developments in SLAM technology for autonomous mining should focus on multi-sensor fusion, solid-state solutions, and intelligent development.

-

0. 引言

煤矿巷道的形变和破坏是煤矿生产实践中需要着重考虑解决的问题。煤矿巷道形变是指巷道岩层在受到外力因素作用下产生的形状和尺寸的变化,巷道形变会造成井下交通中断、生产设备损坏、人员伤亡等事故,严重威胁煤矿正常生产。因此,在煤矿开采过程中,及时、科学、准确地监测巷道形变,掌握巷道状态及形变趋势,对保障煤矿安全生产具有十分重要的意义[1]。

随着计算机技术的快速发展,多种数值模拟技术被广泛应用于巷道形变的研究中,如有限元法、离散元法、边界元法、有限差分法、十字观测法等。王伟等[2]运用理论计算与数值模拟分析,分析了动压巷道的应力分布规律,为巷道的布设位置选取与支护提供了指导。姜耀东等[3]对开滦矿区赵各庄矿、唐山矿深部开采过程中巷道形变、破坏特征进行了研究,采用FLAC2D数值模拟软件研究地应力与巷道岩层之间的密切关系。余伟健等[4]利用离散裂隙网络在FLAC3D软件中对矿山现场调查得到的裂隙进行了重构还原,研究分析了裂隙发育岩体巷道及典型支护结构体的变形破坏特征。杨景贺[5]采用离散元数值模拟方法,建立了不同支护条件下的高应力软岩巷道模型,研究了高应力软岩巷道变形破坏和支护加固的机理。

目前,针对巷道形变破坏的研究以现场实测为主,通过实测可掌握巷道形变破坏情况,直观了解导致巷道形变破坏的因素及作用效果。叶美图等[6]针对现有矿井巷道表面位移十字交叉测量方法存在的测量不便、耗时长、工作强度大、误差不可控等问题,设计了一种矿井巷道表面位移激光测量装置。该装置基于激光测距原理,利用激光测距仪完成十字定心和变形测量,通过单个激光测距仪可分别测得巷道中每个测试站顶板、底板、左帮和右帮4个方向的表面位移量。井下试验结果表明,该装置实现了无绳测量,测量效率高,结果准确。宋康磊等[7]采用地质雷达测定巷道松动圈,研究了极薄煤层跨采条件下的松动圈大小及巷道形变规律。荣耀等[8]提出了综采工作面三维激光扫描建模总体方案,对煤壁与顶板交线提取、标靶球检测、点云拼接及坐标转换等关键技术进行了研究,实现了三维地质坐标系下煤壁与顶板交线信息的近实时获取,该信息可直接发送给采煤机滚筒,为采煤机下一刀截割提供数据参考。杜江丽等[9]提出了多边形分割法,将模型的重点关注区域划分为多个多边形,对矿区边坡形变监测数据进行研究。亓玉浩等[10]提出了一种综采工作面实时三维建图方法,可满足综采工作面监控的精度需求。刘晓阳等[11]针对岩性变化和构造的分析监测越来越困难的问题,研究了当前巷道顶板稳定性监测方法。王峰[12]提出了以煤层透明化、综采装备透明化、决策及控制透明化为核心的基于透明工作面的智能化开采概念。邹筱瑜等[13]面向移动机器人在煤矿巷道的建图需求,提出了一种基于集成式因子图优化的煤矿巷道移动机器人三维地图构建方法。高晓进等[14]提出了软岩巷道超前爆破预裂顶板防控技术,以解决软岩巷道结构的形变问题。

上述方法为巷道形变监测提供了可行的解决方案,但还存在如下问题:① 单一的形变量指标难以准确反映巷道形变演化规律及围岩状态与发展趋势。② 巷道形变具有区域性、连续性、突发性的特点,现有方法存在监测站点单一、测点有限的问题,难以实现大范围、多站点、区域性同步测量。因此需要选取多个指标建立巷道形变监测指标体系,且需要研究一种具有区域性、连续性、实时性特点的巷道形变监测方法,及时、准确、全面地监测巷道形变以确保煤矿开采安全。

三维激光扫描技术可快速获取被测物体表面三维坐标,点云数据精度高、密度大,包含反射强度等信息[15],可实现对巷道形变连续监测。因此,针对煤矿巷道形变监测面临的问题,本文提出了一种基于三维激光扫描的煤矿巷道形变监测方法。首先,利用深度学习模型VoxelNet对三维激光扫描数据进行检测去噪。然后,利用alphashape算法对断面离散点进行拟合,并采用基于差值的方法,对数据进行多维差值计算,得到巷道形变的具体数据,实现矿区巷道形变监测的全覆盖。最后,利用中煤大同能源有限责任公司塔山煤矿为期1个月的实际监测数据,对巷道形变进行截面分析和三维整体分析。

1. 煤矿巷道形变监测方法

1.1 三维激光扫描技术

三维激光扫描技术是一种先进的全自动、高精度立体扫描技术,具有操作简单、速度快、灵活性高、精度高等特点[16],数字化、自动化、实时性强,解决了目前空间信息技术发展的瓶颈。

三维激光扫描技术借助水平方位偏转控制器及对应的高度角偏转控制器科学控制反射棱镜的实际转动,使激光测距系统发射的激光能够顺着不同的坐标轴实时移动并扫描测量。扫描仪自身定义的坐标系统中, X轴在横向扫描面内,Y轴在横向扫描面内与X轴垂直,Z轴与横向扫描面垂直。借助测得的三维扫描仪中心到目标点的斜距S、激光束水平方向偏转角a和竖直方向偏转角b来校准并计算激光脚点的实际三维坐标P(X,Y,Z)[17]。

$$ X = S \cos b \cos a $$ (1) $$ Y = S \cos b \sin a $$ (2) $$ Z = S \sin b $$ (3) 三维激光点坐标计算原理如图1所示,通过测量大量物体表面点位的三维坐标,读取并集成现场物体的反射率和纹理等信息,生成被测物点云模型,获取高精度、高分辨率的三维巷道点云数据。

1.2 点云去噪

对三维巷道点云数据去噪是煤矿巷道形变监测得以有效应用的重要预处理步骤[18]。将噪点设为巷道内的人物和内壁附着的螺丝钉和管道等,通过VoxelNet网络检测出噪点后,再对数据进行分离。

首先使用点云标注工具Semantic Segmentation Editor制造数据集,标注人物和管道等信息后送入VoxelNet训练。然后使用VoxelNet中的Voxel将三维空间中的一定空间划分为一个格子,并使用PointNet网络对格子的数据进行特征提取。最后用提取出来的特征代表这个格子,并放回到三维空间。将无序的点云数据变成高维特征数据,并使用三维卷积抽取有序的三维Voxel数据。

1.3 点云旋转

给定2个来自不同坐标系的三维数据点集,找到2个三维数据点集的空间变换关系,使2个三维数据点集处于同一坐标系中,即可实现三维点云配准[19]。配准目标是在全局坐标框架中找到单独获取视图的相对位置和方向,使2个三维数据点集之间的相交区域完全重叠。通过求点云M和点云N 之间的旋转矩阵和平移向量,使点云M和点云N的坐标处于同一坐标系下。通过欧拉角生成旋转矩阵,将点云数据进行平移和旋转。设新的空间直角坐标轴分别为X',Y',Z',绕X',Y',Z' 3个轴旋转的角度分别为α,β,γ,绕X',Y',Z'旋转分别得到的旋转矩阵为

$$ {{\boldsymbol{R}}_{X'}}\left( \alpha \right) = \left[ \begin{gathered} 1\quad \quad 0\quad \quad 0 \\ 0\quad \cos \alpha \quad - \sin \alpha \\ 0\quad \sin \alpha \quad \cos \alpha \\ \end{gathered} \right] $$ (4) $$ {{\boldsymbol{R}}_{Y'}}\left( \beta \right) = \left[ \begin{gathered} \cos \beta \quad \;0\quad \sin \beta \\ \quad 0\quad \quad 1\quad \;\;0 \\ - \sin \beta \;\;\;0\quad \cos \beta \\ \end{gathered} \right] $$ (5) $$ {{\boldsymbol{R}}_{Z'}}\left( \gamma \right) = \left[ \begin{gathered} \cos \gamma \quad - \sin \gamma \;\;\;0 \\ \sin \gamma \quad \;\cos \gamma \quad \;0 \\ 0\;\;\;\;\;\;\;\;\;\;\;\;0\quad \,\,\cos \gamma \\ \end{gathered} \right] $$ (6) 对3个旋转矩阵的点云坐标进行逐元素相乘,得到最终的旋转矩阵R。

$$ {\boldsymbol{R}} = {{\boldsymbol{R}}_{Z'}}\left( \gamma \right) {{\boldsymbol{R}}_{Y'}}\left( \beta \right) {{\boldsymbol{R}}_{X'}}\left( \alpha \right) $$ (7) 1.4 点云连续断面

将巷道切分为连续的断面,根据断面对巷道进行形变分析,分别向点云的X'OY'和Y'OZ'面进行数据投影,计算当前断面的中心点$ {P^*} \left( {{x^ * },{y^ * },{{\textit{z}}^ * }} \right) $,其中,$ {x^ * },{y^ * },{{\textit{z}}^ * } $为中心点$ {P^*} $在X',Y',Z' 3个坐标轴上对应的数值。

随后,构造与Z'轴平行的平面,平面与Z'轴平行且与Y'轴相切,则该平面的法向量u=[0 1 0],该平面的方程为$ y - {y^ * } = 0 $。由于落于平面的点比较稀疏,所以赋予平面一定的厚度,将点到平面一定距离d内的点都算作该平面的点。

1.5 形变分析

在实际扫描作业中,由于障碍物遮挡或受巷道空间扫描角度的限制,会出现部分点云空洞,难以保证断面上处处都有激光斑点,所以需要对投影后的断面离散点集进行拟合。alphashape算法可控制点集边界拟合以创建非凸区域,采用该算法拟合投影后的断面离散点集,其计算圆心的原理如图2所示,计算步骤如下:

1) 选取任意一点$ p \left( {x,y} \right) $,以半径为r的圆进行滚动,在断面点集中搜索所有距离$ p $点2r以内的点的集合,形成点集Q。

2) 选取点集Q中的任意点$ {p_1} \left( {{x_1},{y_1}} \right) $,根据$ p $和$ {p_1} $2个点的坐标和半径r,计算出经过$ p $和$ {p_1} $2个点且半径为r的圆心${p_2} \left( {{x_2},{y_2}} \right) $,${p_3} \left( {{x_3},{y_3}} \right) $。

$$ \left\{ \begin{array}{l} {x_2} = x + 1/2({x_1} - x) - H ({y_1} - y) \\ {y_2} = y + 1/2({y_1} - y) - H (x - {x_1}) \\ {x_3} = x + 1/2({x_1} - x) + H ({y_1} - y) \\ {y_3} = y + 1/2({y_1} - y) + H (x - {x_1}) \\ \end{array} \right. $$ (8) 式中H为参数。

3) 计算点集Q中(除$ {p_1} $点)剩余点分别到$ {p_2},{p_3} $点的距离。若所有点到$ {p_2} $或$ {p_3} $的距离均大于半径r,则证明$ p $点为边界点。

4) 若剩余的点到$ {p_2} $或$ {p_3} $点的距离不全都大于半径r,则遍历点集Q内的所有点,将其轮换作为$ {p_1} $点,重复上述过程。若存在某点满足2)和3),则该点为边界点,终止该点的判断,继续判断下一点。若点集Q中所有临近点中均不存在$ {p_1} $这样的点,则$ p $点为非边界点。

根据alphashape算法拟合巷道断面轮廓图,构建不同监测时期同一位置的巷道断面,将其叠加后,采用对比不同时期同一位置巷道断面的高度和宽度等信息的方法,可以更直观地分析巷道形变趋势。具体分析过程:首先,由alphashapes算法计算第一期巷道断面的轮廓点,分别计算相邻2个点$p'\left( {{x_0},{y_0},{{\textit{z}}_0}} \right), q\left( {{x_1},{y_1},{{\textit{z}}_1}} \right)$所构成的线段$ {l_1} $的方向向量,默认$p',q$处于同一平面内,故只保留X轴和Z轴值,记为$p'\left( {{x_0},{{\textit{z}}_0}} \right), q\left( {{x_1},{{\textit{z}}_1}} \right)$。然后,计算过$p '$点与$ {l_1} $垂直的直线$ {l_2} $,$ {l_2} $即法向直线。最后,计算第二期与第一期相同法向直线的点的坐标,计算2个点间的距离,将其记为形变值。

2. 工程实践

2.1 工程概况

中煤大同能源有限责任公司塔山煤矿的开采工作面为30507工作面,工作面采用单巷布置方式,即在工作面分别布置胶带巷和回风巷。工作面西侧布置回风巷,东侧布置胶带巷,胶带巷东侧为实煤区,回风巷西侧为30509工作面采空区(2018年6月停采),30507工作面与30509工作面之间区段煤柱为8 m,因此将30507工作面回风巷作为监测地点,进行为期1个月的实际形变监测。

通过对30507工作面进行实地勘查,其具有以下特点:

1) 靠近工作面的回风巷区域形变量大,已有控制点坐标经过一定时间会发生变化,无法直接利用。

2) 对于井下空间地理坐标系,除用全站仪进行测点定位外,没有更好的方式将点云数据和矿井坐标系进行联系。

3) 矿区井下环境相对复杂,煤尘、空气湿度、振动等工况极易影响工作效率和数据精度。

2.2 实践方案

塔山煤矿正在回采的工作面为30507工作面,开始监测时采煤机所处位置在里程1 000 m处,监测范围为里程600~900 m。在测绘区域起始位置即里程600 m处,前后上下交错架设多个360°棱镜。根据30507回风巷实际情况,考虑到工作面附近棱镜位置会产生变化,因此以风门处于终采线以内的基准点为基准,测量各个360°棱镜的三维坐标,使棱镜与井下基准点处于同一坐标系下。采用后方交会的方式,在每次进行巷道形变监测数据采集时,以相同基准点作为初始测点的定向点,将矿井坐标系赋予点云数据,以保证每次进行形变监测工作所采集的点云数据都处于同一个空间坐标系下。

受巷道结构影响,只能选取接近于直线的布站路线进行三维激光扫描。为避免由于线性布站及井下煤尘、湿气等因素造成的拼接误差,相邻测站之间采用棱镜定位的方式进行拼接定位,选择应用可识别棱镜并记录棱镜信息的三维激光扫描仪。相邻测站间需保证有2个及以上共同的棱镜作为拼接基准。

将周期性采集的点云数据置于同一坐标系下,对多次的点云数据进行对比,得出巷道顶底板和煤柱侧、回采侧两侧壁的形变量。

2.3 数据采集

1) 控制测量。由于三维激光扫描仪具有独立的坐标系统,为了将点云数据坐标系转换为实际地理坐标系,需结合全站仪进行控制测量。在里程600 m处做3个能够固定在锚杆上的棱镜放置装置,并在其上安置3个360°棱镜。以风门处7号、9号、11号基准点为基准,采用全站仪测出3个棱镜在矿区地测坐标系中的坐标。

2) 在里程600~900 m段,按30 m的间距,在巷道两帮粉刷并做标记,作为扫描的架站位置;在里程600 m处开始架设三维激光扫描仪,并进行对中整平等操作。

3) 定位棱镜测量。扫描仪架设完毕后,使用棱镜扫描功能采集设置的360°棱镜点位数据,将定位棱镜信息同步至点云模型中。

4) 根据项目要求选择合适的扫描参数,建立测站文件夹,使用棱镜的扫描功能,识别测站间用于点云拼接所架设的棱镜,识别完成后开始三维激光扫描,获取该测站全景点云数据。

5) 检查数据质量,若数据质量合格,即可将扫描仪迁移至下一预设测站,并以同样步骤进行该测站的三维激光扫描。依次循环,直至待测区域全部扫描完成,即数据采集工作完成。

2.4 数据处理

数据处理过程只需将相邻测站间相同的棱镜目标进行匹配,即可达到点云拼接目的,过程如下:

1) 控制点坐标录入。在数据处理软件中,使用起始测站中采集的定位棱镜点创建目标,将全站仪测量的定位棱镜坐标赋予对应目标,控制点坐标录入,如图3所示。

2) 后方交会拼接。起始测站点云利用其中的定位棱镜点与已赋予现场坐标系坐标的目标点位匹配。第二测站点云以起始测站为基准,利用与起始测站共视的2个或2个以上棱镜进行后方交会,将其与起始测站拼接[20]。后续测站依次进行,得到定位于现场坐标系中的整体测区点云模型。

3) 数据去噪。为采集完整的巷道顶板、底板及煤柱侧、回采侧两侧壁数据,采用360°全景扫描仪采集现场所有可视数据。由于噪点数据[21](图4)会对实施效率及结果精度造成影响,所以需对噪点数据进行去噪,去噪后数据如图5所示。

4) 数据输出。对数据进行拼接、去噪后,在确保点云定位信息固定的前提下,导出相应格式的点云模型,如图6和图7所示。

2.5 数据分析

在数据处理过程中,将所有三维点云模型置于同一坐标系下,因此在将同一测区的2期三维点云数据导入对比分析软件后,2期三维点云模型会自动放置在同一位置。

1) 三维整体分析。将置于同一位置的2期点云数据沿其法线方向进行差值分析,得到整体形变量,以色谱的形式将差值进行显示,不同颜色的分布表示不同区域2期点云模型偏差的分布,颜色的深浅表示该区域偏差大小。通过对模型上颜色的分布和深浅分析,得到该测段巷道形变的整体趋势,如图8所示。如果巷道受到向内的挤压,会变成红色,红色越深,表明挤压程度越大;如果巷道趋近于无变化,则会变成绿色;如果巷道向外扩张,会变成蓝色,蓝色越深,表明向外扩张程度越大。

2) 截面分析。以三维整体分析为基础,在整体巷道点云模型的竖直方向上按一定距离布置截面,截取2期点云在截面上的偏差,以色谱的形式将差值进行显示,截面分析结果如图9所示。可看出离工作面距离越近,附色模型的颜色越偏向红色和蓝色,且颜色越深,代表巷道形变越大。

两期巷道截面对比如图10所示,通过2个巷道轮廓的相对偏差,可看出该区域主要存在的形变:如果上轮廓向内偏离,则顶板发生塌陷;如果下轮廓向外偏离,则底板发生鼓起。

3) 预警记录。点选预警记录可查看预警位置、里程位置和最大形变值等信息,数据精确,可随时观察巷道形变情况,以便采取相应维护措施,巷道形变预警记录如图11所示。

3. 结论

1) 将三维激光扫描技术应用于塔山煤矿30507工作面的形变监测,将人工智能与传统方法相结合,提出了基于三维激光扫描的煤矿巷道形变监测方法。利用深度学习VoxelNet模型对点云数据进行去噪,利用alphashape算法对断面离散点进行拟合,并采用基于差值的方法,将数据进行多维差值计算以得到巷道形变数据。

2) 利用塔山煤矿的实际监测数据,对巷道三维点云数据进行了截面分析和三维整体分析。截面分析主要基于巷道三维点云按固定间距选取截面,比对2期点云截面数据,通过截面轮廓差异判断巷道形变情况;三维整体分析利用2期巷道三维点云数据进行整体比对,通过色谱显示比对结果,分析巷道形变区域和变化趋势。随着测点距工作面的距离越近,附色模型越偏向红色和蓝色,且颜色越深,表明巷道形变越大。

-

表 1 上文未提及的常见多传感器融合SLAM方案

Table 1 Common multi-sensor fusion SLAM solutions

多传感器融合SLAM方案 所属类型 优点 缺点 激光−惯性里程计与地图构建[31] 激光雷达−IMU 率先开源的激光雷达与IMU融合方案 计算效率不高 激光−惯性状态估计器[32] 激光雷达−IMU 相较LIO−mapping运行速度提高近1个数量级 复杂程度高 快速激光−惯性里程计系列[33-35] 激光雷达−IMU 轻量级定位建图,运行效率高;Faster−LIO

可应用至固态激光雷达牺牲了一定精度;更适合小尺度场景 固态激光雷达−惯性里程计与地图构建[36] 激光雷达−IMU 适用于固态激光雷达的融合方案 狭窄长廊特征匹配退化严重 激光−惯性里程计与地图构建[37] 激光雷达−IMU 可消除动态物体影响;低漂移;强鲁棒性 实时性较差 基于关键帧的视觉−惯性SLAM系统[38] 相机−IMU 轨迹估计精确 无回环检测;无法构建环境地图 基于方向加速分割测试特征检测子和

旋转二进制鲁棒独立特征描述子的

视觉−惯性SLAM系统[39]相机−IMU 通过融合IMU数据解决快速运动下

特征点丢失的问题无法长时间应用至光照变化明显、

欠特征场景基于方向加速分割测试特征检测子和

旋转二进制鲁棒独立特征描述子的

即时定位与地图构建[40]相机−IMU 定位精度、实时性好 快速运动场景存在特征丢失问题;

大尺度场景计算消耗量大视觉−激光里程计与地图构建[41] 激光雷达−相机−IMU 精度高;鲁棒性好 无“回环检测” 激光−单目视觉里程计[42] 激光雷达−相机−IMU 环境信息丰富,便于后续语义分割等操作 精度低于V−LOAM 稳健实时的激光−惯性−视觉联合估计[43-45] 激光雷达−相机−IMU 实时性强;可拓展性优秀 计算资源需求大 快速激光−惯性−视觉里程计[46] 激光雷达−相机−IMU 计算效率高;鲁棒性好 硬件要求高 -

[1] 鲍久圣,刘琴,葛世荣,等. 矿山运输装备智能化技术研究现状及发展趋势[J]. 智能矿山,2020,1(1):78-88. BAO Jiusheng,LIU Qin,GE Shirong,et al. Research status and development trend of intelligent technologies for mine transportation equipment[J]. Journal of Intelligent Mine,2020,1(1):78-88.

[2] 鲍久圣,张牧野,葛世荣,等. 基于改进A*和人工势场算法的无轨胶轮车井下无人驾驶路径规划[J]. 煤炭学报,2022,47(3):1347-1360. BAO Jiusheng,ZHANG Muye,GE Shirong,et al. Underground driverless path planning of trackless rubber tyred vehicle based on improved A* and artificial potential field algorithm[J]. Journal of China Coal Society,2022,47(3):1347-1360.

[3] SMITH R C,CHEESEMAN P. On the representation and estimation of spatial uncertainty[J]. The International Journal of Robotics Research,1986,5(4):56-68. DOI: 10.1177/027836498600500404

[4] 刘铭哲,徐光辉,唐堂,等. 激光雷达SLAM算法综述[J]. 计算 机工程与应用,2024,60(1):1-14. DOI: 10.54254/2755-2721/60/20240821 LIU Mingzhe,XU Guanghui,TANG Tang,et al. Review of SLAM based on lidar[J]. Computer Engineering and Applications,2024,60(1):1-14. DOI: 10.54254/2755-2721/60/20240821

[5] HUANG Leyao. Review on LiDAR-based SLAM techniques[C]. International Conference on Signal Processing and Machine Learning,Stanford,2021:163-168.

[6] 李云天,穆荣军,单永志. 无人系统视觉SLAM技术发展现状简析[J]. 控制与决策,2021,36(3):513-522. LI Yuntian,MU Rongjun,SHAN Yongzhi. A survey of visual SLAM in unmanned systems[J]. Control and Decision,2021,36(3):513-522.

[7] DAVISON A J,REID I D,MOLTON N D,et al. MonoSLAM:real-time single camera SLAM[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2007,29(6):1052-1067. DOI: 10.1109/TPAMI.2007.1049

[8] KLEIN G,MURRAY D. Parallel tracking and mapping for small AR workspaces[C]. 6th IEEE and ACM International Symposium on Mixed and Augmented Reality,Nara,2007:225-234.

[9] MUR-ARTAL R,MONTIEL J M M,TARDOS J D. ORB-SLAM:a versatile and accurate monocular SLAM system[J]. IEEE Transactions on Robotics,2015,31(5):1147-1163. DOI: 10.1109/TRO.2015.2463671

[10] MUR-ARTAL R,TARDOS J D. ORB-SLAM2:an open-source SLAM system for monocular,stereo,and RGB-D cameras[J]. IEEE Transactions on Robotics,2017,33(5):1255-1262. DOI: 10.1109/TRO.2017.2705103

[11] NEWCOMBE R A,LOVEGROVE S J,DAVISON A J. DTAM:dense tracking and mapping in real-time[C]. International Conference on Computer Vision,Barcelona,2011:2320-2327.

[12] 张继贤,刘飞. 视觉SLAM环境感知技术现状与智能化测绘应用展望[J]. 测绘学报,2023,52(10):1617-1630. ZHANG Jixian,LIU Fei. Review of visual SLAM environment perception technology and intelligent surveying and mapping application[J]. Acta Geodaetica et Cartographica Sinica,2023,52(10):1617-1630.

[13] ENGEL J,STUCKLER J,CREMERS D. Large-scale direct SLAM with stereo cameras[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Hamburg,2015:1935-1942.

[14] TATENO K,TOMBARI F,LAINA I,et al. CNN-SLAM:real-time dense monocular SLAM with learned depth prediction[C]. IEEE Conference on Computer Vision and Pattern Recognition,Honolulu,2017:6243-6252.

[15] 尹鋆泰. 动态场景下基于深度学习的视觉SLAM技术研究[D]. 北京:北京邮电大学,2023. YIN Juntai. Research on visual SLAM technology based on deep learning in dynamic scene[D]. Beijing:Beijing University of Posts and Telecommunications,2023.

[16] MONTEMERLO M,THRUN S,KOLLER D,et al. FastSLAM:a factored solution to the simultaneous localization and mapping problem[J]. American Association for Artificial Intelligence,2002. DOI: 10.1007/s00244-005-7058-x.

[17] HESS W,KOHLER D,RAPP H,et al. Real-time loop closure in 2D LIDAR SLAM[C]. IEEE International Conference on Robotics and Automation,Stockholm,2016:1271-1278.

[18] ZHANG Ji,SINGH S. LOAM:lidar odometry and mapping in real-time[J]. Robotics:Science and Systems,2014. DOI: 10.15607/RSS.2014.X.007.

[19] SHAN Tixiao,ENGLOT B. LeGO-LOAM:lightweight and ground-optimized lidar odometry and mapping on variable terrain[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Madrid,2018:4758-4765.

[20] LIN Jiarong,ZHANG Fu. Loam livox:a fast,robust,high-precision LiDAR odometry and mapping package for LiDARs of small FoV[C]. IEEE International Conference on Robotics and Automation,Paris,2020:3126-3131.

[21] LI Lin,KONG Xin,ZHAO Xiangrui,et al. SA-LOAM:semantic-aided LiDAR SLAM with loop closure[C]. IEEE International Conference on Robotics and Automation,Xi'an,2021:7627-7634.

[22] CHEN X,MILIOTO A,PALAZZOLO E,et al. SuMa++:efficient LiDAR-based semantic SLAM[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Macau,2019:4530-4537.

[23] WANG Guangming,WU Xinrui,JIANG Shuyang,et al. Efficient 3D deep LiDAR odometry[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2023,45(5):5749-5765.

[24] QIN Tong,LI Peiliang,SHEN Shaojie. VINS-mono:a robust and versatile monocular visual-inertial state estimator[J]. IEEE Transactions on Robotics,2018,34(4):1004-1020. DOI: 10.1109/TRO.2018.2853729

[25] LI Peiliang,QIN Tong,HU Botao,et al. Monocular visual-inertial state estimation for mobile augmented reality[C]. International Symposium on Mixed and Augmented Reality,Nantes,2017:11-21.

[26] QIN Tong,PAN Jie,GAO Shaozu,et al. A general optimization-based framework for local odometry estimation with multiple sensors[EB/OL]. (2019-01-11)[2024-06-22]. https://arxiv.org/abs/1901.03638.

[27] SHAN Tixiao,ENGLOT B,MEYERS D,et al. LIO-SAM:tightly-coupled lidar inertial odometry via smoothing and mapping[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Las Vegas,2020:5135-5142.

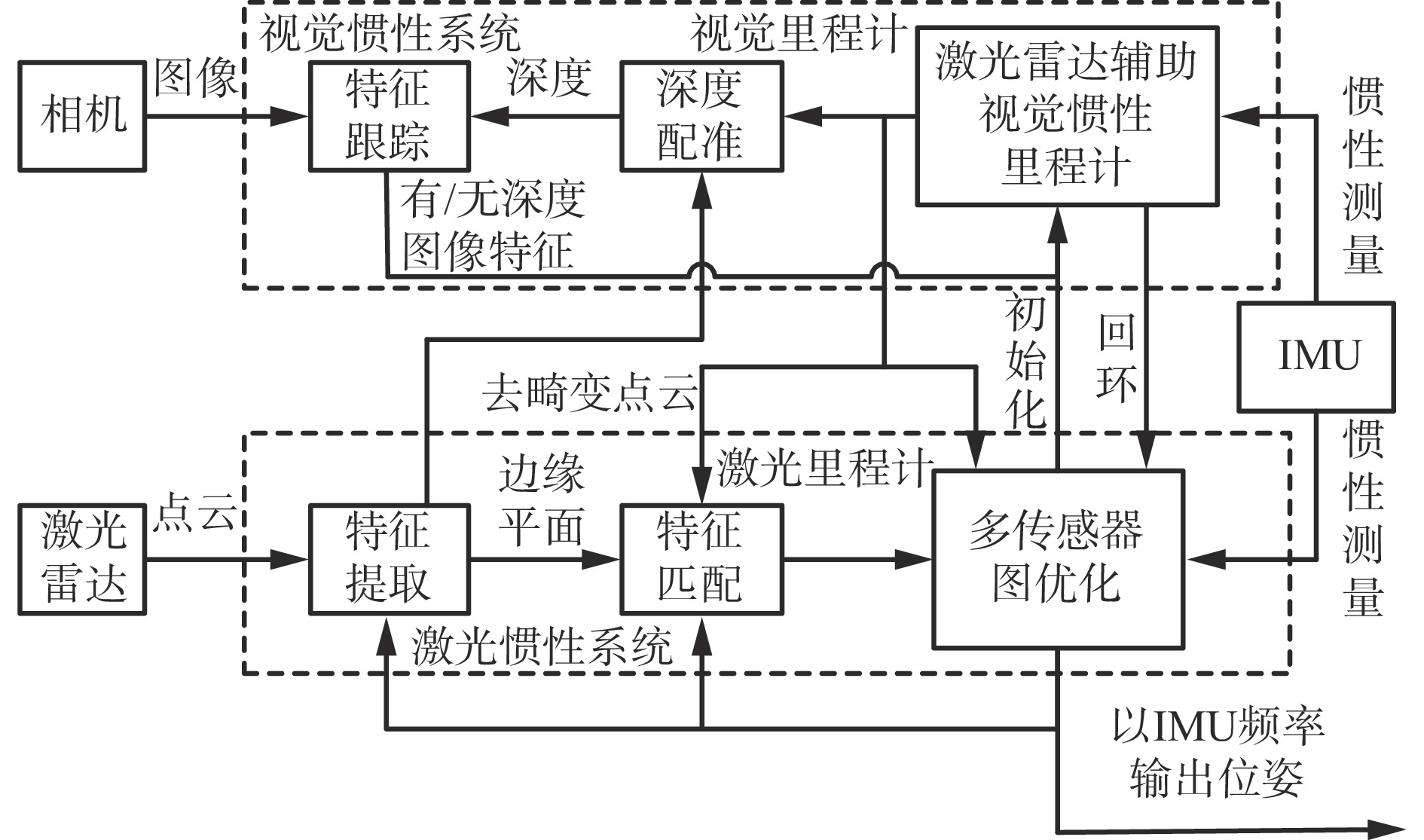

[28] SHAN Tixiao,ENGLOT B,RATTI C,et al. LVI-SAM:tightly-coupled lidar-visual-inertial odometry via smoothing and mapping[C]. IEEE International Conference on Robotics and Automation,Xi'an,2021:5692-5698.

[29] 祝晓轩. 基于单目相机与IMU融合的SLAM系统研究[D]. 青岛:青岛大学,2023. ZHU Xiaoxuan. Research on SLAM system based on monocular camera and IMU fusion[D]. Qingdao:Qingdao University,2023.

[30] 秦晓辉,周洪,廖毅霏,等. 动态环境下基于时序滑动窗口的鲁棒激光SLAM系统[J]. 湖南大学学报(自然科学版),2023,50(12):49-58. QIN Xiaohui,ZHOU Hong,LIAO Yifei,et al. Robust laser SLAM system based on temporal sliding window in dynamic scenes[J]. Journal of Hunan University(Natural Sciences),2023,50(12):49-58.

[31] YE Haoyang,CHEN Yuying,LIU Ming. Tightly coupled 3D lidar inertial odometry and mapping[C]. International Conference on Robotics and Automation,Montreal,2019:3144-3150.

[32] QIN Chao,YE Haoyang,PRANATA C E,et al. LINS:a lidar-inertial state estimator for robust and efficient navigation[C]. IEEE International Conference on Robotics and Automation,Paris,2020:8899-8906.

[33] XU Wei,ZHANG Fu. FAST-LIO:a fast,robust LiDAR-inertial odometry package by tightly-coupled iterated Kalman filter[J]. IEEE Robotics and Automation Letters,2021,6(2):3317-3324. DOI: 10.1109/LRA.2021.3064227

[34] XU Wei,CAI Yixi,HE Dongjiao,et al. FAST-LIO2:fast direct LiDAR-inertial odometry[J]. IEEE Transactions on Robotics,2022,38(4):2053-2073. DOI: 10.1109/TRO.2022.3141876

[35] BAI Chunge,XIAO Tao,CHEN Yajie,et al. Faster-LIO:lightweight tightly coupled lidar-inertial odometry using parallel sparse incremental voxels[J]. IEEE Robotics and Automation Letters,2022,7(2):4861-4868. DOI: 10.1109/LRA.2022.3152830

[36] LI Kailai,LI Meng,HANEBECK U D. Towards high-performance solid-state-LiDAR-inertial odometry and mapping[J]. IEEE Robotics and Automation Letters,2021,6(3):5167-5174. DOI: 10.1109/LRA.2021.3070251

[37] ZHAO Shibo,FANG Zheng,LI Haolai,et al. A robust laser-inertial odometry and mapping method for large-scale highway environments[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Macau,2019:1285-1292.

[38] LEUTENEGGER S,LYNEN S,BOSSE M,et al. Keyframe-based visual–inertial odometry using nonlinear optimization[J]. The International Journal of Robotics Research,2015,34(3):314-334. DOI: 10.1177/0278364914554813

[39] MUR-ARTAL R,TARDOS J D. Visual-inertial monocular SLAM with map reuse[J]. IEEE Robotics and Automation Letters,2017,2(2):796-803. DOI: 10.1109/LRA.2017.2653359

[40] CAMPOS C,ELVIRA R,RODRIGUEZ J J G,et al. ORB-SLAM3:an accurate open-source library for visual,visual-inertial,and multimap SLAM[J]. IEEE Transactions on Robotics,2021,37(6):1874-1890. DOI: 10.1109/TRO.2021.3075644

[41] ZHANG Ji,SINGH S. Visual-lidar odometry and mapping:low-drift,robust,and fast[C]. IEEE International Conference on Robotics and Automation,Seattle,2015:2174-2181.

[42] GRAETER J,WILCZYNSKI A,LAUER M. LIMO:lidar-monocular visual odometry[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Madrid,2018:7872-7879.

[43] LIN Jiarong,ZHENG Chunran,XU Wei,et al. R(2)LIVE:a robust,real-time,LiDAR-inertial-visual tightly-coupled state estimator and mapping[J]. IEEE Robotics and Automation Letters,2021,6(4):7469-7476. DOI: 10.1109/LRA.2021.3095515

[44] LIN Jiarong,ZHANG Fu. R3LIVE++:a robust,real-time,RGB-colored,LiDAR-rnertial-visual tightly-coupled state estimation and mapping package[C]. International Conference on Robotics and Automation,Philadelphia,2022:10672-10678.

[45] LIN Jiarong,ZHANG Fu. R3LIVE++:a robust,real-time,radiance reconstruction package with a tightly-coupled LiDAR-inertial-visual state estimator[J]. IEEE transactions on pattern analysis and machine intelligence,2024. DOI: 10.1109/TPAMI.2024.3456473.

[46] HENG Chunran,ZHU Qingyan,XU Wei,et al. FAST-LIVO:fast and tightly-coupled sparse-direct LiDAR-inertial-visual odometry[C]. IEEE/RSJ International Conference on Intelligent Robots and Systems,Kyoto,2022:4003-4009.

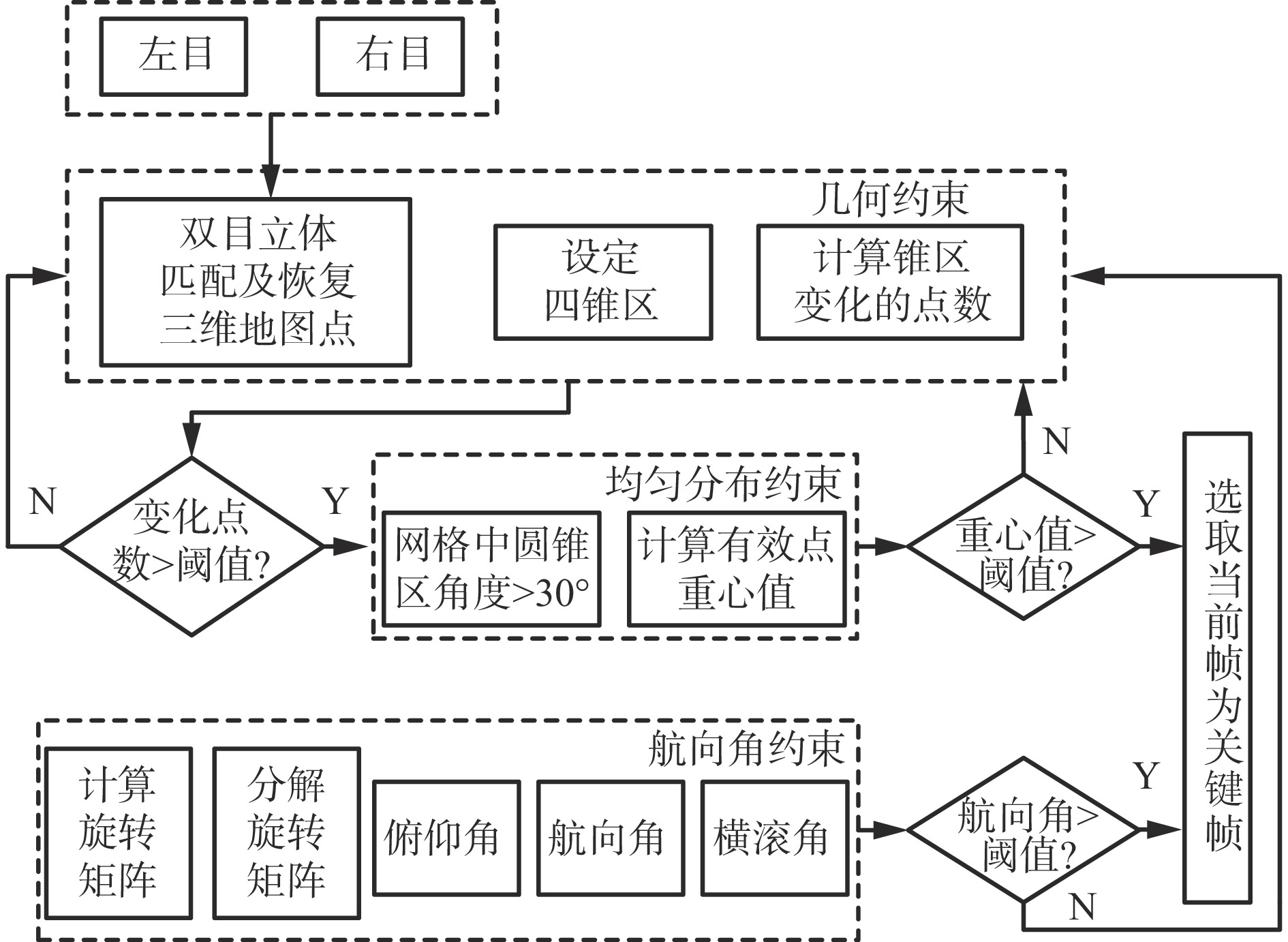

[47] 高毅楠,姚顽强,蔺小虎,等. 煤矿井下多重约束的视觉SLAM关键帧选取方法[J]. 煤炭学报,2024,49(增刊1):472-482. GAO Yinan,YAO Wanqiang,LIN Xiaohu,et al. Visual SLAM keyframe selection method with multiple constraints in underground coal mines[J]. Journal of China Coal Society,2024,49(S1):472-482.

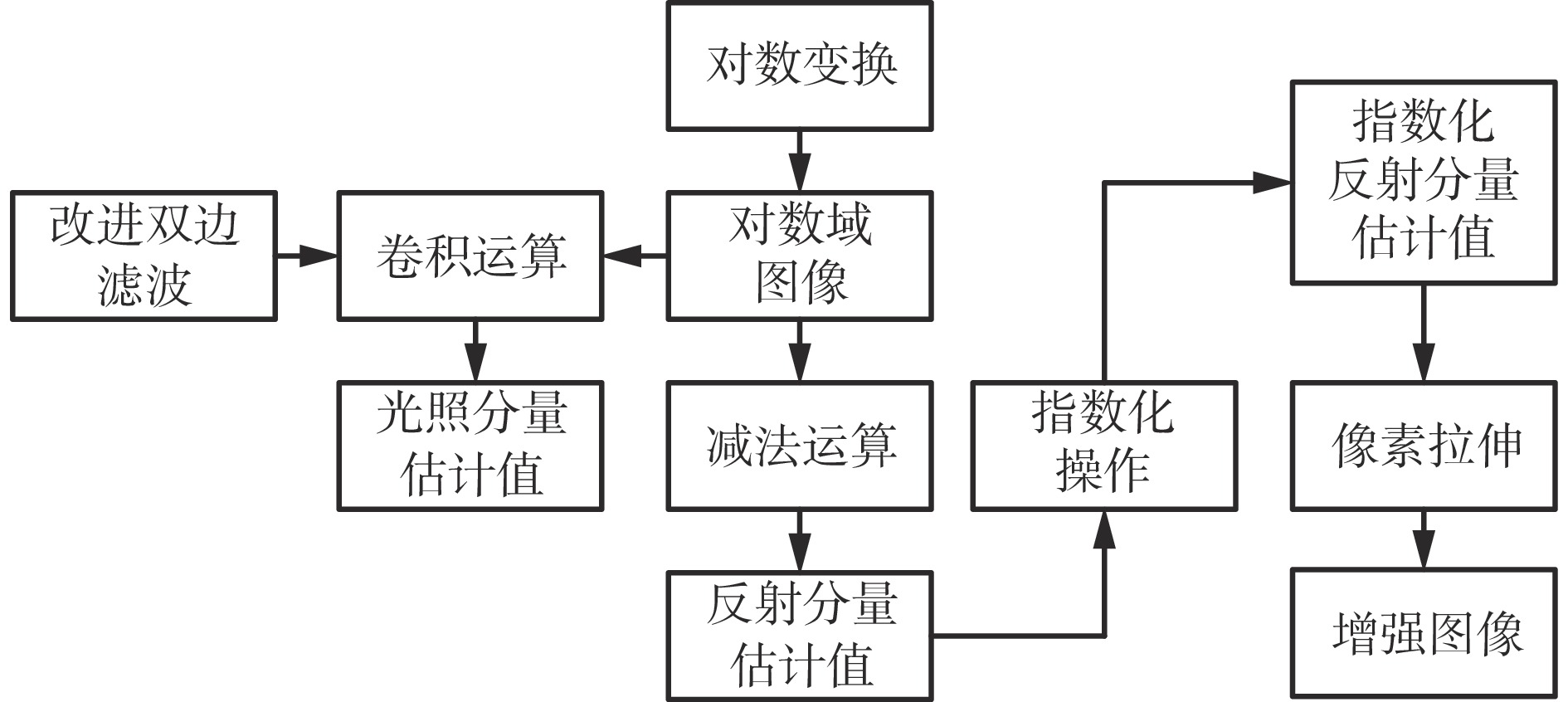

[48] 冯玮,姚顽强,蔺小虎,等. 顾及图像增强的煤矿井下视觉同时定位与建图算法[J]. 工矿自动化,2023,49(5):74-81. FENG Wei,YAO Wanqiang,LIN Xiaohu,et al. Visual simultaneous localization and mapping algorithm of coal mine underground considering image enhancement[J]. Journal of Mine Automation,2023,49(5):74-81.

[49] 马宏伟,王岩,杨林. 煤矿井下移动机器人深度视觉自主导航研究[J]. 煤炭学报,2020,45(6):2193-2206. MA Hongwei,WANG Yan,YANG Lin. Research on depth vision based mobile robot autonomous navigation in underground coal mine[J]. Journal of China Coal Society,2020,45(6):2193-2206.

[50] HUBER D F,VANDAPEL N. Automatic three-dimensional underground mine mapping[J]. The International Journal of Robotics Research,2006,25(1):7-17. DOI: 10.1177/0278364906061157

[51] 安震. 自主导航搜救机器人关键技术研究[D]. 沈阳:东北大学,2015. AN Zhen. Research on key technologies of autonomous navigation search and rescue robot[D]. Shenyang:Northeastern University,2015.

[52] LI Menggang,ZHU Hua,YOU Shaoze,et al. Efficient laser-based 3D SLAM for coal mine rescue robots[J]. IEEE Access,2019,7:14124-14138. DOI: 10.1109/ACCESS.2018.2889304

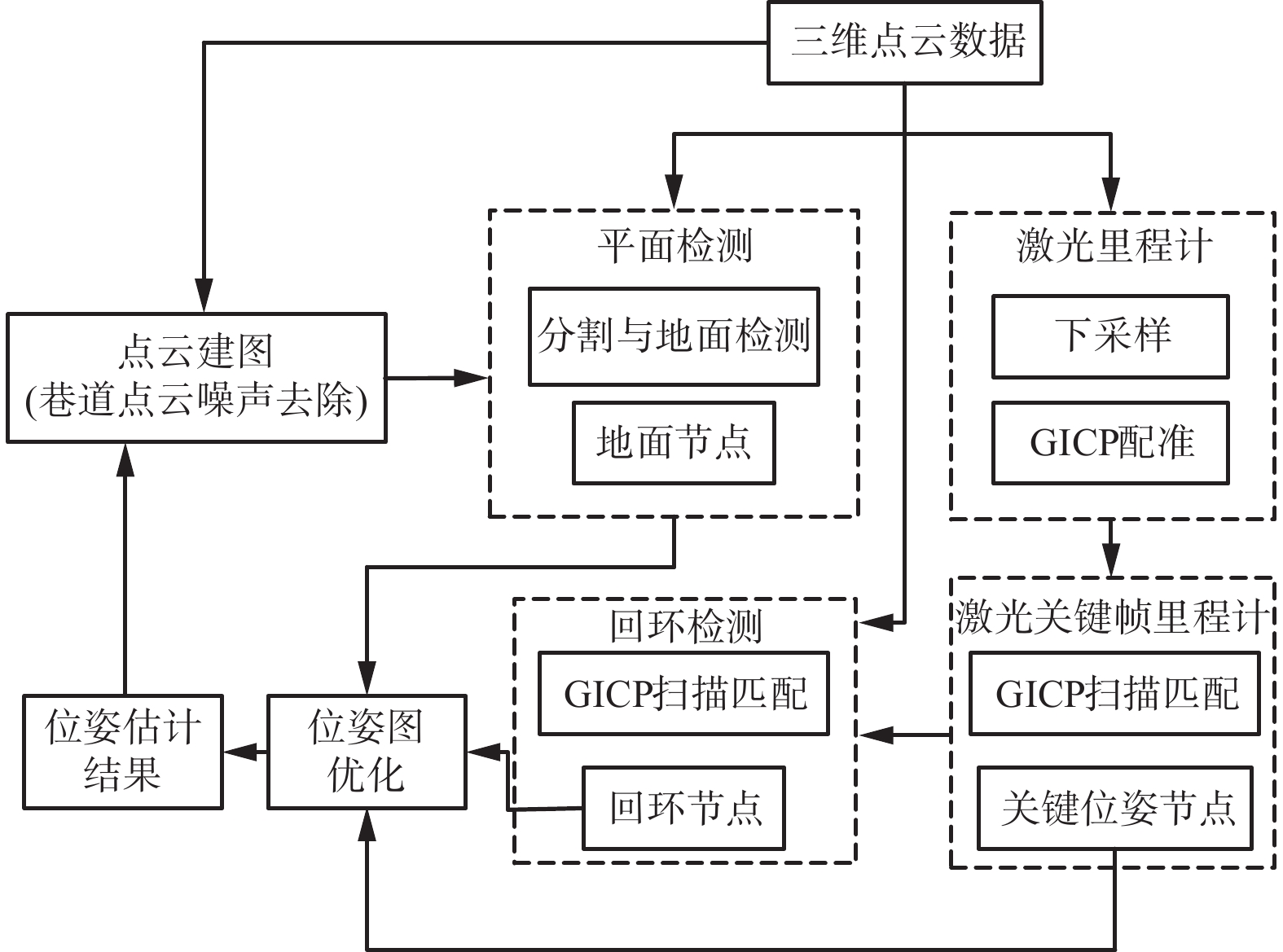

[53] REN Zhuli,WANG Liguan,BI Lin. Robust GICP-based 3D LiDAR SLAM for underground mining environment[J]. Sensors,2019,19(13). DOI: 10.3390/s19132915.

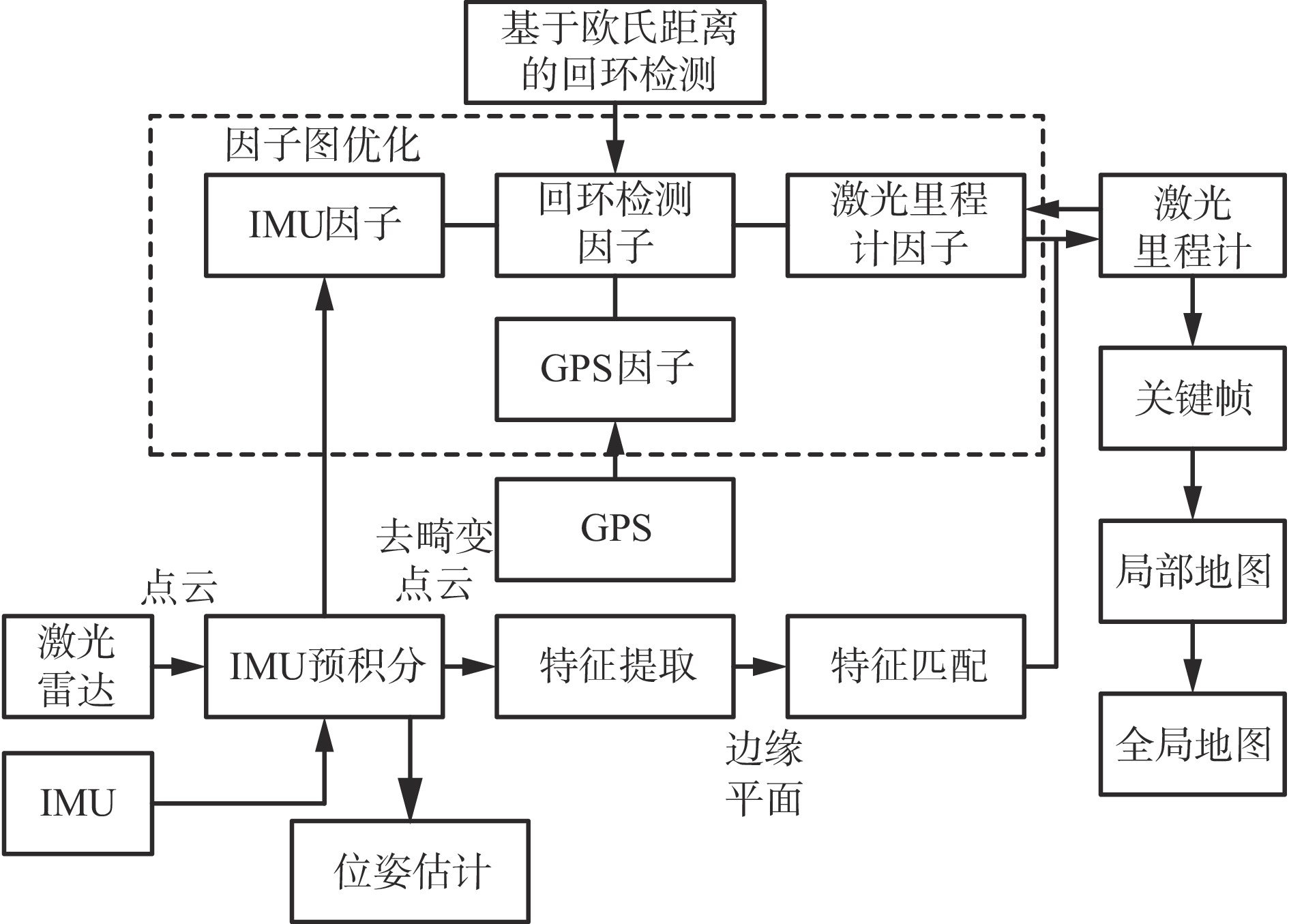

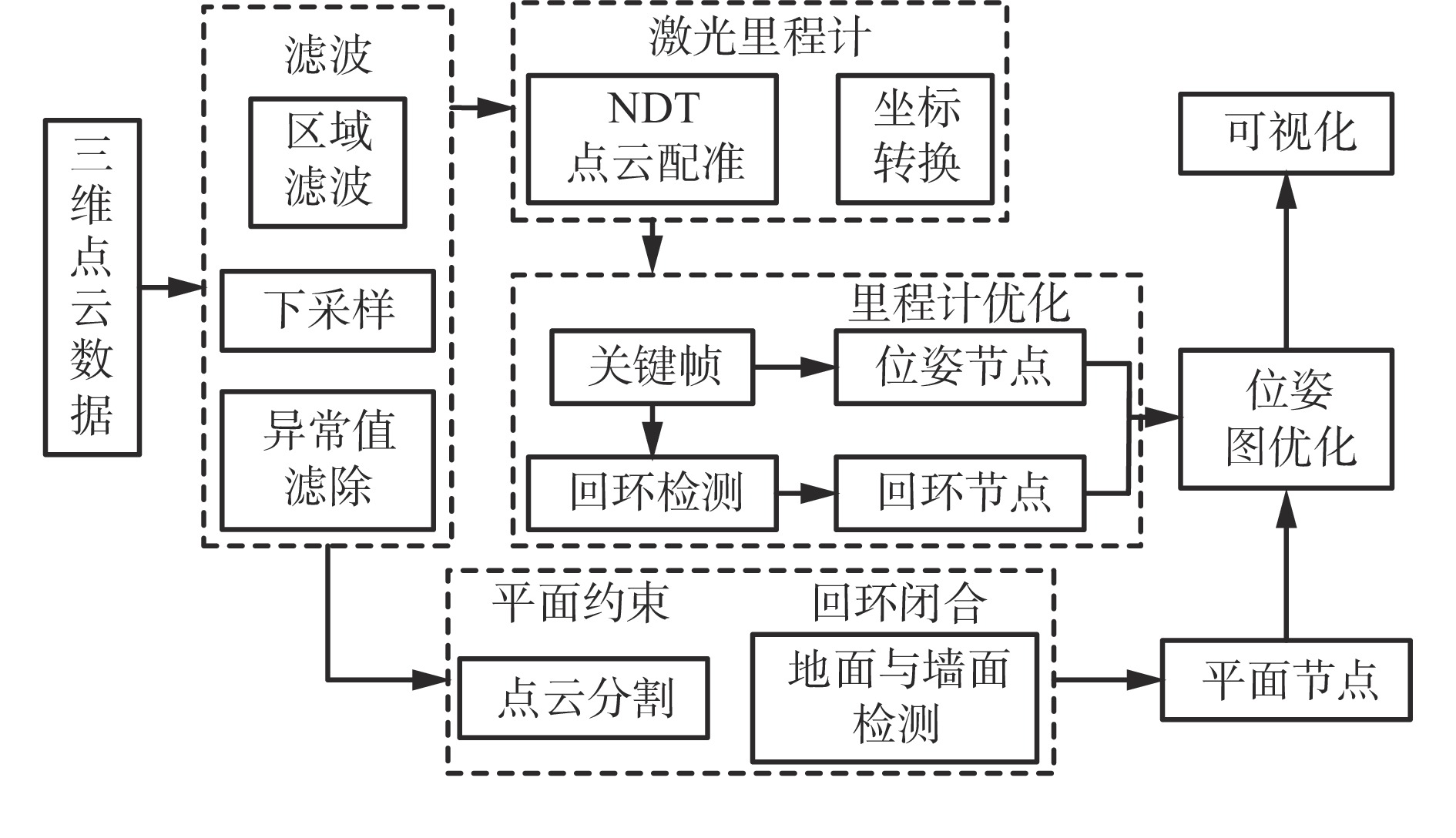

[54] 邹筱瑜,黄鑫淼,王忠宾,等. 基于集成式因子图优化的煤矿巷道移动机器人三维地图构建[J]. 工矿自动化,2022,48(12):57-67,92. ZOU Xiaoyu,HUANG Xinmiao,WANG Zhongbin,et al. 3D map construction of coal mine roadway mobile robot based on integrated factor graph optimization[J]. Journal of Mine Automation,2022,48(12):57-67,92.

[55] 许鹏程. 基于粒子群优化的煤矿井下机器人FASTSLAM算法研究[D]. 北京:煤炭科学研究总院,2017. XU Pengcheng. Research on FASTSLAM algorithm of coal mine underground robot based on particle swarm optimization[D]. Beijing:China Coal Research Institute,2017.

[56] 杨林,马宏伟,王岩,等. 煤矿巡检机器人同步定位与地图构建方法研究[J]. 工矿自动化,2019,45(9):18-24. YANG Lin,MA Hongwei,WANG Yan,et al. Research on method of simultaneous localization and mapping of coal mine inspection robot[J]. Industry and Mine Automation,2019,45(9):18-24.

[57] 代嘉惠. 大功率本安驱动煤矿救援机器人定位与建图算法研究[D]. 重庆:重庆大学,2019. DAI Jiahui. Study on localization and mapping algorithm of high-power intrinsically safe coal mine rescue robot[D]. Chongqing:Chongqing University,2019.

[58] 李仲强. 煤矿救援机器人自主建图和导航技术研究[D]. 淮南:安徽理工大学,2019. LI Zhongqiang. Research on self-construction and navigation technology of coal mine rescue robot[D]. Huainan:Anhui University of Science and Technology,2019.

[59] 李芳威,鲍久圣,王陈,等. 基于LD改进Cartographer建图算法的无人驾驶无轨胶轮车井下SLAM自主导航方法及试验[J/OL]. 煤炭学报:1-12[2024-06-22]. https://doi.org/10.13225/j.cnki.jccs.2023.0731. LI Fangwei,BAO Jiusheng,WANG Chen,et al. Unmanned trackless rubber wheeler based on LD improved Cartographer mapping algorithm underground SLAM autonomous navigation method and test[J/OL]. Journal of China Coal Society:1-12[2024-06-22]. https://doi.org/10.13225/j.cnki.jccs.2023.0731.2023.0731.

[60] 顾清华,白昌鑫,陈露,等. 基于多线激光雷达的井下斜坡道无人矿卡定位与建图方法[J]. 煤炭学报,2024,49(3):1680-1688. GU Qinghua,BAI Changxin,CHEN Lu,et al. Localization and mapping method for unmanned mining trucks in underground slope roads based on multi-line lidar[J]. Journal of China Coal Society,2024,49(3):1680-1688.

[61] 薛光辉,李瑞雪,张钲昊,等. 基于激光雷达的煤矿井底车场地图融合构建方法研究[J]. 煤炭科学技术,2023,51(8):219-227. XUE Guanghui,LI Ruixue,ZHANG Zhenghao,et al. Lidar based map construction fusion method for underground coal mine shaft bottom[J]. Coal Science and Technology,2023,51(8):219-227.

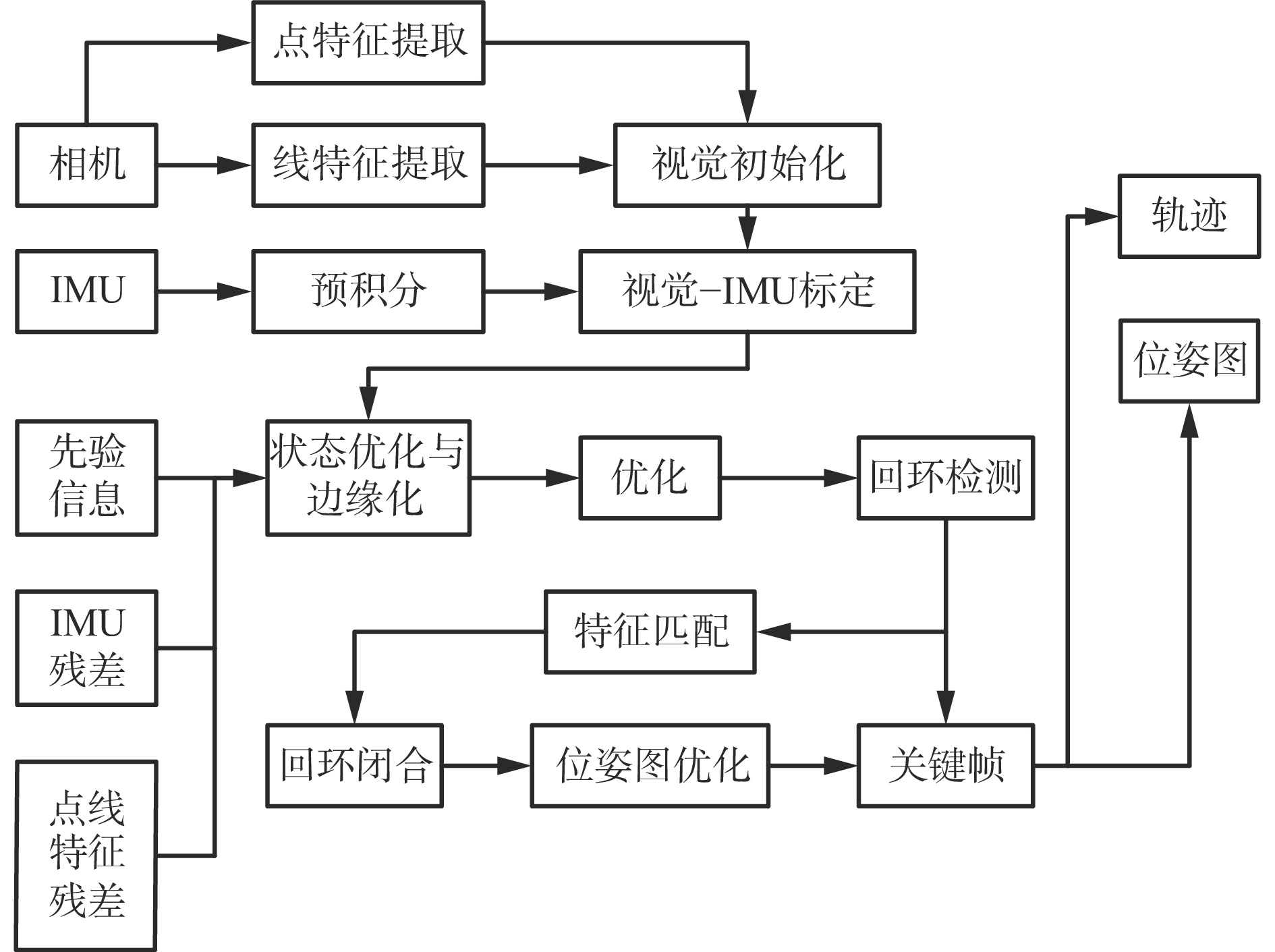

[62] ZHU Daixian,JI Kangkang,WU Dong,et al. A coupled visual and inertial measurement units method for locating and mapping in coal mine tunnel[J]. Sensors,2022,22(19):7437. DOI: 10.3390/s22197437

[63] 汪雷. 煤矿探测机器人图像处理及动态物体去除算法研究[D]. 徐州:中国矿业大学,2020. WANG Lei. Research on image processing and dynamic object removal algorithm of coal mine detection robot[D]. Xuzhou:China University of Mining and Technology,2020.

[64] YANG Xin,LIN Xiaohu,YAO Wanqiang,et al. A robust LiDAR SLAM method for underground coal mine robot with degenerated scene compensation[J]. Remote Sensing,2022,15(1). DOI: 10.3390/RS15010186.

[65] YANG Lin,MA Hongwei,NIE Zhen,et al. 3D LiDAR point cloud registration based on IMU preintegration in coal mine roadways[J]. Sensors,2023,23(7). DOI: 10.3390/S23073473.

[66] 司垒,王忠宾,魏东,等. 基于IMU−LiDAR紧耦合的煤矿防冲钻孔机器人定位导航方法[J]. 煤炭学报,2024,49(4):2179-2194. SI Lei,WANG Zhongbin,WEI Dong,et al. Positioning and navigation method of underground drilling robot for rock-burst prevention based on IMU-LiDAR tight coupling[J]. Journal of China Coal Society,2024,49(4):2179-2194.

[67] 李猛钢,胡而已,朱华. 煤矿移动机器人LiDAR/IMU紧耦合SLAM方法[J]. 工矿自动化,2022,48(12):68-78. LI Menggang,HU Eryi,ZHU Hua. LiDAR/IMU tightly-coupled SLAM method for coal mine mobile robot[J]. Journal of Mine Automation,2022,48(12):68-78.

[68] 董志华,姚顽强,蔺小虎,等. 煤矿井下顾及特征点动态提取的激光SLAM算法研究[J]. 煤矿安全,2023,54(8):241-246. DONG Zhihua,YAO Wanqiang,LIN Xiaohu,et al. LiDAR SLAM algorithm considering dynamic extraction of feature points in underground coal mine[J]. Safety in Coal Mines,2023,54(8):241-246.

[69] 薛光辉,张钲昊,张桂艺,等. 煤矿井下点云特征提取和配准算法改进与激光SLAM研究[J/OL]. 煤炭科学技术:1-12[2024-06-22]. http://kns.cnki.net/kcms/detail/11.2402.TD.20240722.1557.003.html. XUE Guanghui,ZHANG Zhenghao,ZHANG Guiyi,et al. Improvement of point cloud feature extraction and alignment algorithms and LiDAR SLAM in coal mine underground[J/OL]. Coal Science and Technology:1-12[2024-06-22]. http://kns.cnki.net/kcms/detail/11.2402.TD.20240722.1557.003.html.

[70] 李栋. 基于多源信息融合的巷道语义地图构建与复用方法研究[D]. 苏州:苏州大学,2022. LI Dong. A Method of construction and reuse of roadway semantic map based on multi-source information fusion[D]. Suzhou:Soochow University,2022.

[71] 陈步平. 矿用搜救机器人多源信息融合SLAM方法研究[D]. 徐州:中国矿业大学,2023. CHEN Buping. Research on SLAM method of multi-source information fusion for mine search and rescue robot[D]. Xuzhou:China University of Mining and Technology,2023.

[72] 马艾强,姚顽强. 煤矿井下移动机器人多传感器自适应融合SLAM方法[J]. 工矿自动化,2024,50(5):107-117. MA Aiqiang,YAO Wanqiang. Multi sensor adaptive fusion SLAM method for underground mobile robots in coal mines[J]. Journal of Mine Automation,2024,50(5):107-117.

[73] 滕睿. 露天矿运输车辆无人驾驶关键技术研究[D]. 阜新:辽宁工程技术大学,2023. TENG Rui. Research on key technologies of unmanned driving of transport vehicles in open-pit mine[D]. Fuxin:Liaoning Technical University,2023.

[74] 张清宇,崔丽珍,李敏超,等. 倾斜地面3D点云快速分割算法[J]. 无线电工程,2024,54(2):447-456. ZHANG Qingyu,CUI Lizhen,LI Minchao,et al. A fast segmentation algorithm for 3D point cloud on inclined ground[J]. Radio Engineering,2024,54(2):447-456.

[75] 张清宇. 煤矿环境下LiDAR/IMU融合定位算法研究与实现[D]. 包头:内蒙古科技大学,2023. ZHANG Qingyu. Research and implementation of LiDAR/IMU fusion positioning algorithm in coal mine environment[D]. Baotou:Inner Mongolia University of Science & Technology,2023.

[76] 马宝良,崔丽珍,李敏超,等. 露天煤矿环境下基于LiDAR/IMU的紧耦合SLAM算法研究[J]. 煤炭科学技术,2024,52(3):236-244. MA Baoliang,CUI Lizhen,LI Minchao,et al. Study on tightly coupled LiDAR-Inertial SLAM for open pit coal mine environment[J]. Coal Science and Technology,2024,52(3):236-244.

[77] 李慧,李敏超,崔丽珍,等. 露天煤矿三维激光雷达运动畸变算法研究[J/OL]. 煤炭科学技术:1-12[2024-06-22]. http://kns.cnki.net/kcms/detail/11.2402.td.20240325.1558.006.html. LI Hui,LI Minchao,CUI Lizhen,et al. Research on 3D LiDAR motion distortion algorithm for open-pit coal mine[J/OL]. Coal Science and Technology:1-12[2024-06-22]. http://kns.cnki.net/kcms/detail/11.2402.td.20240325.1558.006.html.

下载:

下载: