0 引言

智能运输系统是智慧矿山的重要组成部分,是集智能驱动、智能控制、智能运维和无人驾驶等先进技术于一体的安全、高效、智能、无人化的运输系统,其核心在于智能化的矿山运输装备[1-4]。带式输送机是散料输送最为重要的运输设备之一,而输送带作为带式输送机的重要组成部分,起着承载物料与牵引的重要作用。在矿用输送带使用过程中,落料冲击、物料夹杂金属异物等易引起输送带非正常损伤,缩短输送带使用寿命,增加生产成本[5]。如不能及时发现和处理输送带损伤,会引发输送带撕裂事故,造成更大危害。

目前输送带损伤检测方法分为人工检测和自动检测。人工检测方法包括观察法、标线测量法等,属于静态检测方法,工作量大,难以满足带式输送机智能化发展的需求。自动检测方法包括漏磁法[6]、弱磁法[7]、内置感应线圈法[8]、机器视觉法[9-11]等。其中,基于机器视觉的输送带损伤检测方法应用较为广泛。张春明[12]提出了基于线激光辅助的输送带撕裂检测及保护装置,利用线激光条纹的高对比度特性降低了粉尘、光照等因素对检测图像的干扰,解决了二维图像中撕裂特征提取困难的问题,提高了检测结果的准确度。郭启皇[13]综合考虑了多种图像分割算法在输送带撕裂图像中的处理效果和处理速度,最终确定以Otsu阈值分割算法(大津法)作为输送带撕裂视觉检测系统的图像处理算法,根据输送带表面二值图像的特点规定撕裂诊断规则,达到撕裂检测的目的。乔铁柱[14]提出了基于输送带温度红外特征与可见光激光线辅助视觉特征双重可靠判据的输送带撕裂特征提取方法,充分考虑了物料因卡堵而与输送带摩擦造成的带面温度升高问题,有效解决了复杂环境下图像信息采集的准确性与可靠性低的问题。刘伟力[15]根据FAST角点检测算法、改进的概率Hough变换直线检测算法和2-1 Hough变换圆形检测算法,设计了基于图像特征提取的输送带纵向撕裂检测和定位方法,实现了输送带纵向撕裂的实时检测、缺陷定位。Che Jian等[16]提出了基于视听融合的输送带撕裂检测方法,通过提取输送带在正常、撕裂和划痕状态下的图像和声音特征,并利用机器学习算法进行分类,从而实现较高精度的撕裂判断。上述方法主要针对输送带撕裂问题进行分析,缺乏对输送带其他损伤类型的研究。在实际情况下,输送带撕裂是输送带损伤的最终结果,而对输送带其他损伤类型进行检测,可有效地防止输送带事故扩大。本文提出了一种基于深度学习的矿用输送带损伤检测方法,该方法通过Yolov4-tiny目标检测网络对输送带损伤类型进行检测。

1 方法原理

1.1 Yolov4-tiny目标检测网络结构

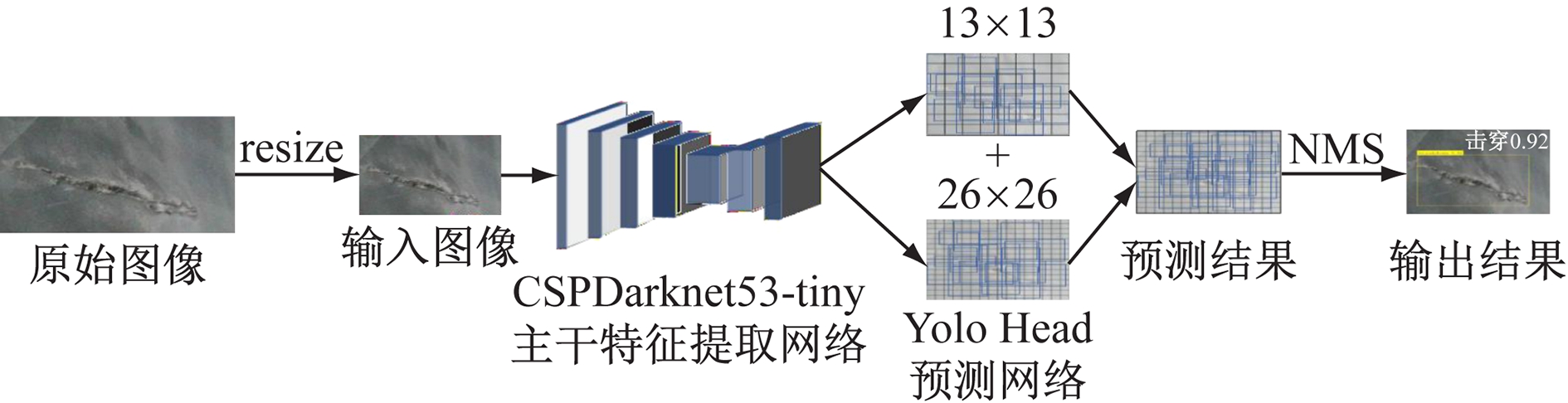

Yolov4-tiny目标检测网络从结构上可分为主干特征提取网络和预测网络2个部分,其中主干特征提取网络直接影响预测网络的预测效果,且主干特征提取网络的深度、宽度及输入图像的分辨率直接影响特征提取的丰富性。Yolov4-tiny目标检测网络结构如图1所示。

以CSPDarknet53-tiny作为主干特征提取网络,由多个CSPblock_body组成。CSPblock_body借鉴Resnet中的残差思想,直接将输入信息绕道传到输出层,可保护信息的完整性,且只需学习输入与输出的差异部分,可简化学习目标和难度。使用Resnet残差块防止深层网络中高层语义特征丢失,以提高检测精度。采用特征金字塔网络(Feature Pyramid Networks,FPN)[17]对主干特征提取网络中得到的2个有效特征层(26×26×256和13×13×512)进行高低层语义信息融合。其中,高层语义信息中所含目标特征语义信息多但位置信息少,而低层语义信息中所含目标位置信息较多但特征语义信息较少。通过特征融合,可实现特征语义信息和位置信息的充分互补,提高检测精度。

图1 Yolov4-tiny目标检测网络结构 Fig.1 Yolov4-tiny target detection network structure

1.2 Yolov4-tiny目标检测原理

将主干特征提取网络中得到的2个有效特征层输入预测网络Yolo Head。通过Yolo Head将所得特征层划分成S×S个网格(本文中为13×13和26×26),若待测目标的中心落在某个网格中,则由该网格负责检测该目标,具体目标检测流程如图2所示。在预测过程中,每个网格产生3个预测框,每个预测框包含9个预测值,其中,前4个预测值为目标种类,包括表面划伤、表面破损、击穿、撕裂;第5个预测值为置信度,用来表征预测框的置信水平与预测精度,即通过置信度确定框内是否包含物体,取值区间为[0,1],置信度趋近0,表示没有物体;后4个预测值为预测框的调整参数,分别为预测框中心点相对于网格左上顶点的偏移量、预测框的宽和高。在得到预测框之后,通过得分排序和非极大值抑制(Non-Maximum Suppression,NMS)算法对预测框进行筛选。

图2 目标检测流程

Fig.2 Target detection flow

1.3 损失函数

Yolov4-tiny目标检测网络训练时的损失函数L由预测框回归损失LCIoU、分类损失Lclass、置信度损失Lconf共3个部分组成。其中,LCIoU为预测框的位置、宽和高与真实标签之间的误差,Lclass为预测分类与真实分类之间的误差,Lconf与每个预测框中预测值的置信度得分相关。

(1)

(2)

(3)

Lconf=![]()

(4)

Lclass=![]()

(5)

L=LCIoU+Lconf+Lclass

(6)

式中:I(A,B)为预测框B与真实标注框A的交并比;ρ2(D,F)为预测框中心点F与真实标注框中心点D的欧氏距离;m为同时包含预测框和真实标注框的最小封闭区域的对角线距离;α为权重函数;ν为长宽比相似性度量系数;wgt,hgt分别为真实标注框的宽和高;w,h分别为预测框的宽和高;S2为网格数;E为每个网格上预测框的个数;![]() 为第i个网格上产生的第j个预测框内包含目标,

为第i个网格上产生的第j个预测框内包含目标,![]() 为预测框内不包含目标;

为预测框内不包含目标;![]() 为真实置信度;

为真实置信度;![]() 为预测置信度;λnoobj为自行设定的计算系数;n为目标分类数;

为预测置信度;λnoobj为自行设定的计算系数;n为目标分类数;![]() 为框内目标属于某一类别c的真实概率;

为框内目标属于某一类别c的真实概率;![]() 为框内目标属于某一类别c的预测概率。

为框内目标属于某一类别c的预测概率。

当预测框内没有目标时,只计算置信度损失;若预测框内存在目标,则根据式(1)—式(6)计算损失。损失值越小,意味着预测值与真实值之间的差距越小,表明目标检测网络训练得越好。

2 实验结果与分析

本文在Keras 2.1.5、CUDA 9.0、CUDNN 7.1下对Yolov4-tiny目标检测网络进行训练,实验环境为Windows 10 64位操作系统,48 GB内存,NVIDIA GeForce RTX2060S显卡,Intel Xeon E5 2620v3×2 CPU,编程语言为Python。

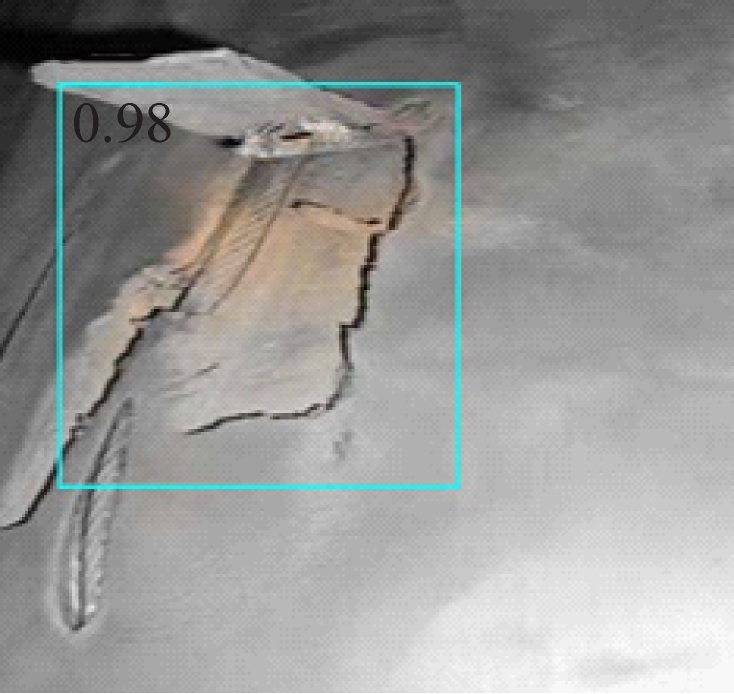

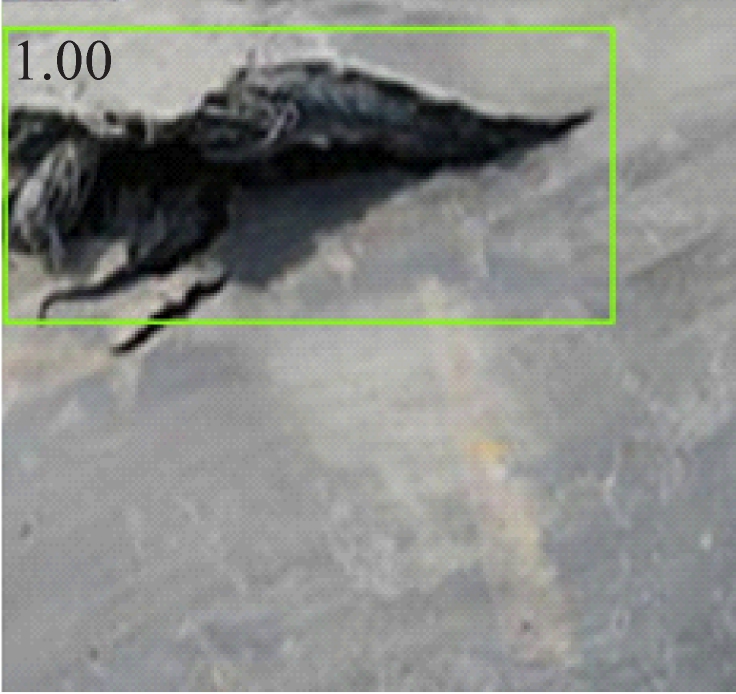

通过现场数据采集和网络搜索等形式收集输送带损伤图像3 000张,其中表面破损、击穿、表面划伤和撕裂4种输送带损伤类型图像各占1/4,并通过人工标注的方式构建输送带损伤数据集,部分样本数据如图3所示。

(a) 表面破损

(b) 击穿

(c) 表面划伤

(d) 撕裂

图3 输送带损伤数据集样本

Fig.3 Dataset sample of conveyor belt damage

在网络训练过程中,采用Mosaic及CutMix数据增强策略增加输入图像可变性,丰富图像背景信息。使用逐步下降的学习率,迭代100次,初始学习率为1×10-3,在迭代50次和80次时下降为之前的1/10,批尺寸为16。

2.1 预测精度与预测速度

在多分类目标检测任务中,通常采用平均精度均值 (mean Average Precision,mAP)度量预测精度,采用帧速率度量预测速度。平均精度均值与精确率和召回率密切相关,精确率和召回率与正负样本是否被正确分类相关。

(7)

式中:M为平均精度均值;Q为各分类的平均精度。

(8)

式中:P为精确率;NTP为被预测为正样本的正样本数量;NFP为被预测为正样本的负样本数量。

(9)

式中:R为召回率;NFN为被预测为负样本的正样本数量。

以精确率为横轴、召回率为纵轴绘制各损伤类型的P-R曲线(图4(a)),P-R曲线与横纵坐标轴围成的面积即各损伤类型的平均预测精度,如图4(b)所示。可看出Yolov4-tiny目标检测网络对表面划伤、撕裂、表面破损和击穿检测的平均精度分别为99.36%,94.85%,89.30%,86.76%,平均精度均值达92.57%。

(a) 各损伤类型的P-R曲线

(b) 各损伤类型的平均预测精度

图4 Yolov4-tiny目标检测网络预测精度

Fig.4 Prediction precision of Yolov4-tiny target detection network

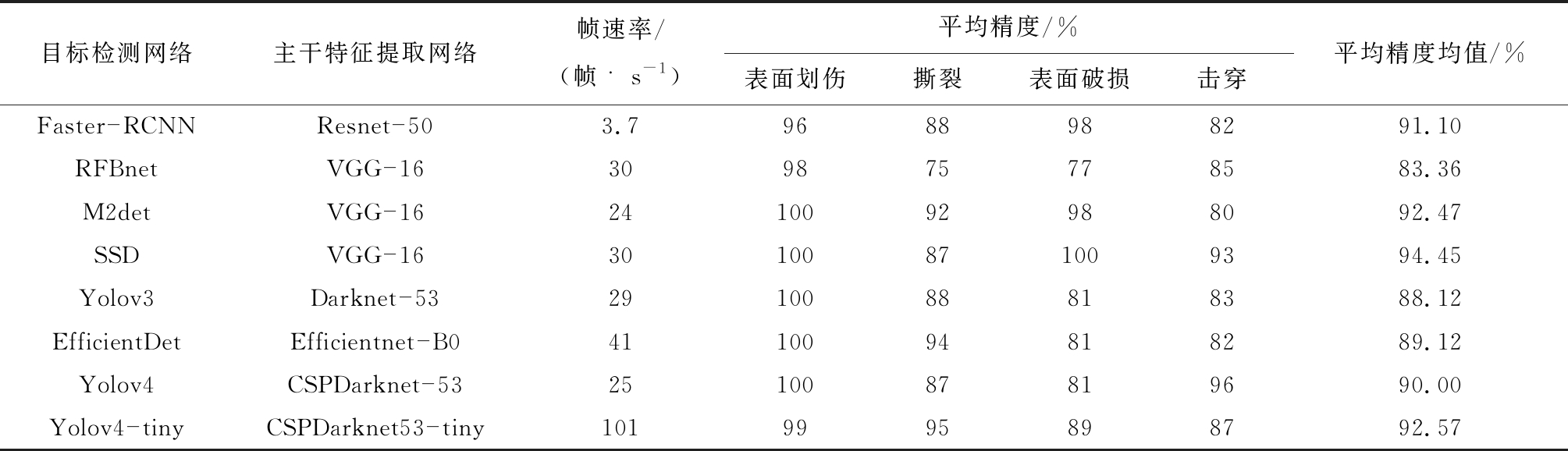

为了验证Yolov4-tiny目标检测网络的优越性,与Faster-RCNN,RFBnet,M2det,SSD,Yolov3,EfficientDet和Yolov4目标检测网络进行对比,结果见表1。可看出Yolov4-tiny目标检测网络在数据集上取得了最快的检测速度,帧速率达101帧/s,实现了速度与精度的平衡。

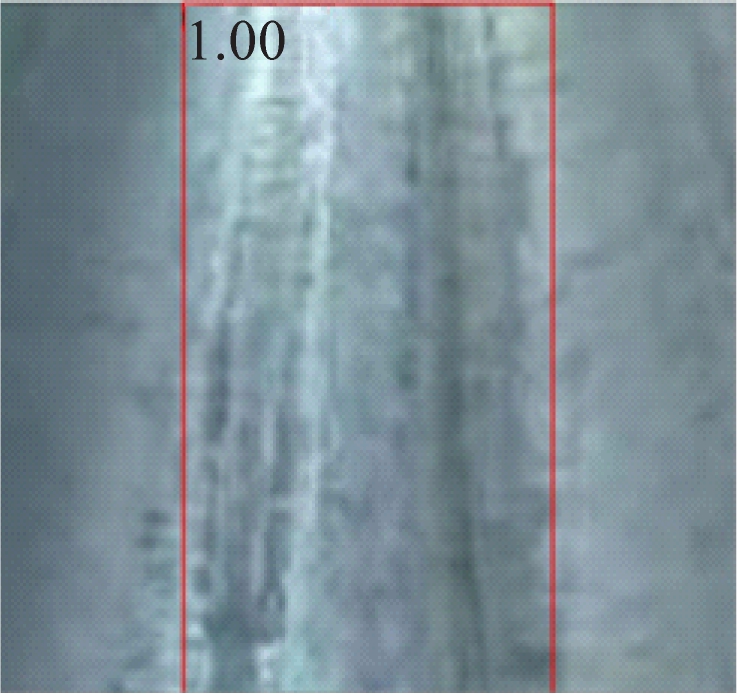

本文方法对输送带损伤类型的检测结果如图5所示。可看出表面破损、击穿、表面划伤和撕裂的置信度均大于0.98,表明本文方法对4种输送带损伤类型的检测均能达到较高精度。

(a) 表面破损

(b) 击穿

(c) 表面划伤

(d) 撕裂

图5 输送带损伤检测结果

Fig.5 Conveyor belt damage detection results

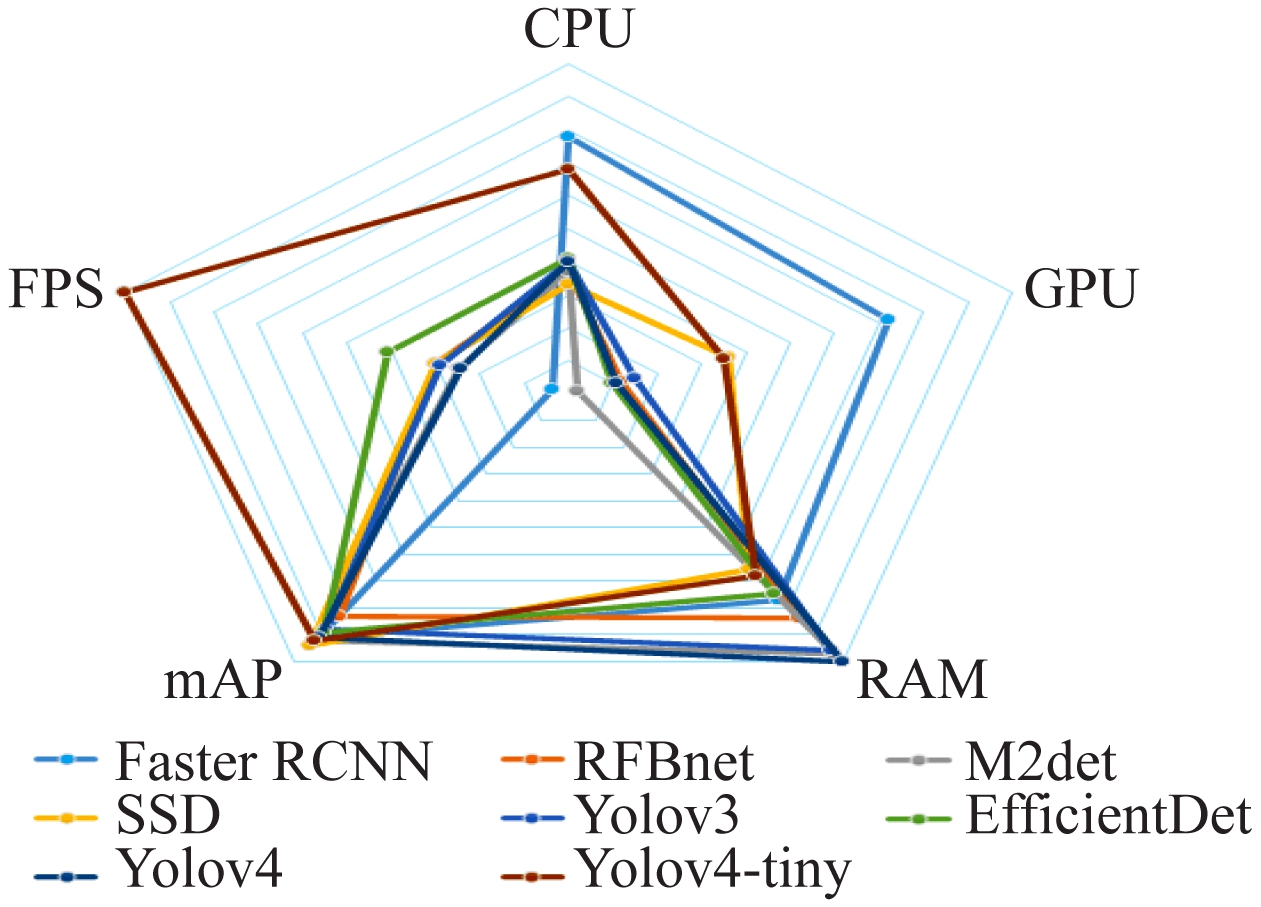

2.2 硬件占用率

Faster-RCNN,RFBnet,M2det,SSD,Yolov3,EfficientDet、Yolov4和Yolov4-tiny目标检测网络的硬件占用率如图6所示。对比可知Yolov4-tiny目标检测网络在取得最快的检测速度和较高的检测精度的情况下,占用计算资源相对较少。

表1 不同目标检测网络预测精度和预测速度对比

Table 1 Comparison of prediction precision and prediction speed of different target detection networks

目标检测网络主干特征提取网络帧速率/(帧˙s-1)平均精度/%表面划伤撕裂表面破损击穿平均精度均值/%Faster-RCNNResnet-503.79688988291.10RFBnetVGG-16309875778583.36M2detVGG-162410092988092.47SSDVGG-1630100871009394.45Yolov3Darknet-532910088818388.12EfficientDetEfficientnet-B04110094818289.12Yolov4CSPDarknet-532510087819690.00Yolov4-tinyCSPDarknet53-tiny1019995898792.57

图6 硬件占用率

Fig.6 Hardware occupancy rate

2.3 泛化能力

为验证Yolov4-tiny目标检测网络的泛化能力,选取文献[18]、文献[19]和文献[20]中的输送带撕裂图像进行检测,结果如图7所示,各文献中输送带撕裂形态自左至右分别为原图、相应文献中方法检测结果、本文方法检测结果。可看出本文方法能很好地实现对数据集外新鲜样本的检测,证明其具有良好的泛化能力。

(a) 文献[18]中输送带撕裂形态

(b) 文献[19]中输送带撕裂形态

(c) 文献[20]中输送带撕裂形态

图7 输送带撕裂检测结果

Fig.7 Conveyor belt tear detection results

3 结语

基于深度学习的矿用输送带损伤检测方法通过Yolov4-tiny目标检测网络实现输送带损伤情况的分类。Yolov4-tiny目标检测网络以CSPDarknet53-tiny作为主干特征提取网络,借鉴Resnet残差思想防止深层网络中高层语义特征丢失,同时采用FPN实现高低层语义信息融合;将CSPDarknet53-tiny中得到的2个有效特征层输入预测网络Yolo Head,通过得分排序和NMS算法对预测框进行筛选,从而预测输送带损伤类型。实验结果表明,Yolov4-tiny目标检测网络在输送带损伤数据集上对表面划伤、撕裂、表面破损和击穿4种损伤类型检测的平均精度分别为99.36%,94.85%,89.30%,86.76%,平均精度均值达92.57%;与Faster-RCNN,RFBnet,M2det,SSD,Yolov3,EfficientDet和Yolov4目标检测网络相比,Yolov4-tiny目标检测网络在数据集上取得了最快的检测速度,帧速率达101 帧/s,实现了较好的速度与精度的平衡,且占用计算资源相对较少;通过对数据集外新鲜样本的检测,验证了本文方法具有较好的泛化能力。

[1] 鲍久圣,刘琴,葛世荣,等.矿山运输装备智能化技术研究现状及发展趋势[J].智能矿山,2020,1(1):78-88.

BAO Jiusheng,LIU Qin,GE Shirong,et al.Research status and development trend of intelligent technology of mine transport equipment[J].Journal of Intelligent Mine,2020,1(1):78-88.

[2] 葛世荣,郝尚清,张世洪,等.我国智能化采煤技术现状及待突破关键技术[J].煤炭科学技术,2020,48(7):28-46.

GE Shirong,HAO Shangqing,ZHANG Shihong,et al.Status of intelligent coal mining technology and potential key technologies in China[J].Coal Science and Technology,2020,48(7):28-46.

[3] 王国法,刘峰,庞义辉,等.煤矿智能化——煤炭工业高质量发展的核心技术支撑[J].煤炭学报,2019,44(2):349-357.

WANG Guofa,LIU Feng,PANG Yihui,et al.Coal mine intellectualization:the core technology of high quality development[J].Journal of China Coal Society,2019,44(2):349-357.

[4] 王树民,李志明,刘志江,等.高寒地区煤灰一体双向运输系统关键技术研究[J].煤炭科学技术,2020,48(9):209-217.

WANG Shumin,LI Zhiming,LIU Zhijiang,et al.Research on key technologies of coal ash integrated bi-directional transport system in alpine region[J].Coal Science and Technology,2020,48(9):209-217.

[5] ALVIARI L P,ANGGAMAWARTI M F,SANJIWANI Y,et al.Classification of impact damage on a rubber-textile conveyor belt:a review[J].International Journal of Mechanical Engineering Technologies and Applications,2020,1(1):21-27.

[6] ZHU Hongjun,LIN Yuanhua,ZENG Dezhi,et al.Simulation analysis of flow field and shear stress distribution in internal upset transition zone of drill pipe[J].Engineering Failure Analysis,2012,21:67-77.

[7] QIAO Tiezhu,LU Xiaoyu,YAN Laiqing.Research on the signal feature extraction method in steel-cord conveyor belt with metal magnetic memory testing[J].Journal of Computational and Theoretical Nanoence,2012,11(1):489-492.

[8] PANG Y,LODEWIJKS G.A novel embedded conductive detection system for intelligent conveyor belt monitoring[C]//IEEE International Conference on Service Operations and Logistics,and Informatics,Shanghai,2006:803-808.

[9] YANG Yanli,MIAO Changyun,LI Xianguo,et al.On-line conveyor belts inspection based on machine vision[J].Optik-International Journal for Light and Electron Optics,2014,125(19):5803-5807.

[10] ZHU Aichun,GANG Hua,WANG Yongxing.The research on the detection method of belt deviation by video in coal mine[C]//International Conference on Mechatronic Science,Electric Engineering and Computer (MEC),Jilin,2011:430-433.

[11] HOU Chengcheng,QIAO Tiezhu,ZHANG Haitao,et al.Multispectral visual detection method for conveyor belt longitudinal tear[J].Measurement,2019,143(9):246-257.

[12] 张春明.基于线激光辅助的皮带撕裂视觉检测技术研究[D].秦皇岛:燕山大学,2012.

ZHANG Chunming.Research on vision detection technology testing the RIP of conveyor belt based on line laser stripe[D].Qinhuangdao:Yanshan University,2012.

[13] 郭启皇.基于Otsu算法的输送带撕裂视觉检测系统研究[D].太原:太原理工大学,2017.

GUO Qihuang.Reserch on conveyor belt tear visual inspection system based on Otsu algorithm[D].Taiyuan:Taiyuan University of Technology,2017.

[14] 乔铁柱.输送带纵向撕裂可见光与红外双目视觉在线检测系统研究[D].太原:太原理工大学,2015.

QIAO Tiezhu.Binocular vision on-line detection system study for conveyor belt longitudinal tear based on infrared and visible light[D].Taiyuan:Taiyuan University of Technology,2015.

[15] 刘伟力.输送带纵向撕裂机器视觉在线监控系统研究[D].太原:太原理工大学,2017.

LIU Weili.Research on machine vision online monitoring system of conveyor belt longitudinal tear[D].Taiyuan:Taiyuan University of Technology,2017.

[16] CHE Jian,QIAO Tiezhu,YANG Yi,et al.Longitudinal tear detection method of conveyor belt based on audio-visual fusion[J].Measurement,2021,176(5):109-152.

[17] LIN T Y,DOLLAR P,GIRSHICK R,et al.Feature pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,Honolulu,2017,2117-2125.

[18] YANG Ruiyun,QIAO Tiezhu,PANG Yusong,et al.Infrared spectrum analysis method for detection and early warning of longitudinal tear of mine conveyor belt[J].Measurement,2020,165:107856.

[19] QIAO Tiezhu,CHEN Lulu,PANG Yusong,et al.Integrative binocular vision detection method based on infrared and visible light fusion for conveyor belts longitudinal tear[J].Measurement,2017,110:192-201.

[20] LI Xiangguo,SHEN Lifang,MING Zixu,et al.Laser-based on-line machine vision detection for longitudinal rip of conveyor belt[J].Optik,2018,168:360-369.